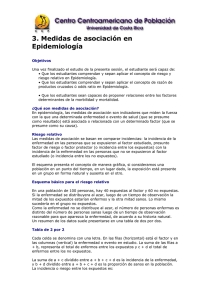

Tablas de contingencia

Anuncio