Informática I - Instituto John Kennedy

Anuncio

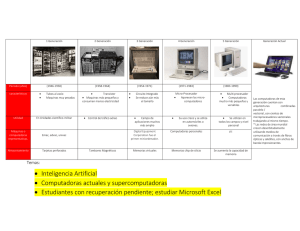

INSTITUTO JOHN KENNEDY El presente material forma parte de los contenidos digitales del Inst. John Kennedy. Se prohíbe su uso o distribución sin consentimiento de su autor o de la institución misma. [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa Índice: ¡Una gran historia! ………………………………………………. 3 Los inventos que dieron origen a la Informática …………………………………………….… 4 El inicio de la era Informática …………………………………………….… 5 Descifrando un código …………………………………………….… 5 De descifrar a procesar …………………………………………….… 8 Las generaciones de computadoras …………………………………………….… 9 Primera generación (1951-1958) …………………………………………….… 9 Segunda generación (1959-1964) …………………………………………..… 10 Tercera generación (1964-1971) …………………………………….…….… 10 Cuarta generación (1971-1981) ………………………………………….…. 11 La primera computadora personal (PC) …………………………………………..… 12 Quinta generación (1982-1989) ………………………………………..…… 13 El avance del software en los 80s ………………………………………..…… 13 ¿PC XT o PC AT? ………………………………………..…… 14 Los microcomputadores ………………………………………..…… 14 Grandes avances de la década ………………………………………..…… 15 Inteligencia artificial ………………………………………..…… 16 Sexta generación (1990 al presente) ………………………………………..…… 17 Material pedagógico digital del INSTITUTO JOHN KENNEDY Las Piedras 152 - Tel. 4226717 San Miguel de Tucumán – CP. 4000 - República Argentina 2 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa ¡ UNA GRAN HISTORIA ! Desde la antigüedad, el hombre buscó la forma de realizar cálculos de manera mecánica y precisa con la intención de resolver sus dificultades. En ese afán inventó distinto tipo de máquinas que le permitieran lograrlo. Algunas muy básicas como el ábaco, cuya antigüedad se estima supera los 5.000 años y que llegara a cobrar protagonismo a través de diversas civilizaciones como las orientales, entre otras. Aunque no se sabe con precisión quien inventó el ábaco, si se sabe que se utilizó mayormente para el comercio y es considerada la primera máquina de cálculo en la historia. Esta creación antigua del hombre, permitía realizar tres operaciones, suma, resta y multiplicación. Con el correr de los siglos, numerosos fueron los intentos por mejorar esa tecnología, con aciertos y fracasos. El progreso en el estudio de la Matemática, incidió notablemente en el tipo de dispositivos que el hombre fue creando conforme al paso de los siglos. Atentos a ello, vamos a destacar algunos. 3 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa LOS INVENTOS QUE DIERON ORIGEN A LA INFORMÁTICA La Informática no es fruto de la casualidad, surgió como parte de la evolución del hombre y sus necesidades conforme el momento de la historia y a los avances académicos especialmente en el conocimiento matemático. Muchas personas a través de su aporte contribuyeron a este desarrollo, aunque pocos quedaron en la historia grande, de todos ellos vamos a destacar algunos, comenzando por los siguientes cinco: EL RELOJ CALCULADOR. El alemán Wilhem Schickard crea la primera calculadora mecánica en 1624. Una máquina que a través de logaritmos (operaciones aritméticas), hacía rodar unos cilindros para realizar cálculos. LA PASCALINA. Creada en 1642 por el francés Blaise Pascal, teniendo solo 19 años de edad. Inicialmente llamada “RUEDA PASCALINA” y luego “PASCALINA” a secas, permitía además de sumar y restar, multiplicar y dividir por repetición. LA REGLA DE CÁLCULO. En 1662, William Oughtred inventa un dispositivo para calcular lo que denomina “Círculos de Proporción”. Este dispositivo, con el tiempo, fue conocido como “REGLA DE CÁLCULO”. LA MÁQUINA DIFERENCIAL. Creada por el inglés Charles Babage en 1822, operaba en decimales tabulando funciones polinómicas accionada por una manivela. Para construirla, Babbage se inspiró en una publicación de J. H. Müller del año 1786. LA MÁQUINA TABULADORA. Una creación del estadounidense Herman Hollerith en el año 1890. Equipo que se utilizó para controlar los resultados del censo de ese año en Estados Unidos. Un detalle importante, operaba mediante tarjetas perforadas y que muchos consideran el primer antecedente de máquina que procesa mucha información (Informática). 4 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa EL INICIO DE LA ERA INFORMÁTICA Desde el ábaco al presente, es decir a lo largo de más de 5.000 años, el hombre no ha parado de inventar elementos que faciliten y/o mejoren su vida, pero no fue sino hasta la década del 30 del siglo XX que comenzó a hablarse de máquinas de cómputo. Fueron los años en los cuales grandes mentes alemanas, estadounidenses, británicas y de otros países, comenzaron a dar a conocer creaciones asociadas a lo que hoy llamamos “procesamiento de datos” o “procesamiento de información”. Procesamiento de datos: Es el acto de introducir información, realizar operaciones con esa información y recibir un resultado. Podemos suponer entonces, que las antiguas máquinas también lo hacían, pero no de la forma en que las nuevas comenzarían a trabajar, en este caso no solo se ingresaban los datos sino también se indicaba como debía la máquina procesarlos. Para ser más claros, veamos un ejemplo: antes ingresábamos 5 y 7 y la máquina sabía que debía sumarlos. Desde ahora ingresábamos 5 y 7, pero además la indicación de qué debía hacer con ambos números, sumarlos, restar uno del otro, multiplicarlos, dividir uno en otro. Comenzamos entonces a hablar de MÁQUINAS PROGRAMABLES. DECIFRANDO UN CÓDIGO Entre 1935 y 1936, el alemán Konrad Zuse presentó en su país un computador mecánico programable al que llamó Z1. Lamentablemente 4 años después estallaría la guerra y los bombardeos destruyeron los planos de dicho computador, así como los del Z2 y otros proyectos construidos también por Zuse. Lo que suponía un avance, se perdió entre las ruinas de una Alemania devastada. Pero en 1941, un profesor de la Universidad de Cambridge, el matemático Alan Mathison Turing, desarrolló una máquina que en principio no tenía otra finalidad que la de descifrar los mensajes alemanes durante la guerra. Estos códigos eran interceptados por la armada británica pero no conseguían ser interpretados, ya que viajaban cifrados o encriptados con un algoritmo dinámico generado por otra máquina, para muchos imposible de descifrar. 5 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa Veamos algunos términos para comprender mejor de qué estamos hablando. Cifrar o encriptar: Es el acto de alterar un mensaje, letra por letra, número por número, signo por signo, de modo tal que el que intercepte el mensaje, no pueda interpretarlo. ¡Salvo que sepa como descifrarlo!. Por ejemplo: Si digo “HOLA”, quien lee interpreta con facilidad el mensaje. Pero… ¿si en cambio digo: “IPMB”? No se interpreta. Salvo que les de la clave, deben restarle 1 (un) valor, a cada letra, es decir, si vemos B es A, si vemos C es B y así sucesivamente. ¡Probemos!. ¿Qué dice?. En el alfabeto la letra anterior a I es H (continúa con las otras escribiéndolas en cada celda). I P M B ¡Muy bien!, ¡has decifrado tu primer mensaje encriptado!. ¡Y lo hiciste mediante un algoritmo (proceso), en el cual le restas un valor a cada carácter!. Si!, ese proceso que hiciste de restar a cada letra un valor es lo que se conoce como algoritmo. Algoritmo simple, sencillo, pero algoritmo al fin!. Pero ¿qué pasaría si la clave no fuese tan fácil como restar un valor a cada letra?. ¿Si fuesen 2, 3, 5 o quién sabe cuántos?. ¿Qué pasaría si por ejemplo la primera letra fuera 3 letras menos, la segunda 6 hacia adelante, la tercera 1 hacia atrás, la cuarta 2 adelante y así según una regla que solo el enemigo tiene?. Y si, peor aún, ¿ese algoritmo cambiara todos los días?. Si cambia, es cuando hablamos de un algoritmo dinámico (dinámico = que no es el mismo siempre, que se modifica, que cambia. Mismo proceso, pero modifica sus valores). Con este juego en las comunicaciones, la Alemania nazi llevaba 2 años ganando la guerra, habiendo conquistado casi toda Europa, sin que las tropas aliadas consiguieran predecir prácticamente ningún ataque. No solo los ataques, las posiciones de cada barco, buque, flota de aviones y tropas, propias y ajenas, los reportes de cada pueblo, ciudad y país, viajaban por las comunicaciones, a veces de modo oficial, en los reportes del clima, en programas radiales y a través de toda vía de comunicación. 6 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa Entendiendo Turing que las horas hombre para intentar descifrar cada código iban a ser inútiles, comenzó a fabricar una gran máquina descifradora. Esa máquina (en foto la original), debía en principio tomar los mensajes alemanes y con ellos ensayar todas las combinaciones posibles hasta encontrar un mensaje con sentido. La máquina funcionó durante meses sin arrojar resultados, hasta que su equipo advirtió que cada mensaje alemán, se emitía precedido por 5 letras (¡si!, ¡la clave!, ¡allí estaba el algoritmo!) y posteriormente interpretado por una máquina de encriptación llamada Enigma. Con la construcción de esta máquina, originalmente denominada “Bombe” (Bomba), los ingleses comenzaron descifrar las comunicaciones y se dio vuelta la historia de una guerra hasta ese entonces perdida por las tropas aliadas. Más allá del resultado de la guerra, esta creación, permitió acortar la Segunda Guerra Mundial en 2 años, según algunos historiadores, salvando la vida de no menos de 2 millones de personas y dando origen a un nuevo campo de investigación, LA INFORMÁTICA. Lamentablemente a Turing se lo conoce como “el genio caído” de la computación, ya que la corona británica mantuvo en secreto sus logros durante muchas décadas, y falleció a corta edad sin ser reconocido en la dimensión que merecía. Una pregunta final, ¿por qué se asegura que esta es la primera computadora?. Simple, es la primera máquina inventada a la que le introducíamos información y cualquier tipo de algoritmo y conforme a ellos procesaba los datos, LA PRIMERA MÁQUINA REALMENTE PROGRAMABLE (DINAMICAMENTE). 7 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa DE DESCIFRAR A PROCESAR Terminada la guerra, no quedaban códigos por descifrar, razón por la cual Turing a su máquina, con el tiempo y algunas mejoras llamada “Máquina de Turing”, le dio otro propósito. Como gran matemático que era, decidió utilizarla para las matemáticas. Ya no recibiría solo mensajes a descifrar, sino también números para hacer cálculos y la clave, aquellas letras iniciales que conformaban el algoritmo, se convertirían en cortos programas para procesar esa información. ¿Cuántas operaciones podría hacer?. Si nos llevamos de 5 dígitos (por las 5 letras iniciales) tendríamos este número: 99999 (noventa y nueve mil novecientos noventa y nueve). Más el cero son 100.000 operaciones matemáticas posibles!. 100.000 programas posibles!. 100.000 formas diferentes de trabajar. ¿Y si modificáramos la máquina para que fueran millones de operaciones posibles?. Es lo que hizo Turing luego (foto), mejoró su creación, hizo evolucionar su gran máquina, mientras participaba de otros grandes proyectos, uno fue Colossus, aportándole al naciente campo de la informática adelantos valiosísimos. Por destacar uno, es el primer referente del concepto “Inteligencia Artificial”. Concepto que tiene mucho que ver con la Informática actual, ya que en ese tiempo el trabajaba en el desarrollo de máquinas que fuesen capaces de procesar la información de un modo similar a como lo hacen las personas. El término “Imitation Game” (juego de la imitación), que da título a su libro, es un fiel reflejo de su obsesión por crear máquinas tan o más inteligentes que el ser humano. Sin lugar a dudas, un verdadero genio, ¡un adelantado que nos adelantó a todos!. 8 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa TRABAJO PRÁCTICO Nº 14 1) Utilizando buscadores e Internet, investiga a Turing y elabora una ficha biográfica que contenga, datos personales, estudios realizados y proyectos que integró. Ilustra con imágenes. 2) Elabora un trabajo en Powerpoint acerca de su vida. LAS GENERACIONES DE COMPUTADORAS A partir de la creación de las primeras máquinas, los avances en materia tecnológica van haciendo su aporte y surgen otros nombres como la Z3 (1941) del alemán Zuse, también programable pero la primera automática, la Harvard Mark I (la primera electromecánica) presentada en el 44, Colossus (finalmente presentada ese año), EDVAC (1945), que tenía el primer programa almacenado y en 1946 el EDSAC y el ENIAC, este último el primer computador programable de propósito general, creado como un proyecto militar inicialmente. Comenzaba así, más aún tras la culminación de la guerra, una etapa de innovación tecnológica sin precedentes en la historia, solo comparable en algunos aspectos a la revolución industrial. En 1947 se inventa el primer transistor, elemento que cambiaría la tecnología años mas tarde y en el 49 la primera memoria, elemento que reemplazaría a los tubos de vacío de las primeras computadoras. PRIMERA GENERACIÓN (1951 – 1958) Funcionamiento a válvulas de vacío. La década del 50 marca el inicio de lo que con los años llamaríamos “PRIMERA GENERACIÓN DE COMPUTADORAS”. Eran enormes aparatos que funcionaban con válvulas para procesar la información, dependiendo de operadores que ingresaban los datos con unas tarjetas perforadas. Los equipos necesitaban gran refrigeración, ya que esas válvulas levantaban mucha temperatura, se quemaban y había que cambiarlas periódicamente. La computadora de la imagen es UNIVAC I, de las primeras de dicha generación. Poco tiempo después IBM presentaría la 701, computadora con la cual iniciaría un reinado tecnológico mundial, consolidado al presentar su modelo 650. Hay que destacar un detalle, en ese tiempo las computadoras no eran para la gente, solo algunos bancos, el gobierno y algunas empresas tenían la suerte de poseer una computadora. 9 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa SEGUNDA GENERACIÓN (1959-1964) Funcionaban en base a transistores. Unos siete años le llevó al transistor llegar a ser parte relevante de una computadora y cuando lo hizo cambió todo. Las computadoras se convirtieron en algo más pequeño, aún de grandes dimensiones pero jamás del tamaño de una habitación como sucedía en la primera generación. Dejar atrás las viejas válvulas que levantaban tanto calor redujo algunas dificultades y las computadoras se convirtieron en lo que vemos en foto. Se trata de la IBM 1401 y en la foto queda descripto cada componente de dicha computadora, un lector de tardeta (Card Reader), memoria de expansión (Memory), el CPU y la impresora. Con la llegada de esta máquina, mejoran los lenguajes de programación que hasta ese entonces eran apenas desarrollos limitados que requerían mucho conocimiento de hardware para utilizarlos. Es así como COBOL se transforma en el primer lenguaje fuerte. Se desarrollan muchos modelos de computadora y aparecen nuevos nombres de empresas como NCR y el grupo BUNCH, principal competidor de IBM en los 60s. TERCERA GENERACIÓN (1964-1971) La generación de los circuitos integrados (CHIP). La aparición en el mercado de unas pequeñas piezas electrónicas o “pastillas de silicio”, dentro de las cuales era posible integrar miles de componentes electrónicos, dio origen a lo que llamamos “TERCERA GENERACIÓN”. Hay que destacar que el primer CHIP se inventa en 1958 pero no es sino 6 años más tarde que llega al computador generando esta revolución. El que vemos en imagen es el IBM 360, de los primeros con CHIPs, como se aprecia los computadores hasta ese entonces no poseían monitores. Un detalle importante, la presencia de los chips permite flexibilizar las utilidades del computador. Sobre el final de esta generación, más precisamente en 1967, que se crean los diskettes, estos eran de 8 pulgadas. 10 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa CUARTA GENERACIÓN (1971 – 1981) La generación de la microminiaturización (microprocesador y chips de memoria). Conocida también por ser la generación del nacimiento de las PCs, se caracteriza por lograr que muchos componentes sean diminutos. Incide en ello la aparición del primer microprocesador, fabricado en 1971 por la empresa INTEL. Este dispositivo de procesamiento medía apenas 4 x 5 milímetros y se desarrolla en un lugar de Estados Unidos cuyo nombre es Silicon Valley (Valle del Silicio) en California. El lugar, con los años, se transformaría en casi un santuario de la era Informática, ya que desde el surgimiento del microprocesador numerosos serían los inventos originados allí, razón por la cual, como vemos en la imagen, las más importantes empresas de informática establecerían base en la zona. ¡Y estas son solo algunas de más de 500!. Pero es en los 70s que se producen grandes innovaciones, a los lenguajes de programación desarrollados con anterioridad, por citar unos: Pascal (1970), Unix (1968) y Lenguaje B (1969), se suma en 1972 el Lenguaje C. En Lenguaje C se crearían muchos sistemas operativos, uno de ellos es el propio Windows. Justamente en el 72 se funda Atari, empresa famosa mundialmente en aquel tiempo por la creación de videojuegos y ese mismo año se lanza la primera consola de videojuegos, la Magnavox Odyssey (foto). 11 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa Un año más tarde la empresa Xerox crea la primera computadora de escritorio de interface gráfica con mouse, la que es llamada Xerox Alto, desarrollo que no sería apoyado por el propio directorio de Xerox, pasando prácticamente desapercibido. También en el 72, junto con el primer virus de computadora, se crea el primer antivirus (el Reaper), que no afectaba las PCs porque estas aún no existían. En 1974 se conecta por primera vez dos redes diferentes a través de un cable, dando origen al término Ethernet, que hoy utilizamos para describir un tipo de conexión de red. En 1975, Bill Gates y Paul Allen fundan la empresa Microsoft. La primera computadora personal (PC) Dados tantos auspiciosos avances, no es extraño que justamente en esta década estalle una gran revolución, las computadoras dejan de ser objeto exclusivo de las empresas, bancos y organismos del gobierno y llegan a los hogares. Esto acontece en Abril de 1976, cuando Steve Jobs, un joven que en ese entonces ve lo que otros no veían, tras observar un proyecto personal de su amigo Steve Wozniak ve un potencial oculto en las computadoras, que hasta ese entonces las grandes compañías no veían. Juntos desarrollan la Apple I y la presentan en sociedad. El primer computador hogareño, de tamaño pequeño y con monitor. Por ese entonces se fabrica solo en partes, en carcasa de madera y con la intención de conectarlo a un aparato de TV. Un año más tarde se produce el gran estallido, Jobs y Wozniak, con su compañía Apple fundada, presentan Apple II, primer PC desarrollada a gran escala. La década del 70 ve nacer además en 1978 el primer procesador de textos (el WordStar) y en 1979 la primera hoja de cálculo (la VisiCalc). La cuarta generación, generación rica en avances en software y en hardware, culmina con el desembarco de IBM en el mercado de las PCs en 1981, a través de IBM PC, llegada que cambiaría muchas cosas. Aunque en estos apuntes destacamos solo algunos de los avances que se producen en cada época, es importante recalcar que no son los únicos, ¡son muchos más!. En nuestro caso realizamos una selección de los más trascendentes pero te invitamos a averiguar más. 12 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa QUINTA GENERACIÓN (1982 – 1989) La inteligencia artificial. La llegada de las IBM PC al mercado, le posibilita a mucha gente poder contar con un computador en casa, ya que hasta ese entonces otras opciones como Apple II eran inalcanzables para muchos bolsillos. Las IBM PC cobran tal popularidad, que se convierten en el computador más vendido en el mundo entero y como consecuencia la mayoría de las empresas desarrolladoras de software, comienzan a crear programas para ellas. Una de esas empresas es Microsoft, que en 1982 crea D.O.S. (Disk Operating System –Sistema operativo de disco-). Un sistema operativo que dejábamos guardado en un diskette y con él podíamos iniciar la PC y trabajar. Luego, con el tiempo, podíamos dejarlo en nuestro disco rígido y arrancar nuestra PC de esa manera, sin ser necesario ningún diskette de arranque o inicio. ¿Qué ventaja tenía?, que a diferencia de las máquinas anteriores, en las que el sistema operativo venía grabado de fábrica en la máquina y no podíamos cambiarlo, en este caso SI podíamos hacerlo, teniendo actualizada nuestra computadora ¡siempre!. Es por esta razón que D.O.S. (el sistema operativo de Microsoft se considera el primer gran impacto de la empresa de Gates en el mercado informático). D.O.S., en sus diferentes versiones 1.0, 3.0, 4.01, 5.0 y 6.0 (son las más conocidas), se utiliza por muchos años desde su lanzamiento, pero es dejado atrás por primera vez en 1998 con la aparición de Windows 98. No obstante y a pesar de ello, hasta el día de hoy las diferentes versiones de Windows permiten a través del comando CMD acceder a dicha interface operativa. El avance del software durante los 80s Durante los 80s se crean miles de programas para PCs, software de todo tipo, antivirus, programas utilitarios, lenguajes, juegos, etc. La proliferación de dispositivos magnéticos de almacenamiento, en un formato mucho más pequeño, seguro y de mayor capacidad (los diskettes de 3½ pulgadas aparecen en 1982), contribuyen en gran medida a través de la copia en ello. Todo programa que tengas en un diskette podía ser copiado, en la mayoría de los casos con gran facilidad a otro diskette a través de un comando denominado DISKCOPY. En otros casos eran necesarios programas especiales, capaces de violar cualquier protección de lectura y escritura en el copiado. 13 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa ¿PC XT o PC AT? Pero no es solo en software que se avanza, también en hardware. IBM que había causado sensación con su PC XT 8086 (8086 era el modelo de microprocesador que contenía), crea el 8088 y lanza su modelo PC XT 8088. Consigue con ello mejorar la velocidad de procesamiento y al poco tiempo lanza el 80286, al que denomina AT 286. IBM PC AT 80286 para ser más exactos. La evolución es muy grande, es una computadora mucho más rápida, internamente su bus de datos (ancho del cable de transmisión de datos), es más amplio, se habla ya de transmisión de de 16 bits (antes era de 8) y surgen luego la 80386 (o 386 como la gente le decía), la 80486 y tiempo después PENTIUM. Deseosas de recoger frutos de este gran avance mundial, muchas empresas se atreven a lanzar sus modelos de PCs, por citar las más conocidas, EPSON, HP (Hewlett Packard), ACER, COMPAQ, pero además decenas de otras marcas ni siquiera conocidas. Por fuera no eran IBM, pero por dentro tenían los mismos componentes que las IBM, ya que las originales internamente utilizaban componentes de otras marcas como INTEL, SOYO, etc. Comienza a denominarse a estas nuevas computadoras CLONES o simplemente PCs. Los microcomputadores En esos años quien marcaba tendencia era Estados Unidos y la llegada de cada pieza de hard a la Argentina, a España y a otros países, demoraba mucho tiempo. El costo inicial de las PCs era elevado, razón por la cual desde los 70s se desarrolló un mercado paralelo en el cual se creaban otro tipo de computadoras. Computadoras más económicas y pequeñas, que en un principio se conectaban a un televisor y aunque venían con un sistema operativo grabado de fábrica, eran programables y su memoria era expandible. La de la imagen es solo una de ellas, la Sinclair ZX 81. 14 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa Con el tiempo los microcomputadores se convirtieron en pequeños dinosaurios en extinción, con la evolución y el abaratamiento de las PCs, dejándoles todo el campo abierto para que se establecieran en cada hogar, comercio, oficina y escuela. Una radical diferencia entre las PCs y los microcomputadores, los segundos en un principio no operaban con diskettes, los programas se cargaban con cassettes de audio de cinta magnética o cartridges a través de un grabador o un dataset (era como un grabador) y en algunos casos unas ranuras para inserción de cartridges y memorias. Recién sobre el epílogo de la historia de los microcomputadores, aparecieron las unidades lectoras de diskette. Hoy los microcomputadores son apenas una anécdota. Grandes avances de la década En esta generación Apple lanza el primer computador personal con interface gráfica (aspecto visual), controlado por un ratón o mouse, en 1984 lanza Apple Macintosh (foto). En esta década, además, las compañías Phillips y Sony crean el primer CD-ROM, HP lanza su primera impresora láser (LaserJet), la empresa Adobe crea el primer documento en formato Poscript (antecesor de los documentos que hoy leemos en PDF), surgen el MP3 y se desata un gran escándalo entre Microsoft y Apple, por denuncia de robo, cuando Bill Gates presenta Windows 1.0 en 1985 y es acusado de plagio por Jobs. 15 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa Inteligencia artificial Pero no son los clones, ni los microcomputadores, ni el CD-ROM, ni la primera impresora láser, ni el MP3 ni Windows ni la MAC quienes dan identidad a esta quinta generación, sino un concepto que vamos a explicar de manera muy sencilla. ¿Quién no vio la película “Terminator”? Para aquellos que no la vieron, se trata de una máquina que un día decide valerse por sí misma, considera que tiene y sabe todo lo que necesita para vivir y ve en el hombre, su creador, la única amenaza posible. Es por esa razón que decide destruirlo. ¿Qué tiene que ver esto con la quinta generación de computadoras?. Bien, el guión de la película fue escrito durante esta década, tras los anuncios del proyecto de creación de una supercomputadora, a cargo de la firma Seymouy Cray en 1982 (la película fue estrenada en 1984) y el mega-proyecto japonés denominado “quinta generación” que apuntaba a lo mismo. ¿En qué consistía el proyecto? Consistía en desarrollar una super máquina tan poderosamente programada y equipada, que fuera capaz de aprender por sí misma a través de procesos tan avanzados, que no hubiera forma de diferenciarla con el hombre. Se integraron al proyecto varios países y la finalización del mismo estaba pactada para 1992, aunque jamás se dieron a conocer resultados ni detalles específicos de los avances. ¿EXISTIRÁ UNA SUPERCOMPUTADORA? TRABAJO PRÁCTICO Nº 15 1) Investigando, descubre al menos 3 avances más que consideres importantes de la quinta generación y que no hayan sido citados en estos apuntes. Menciónalos y describe de qué se trata cada uno. ……………………………………………………………………………………………………………………………………… ……………………………………………………………………………………………………………………………………… ……………………………………………………………………………………………………………………………………… ……………………………………………………………………………………………………………………………………… ……………………………………………………………………………………………………………………………………… 16 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa SEXTA GENERACIÓN (1990 al presente) El multiprocesamiento y la conectividad global. Aunque muchos expertos informáticos no logran ponerse de acuerdo en el año de inicio de esta generación, algunos dicen 1990, otros 1992, si coinciden en los hechos que le dan origen. Multiprocesamiento: capacidad de un procesador para realizar varias tareas al mismo tiempo. Conectividad global: poder estar conectado a cualquier parte del mundo. Sin duda alguna los hechos que dan origen a esta generación son el gran avance en materia tecnológica en la fabricación de componentes capaces de hacer muchas cosas al mismo tiempo y el auge de Internet. Hablamos de procesadores integrados por muchos elementos más pequeños, capaces de realizar ¡1 millón de operaciones aritméticas en simultaneo por segundo!. Hablamos también de disponer de tanta tecnología en hardware, que hoy en día casi no son necesarios los cables para conectarnos, en movilidad, con el punto más distante del planeta. En velocidad ya casi no hay límites, en alcance tampoco. Para lograr esto, el hombre tuvo que avanzar mucho tecnológicamente y en ese avance debió rediseñar en algunos casos completamente la arquitectura de lo que había desarrollado, sostenido por una tecnología cada vez más eficiente y veloz. Pero veamos cuando llegó la velocidad y cuando la conectividad. 17 [HISTORIA DE LA INFORMÁTICA] Prof. Mariano Correa La velocidad, aunque es una herencia de las primeras máquinas, podemos sentenciar que se vio mayormente beneficiada con la microminiaturización de los componentes (cuarta generación), potenciada con la aparición de los multiprocesadores entre comienzos y mediados de los 90s. De allí en más el resto lo hizo una nueva forma de conectarse, en la que cables, aire (ondas) y satélites intervienen ya casi de manera indiscriminada. Gran parte de eso comenzó en 1991 con el surgimiento de la World Wide Web (WWW), el servicio más utilizado de Internet. La posibilidad de comunicar algo a través de documentos de hipertexto (lo que hoy conocemos como páginas web), abrió las puertas a grandes avances que con el tiempo integrarían no solo a computadoras, sino también a dispositivos móviles como teléfonos celulares, tablets, netbooks, notebooks, smartvs y toda una gama de nuevos dispositivos que comenzarían a desarrollarse gracias a esta nueva forma de comunicación. Pero vamos paso a paso: 1991 – Surge la World Wide Web. La gente comienza a acostumbrarse a “navegar por internet” (entrar y salir de páginas web buscando información). 1992 – El mundo ya cuenta con 1 millón de computadoras conectadas a internet. 1993 – Surge el primer sitio de búsqueda global de información (como hoy lo es Google). 1996 – Ya son 10 millones de computadoras las conectadas a internet. 2000 – “Estallido burbuja.com” (así se denomina a una época en la cual las páginas web hicieron millonarias a muchas empresas y personas y por otro lado llevaron a la quiebra y a la desaparición a otras). 2007 – Steve Jobs lleva internet al teléfono celular con el lanzamiento del iPHONE. Con el tiempo todas las compañía de hardware de telefonía harían lo propio. Nace así una nueva forma de navegar y conectarse a internet, vía móvil. TRABAJO PRÁCTICO Nº 16 1) Elabora un resumen no mayor a 10 líneas, acerca de los inventos que sirvieron de antecedente a la creación del primer computador. 2) Sintetiza en no más de 3 líneas por generación, que destacas de cada una de ellas. 3) Elabora un resumen final sobre las seis generaciones de la Informática. 4) Selecciona uno de los temas aquí mencionados y profundiza su investigación elaborando un informe de al menos 2 páginas sobre él. 18