Document

Anuncio

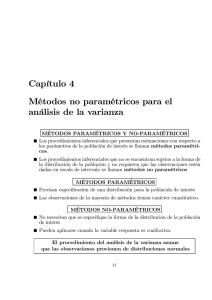

CONTRASTES NO PARAMÉTRICOS:

BONDAD DEL AJUSTE Y TABLAS DE CONTINGENCIA

Antonio Morillas

A. Morillas: C. no paramétricos (I)

1

CONTRASTES NO PARAMÉTRICOS:

BONDAD DE AJUSTE Y TABLAS DE CONTINGENCIA

Inferencia realizada hasta ahora:

•

Una muestra aleatoria (n) Æ las xi son variables

aleatorias independientes en el muestreo Æ estimador

Æ distribución del estimador Æ inferencia

•

Modelo de población conocido, salvo sus parámetros

Queda por comprobar (para una inferencia correcta):

•

Si el modelo es consistente con la muestra (ajuste)

•

Si las observaciones (variables) xi son realmente

independientes (aleatoriedad e independencia)

•

Si la población cambia o no entre dos muestras

distintas (homogeneidad)

A. Morillas: C. no paramétricos (I)

2

CONTRASTES NO PARAMÉTRICOS:

BONDAD DE AJUSTE Y TABLAS DE CONTINGENCIA

1.

Contrastes de bondad del ajuste

a. χ2 de Pearson

b. Kolmogorov-Smirnov

c. Contrastes específicos de normalidad

a. Lilliefors

b. Jarque-Bera

c. Shapiro-Wilks

2. Contraste de independencia (asociación). Tablas de

contingencia

3. Contraste de homogeneidad

A. Morillas: C. no paramétricos (I)

3

CONTRASTE DE BONDAD DE AJUSTE χ2

f(x)

X/H0

H0: f(x)=f0(x)

pi =

Li

∫f

0

( x ) dx

Li −1

pi

fi

Li-1

Li

X

fi=ni /n

ni=nfi

fi

Li-1

Li

A. Morillas: C. no paramétricos (I)

X

4

ESTADÍSTICO DE PRUEBA

1.

ni ∼ B(n, pi ), marginal de una multinomial:

ei=E(ni )=npi Æ Bajo H0: ei = npi0

2.

Si ei=E(ni )=npi ≥ 5 y pi es pequeña (Poisson):

ni − npi ni − ei

=

∼ N (0,1)

npi

ei

3.

Para prescindir del signo de (ni – ei), se eleva al

cuadrado: [N(0,1)]2 ~ χ21

4.

Discrepancia total en los k intervalos: Σk χ2

5.

Bajo H0 :

k

k (n − ei ) 2

∼ χ 2k − 1 , ya que ∑ ni = n

∑ i

ei

i =1

i =1

A. Morillas: C. no paramétricos (I)

5

PROCESO DE CÁLCULO

1.

Tabulación de la muestra en clases (k ≥ 5 y ei ≥ 5 )

2.

Cálculo de las probabilidades teóricas (pi), bajo H0.

3.

Obtener las frecuencias esperadas: ei=npi

4.

Obtener la χ2obs Æ valor muestral de ∑(ni-ei)2 / ei

5.

Si χ2obs ≥ χ21-α (cola derecha), rechazar H0 Æ la discrepancia

es significativa

Nota: Si no se conocen los r parámetros poblacionales en H0 , se

estiman por máxima verosimilitud y se reducen los grados de

libertad en r :

k ( ni − ei )

∑

i =1

ei

2

∼χ

2

k − r −1

A. Morillas: C. no paramétricos (I)

6

RESUMEN TEST χ2

• Hipótesis nula: Ho: f(x) = fo(x) Æ H0: pi = pi0 , i=1, 2, ...,k

• Base del test: discrepancia entre ni (muestra) y ei=npi (Ho)

Intervalos

< L1

L1 – L2

..

Li-1 – Li

..

Lk-1 y más

Frecuencias Probabilidad

observadas

intervalo

ni

pi /H0

Frecuencias

esperadas

ei

Valor del

estadístico

(ni-ei)2 / ei

n1

n2

..

ni

..

nk

p1

p2

..

pi

..

pk

e1 = np1

e2 = np2

..

ei = npi

..

ek = npk

(n1-e1)2 / e1

(n2-e2)2 / e2

..

(ni-ei)2 / ei

..

(nk-ek)2 / ek

∑ni = n

∑ pi = 1

∑ ei = n

χ2obs.

A. Morillas: C. no paramétricos (I)

7

COMENTARIOS SOBRE EL TEST χ2

1.

Aplicable a variables continuas (agrupadas en intervalos) y

discretas

2.

Muestra y número intervalos grandes (ei = npi ≥5 )

3.

Estadístico, según parámetros en H0 :

1. Especificados Æ χ2k-1

2. No especificados (r) Æ χ2k-r-1 (EMV o χ2-mínimos)

4.

Es un test asintótico Æ sensible al valor de n Æ Distinguir

entre significación estadística y significación real. Para c > 1:

2

(cni − cnpi ) 2

χ obs.(c.n) = ∑ cnp = c χ obs.

i =1

i

2

k

A. Morillas: C. no paramétricos (I)

8

TEST DE KOLMOGOROV-SMIRNOV

F0 (x)

Fn (x)

Hipótesis nula Æ H0 : F(x) = F0 (x)

Fn (x)

Fn (x(n))=1

Fn (x(i) )

F0 (x)

D2 (xi )

F0 (xi )

D1 (xi )

Fn (x(i-1) )

Fn (x(2) )

Fn (x(1) )

x(1)

x(2) ......... x(i-1)

x(i) ................

x(n)

X

Estadístico de prueba: Dn= max {D1 (xi ) ∪ D2 (xi )}

A. Morillas: C. no paramétricos (I)

9

RESUMEN TEST K-S

• Hipótesis nula: H0: F(x) = F0(x), especificada en

forma y en parámetros.

• Estadístico de prueba: Dn=max ⎨D1(x(i)) ∪ D2(x(i))⎬ ,

i=1,2,...,n

• Región crítica: Dobs.≥ Dn , rechazar H0 (el modelo

propuesto no es válido).

• Aplicable sólo a variables continuas. Puede utilizarse

para muestras pequeñas.

A. Morillas: C. no paramétricos (I)

10

CÁLCULOS EN K-S

x(i)

Ni

Fn(x(i))

F0(x(i))

D1(x(i))

D2(x(i))

x(1)

x(2)

..

x(i)

..

x(n)

N1

N2

..

Ni

..

Nn

Fn(x(1))

Fn(x(2))

..

Fn(x(i))

..

Fn(x(n))

F0(x(1))

F0(x(2))

..

F0(x(i))

..

F0(x(n))

D1(x(1))

D1(x(2))

..

D1(x(i))

..

D1(x(n))

D2(x(1))

D2(x(2))

..

D2(x(i))

..

D2(x(n))

D1(x(i) ) = |Fn(x(i-1) ) - F0(x(i) )| ; D2(x(i) ) =|Fn(x(i) ) - F0(x(i) )|

A. Morillas: C. no paramétricos (I)

11

TEST DE NORMALIDAD DE LILLIEFORS

• Adaptación de K-S al caso de una normal con parámetros

desconocidos.

• Hipótesis nula: H0: F(x) = Normal ; parámetros desconocidos.

• µ y σ2 se estiman de la muestra, mediante x y ŝ 2 .

• Estadístico de prueba: Dn=max ⎨D1(x(i) ) ∪ D2(x(i) )⎬ , el mismo

que el de K-S, pero los valores críticos cambian. Hay que

mirarlos en la tabla obtenida por Lilliefors.

• La potencia de este test para un tamaño muestral no muy

grande es baja. Por tanto, necesita muestras grandes (n ≥ 100).

A. Morillas: C. no paramétricos (I)

12

TEST DE NORMALIDAD DE JARQUE-BERA

• Contrastes de asimetría y apuntamiento:

• H0 : X es simétrica Æ Estadístico de asimetría:

n

3

x

x

(

−

)

∑ i

α

1

6

~ Z , para n ≥ 50

i =1

α1 =

~ N ( µ = 0, σ =

)

6n

3

ns

n

•H0 : X es mesocúrtica Æ Estadístico de apuntamiento:

n

∑ ( xi − x )

α 2 = i=1

ns 4

4

~ N ( µ = 3, σ = 24 n )

α2 − 3

24 / n

~ Z , n ≥ 200

• Región crítica de 2 colas: Zobs ≤ Zα/2 o Zobs ≥ Z1-α/2

A. Morillas: C. no paramétricos (I)

13

TEST DE NORMALIDAD DE JARQUE-BERA

• Contraste de normalidad:

• H0 : X es normal Æ Estadístico de prueba:

⎛ α1 − 0 ⎞

2

⎛ α2 − 3 ⎞

2

⎜

⎟ ∼ χ2

⎟ +⎜

⎝ 6 / n ⎠ ⎝ 24 / n ⎠

2

n ⎛ 2 (α 2 − 3)

⎜⎜ α1 +

6⎝

4

2

2

⎞

⎟⎟ ∼ χ

2

⎠

• Región crítica: si α1=0 y α2=3 Æ χ2 =0 (aceptaríamos H0).

2

Por tanto, la RCO estará a la derecha: χ obs

≥ χ 22; 1−α

• Se trata de un test para muestras grandes

A. Morillas: C. no paramétricos (I)

14

TEST DE NORMALIDAD DE SHAPIRO-WILKS

RECTA PROBABILÍSTICO NORMAL

E ( x( i ) ) = µ + σ ci ,n

(c1,7 )

(c2,7 )=q1

(c4,7 )= Me

Z (ci,7 )

(c5,7 )

(c7,7 )

Si H0 es cierta: E[(x(i) - µ) /σ ] = ci,n

(c3,7 )

(c6,7 ) =q3

x(1)

x’(1)

x(2)

x(3)

x’(2) x’(3)

x(4)

x’(4)

x(5)

x’(5)

A. Morillas: C. no paramétricos (I)

x(6) x(7)

x’(6)

X

Muestra 1

x’(7) Muestra 2

15

ESTADÍSTICO DE SHAPIRO-WILKS

GRÁFICO Q-Q

x(6)

x(i)

x(7)

x(4)

x(5)

x(2)

x(1)

σ

E[x(i)]= µ + ci, n σ

x(3)

µ

⎛ s x( i ) , c i , n ⎞

⎟

w =r = R =⎜

⎜ s x sc ⎟

⎝ ( i ) i ,n ⎠

2

ci, n

2

2

Si ωobs< ωαÆRechazar H0

A. Morillas: C. no paramétricos (I)

16

TEST DE NORMALIDAD DE SHAPIRO-WILKS

• Si H0 : X ~N(µ,σ), el valor esperado de la observación muestral

i-ésima (cuantil), tipificada, vendrá dado por un cuantil en Z:

⎛ x( i ) − µ ⎞

E ( x( i ) ) = µ + ci ,nσ

E⎜

⎟ = c i ,n

⎝ σ ⎠

• Los datos muestrales deberían estar próximos a esta recta

• El test mide esa proximidad, estudiando la bondad del ajuste,

gráfico q-q, entre los cuantiles x(i) y los cuantiles ci,n (w = r2):

2

⎤

1 ⎡

A

w = 2 ⎢∑ a( j ),n (x( n− j +1) − x( j ) )⎥ = 2

ns

ns ⎣ j =1

⎦

q

2

• n par Æ q=n/2

• n impar Æ q=(n-1)/2

• RCO Æ wobs ≤ wα

• Muestras pequeñas (n < 30). Potente. Los a(j),n están tabulados

A. Morillas: C. no paramétricos (I)

17

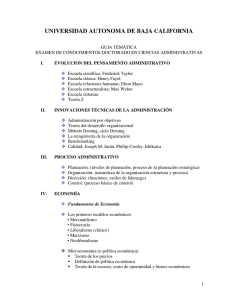

RESUMEN BONDAD DE AJUSTE

TIPO DE HIPÓTESIS TAMAÑO

VARIABLE

MUESTRA

NULA

Chi-cuadrado Cont. o disc. No especif.(r) Grande

Especificada Pequeño

Kolmo.-Smir. Continua

Grande

K-S-Lilliefors Continua (N) No especif.

Continua (N) No especif.

Grande

Jarque-Bera

Pequeño

Shapiro-Wilks Continua (N) No especif.

TEST

A. Morillas: C. no paramétricos (I)

18

TABLAS DE CONTINGENCIA

TABLA DE CONTINGENCIA

Característica B

1

n11

2

n21

..

..

i

ni1

..

..

r

nr1

Total n

.1

Característica A

1

r

2

..

j

..

s

Total

n12

n22

..

ni2

..

nr2

n.2

..

..

..

..

..

..

..

n1j

n2j

..

nij

..

nrj

n.j

..

..

..

..

..

..

..

n1s

n2s

..

nis

..

nrs

n.s

n1.

n2.

..

ni.

..

nr.

n

s

∑∑n

i =1

j =1

ij

=

r

∑n

i =1

i.

=

s

∑n

j =1

.j

=n

A. Morillas: C. no paramétricos (I)

19

CONTRASTE DE INDEPENDENCIA

• H0: independencia Æ H0: pij = pi. . p.j , i=1,2,...,r ; j=1,2,...,s

• Aplicando el criterio de la χ2 de Pearson (frecuencias

observadas-esperadas):

r

s (n − e ) 2

2

ij

ij

∼χ

; eij = npij

∑∑

1

−

rs

eij

i =1 j =1

• Si H0 es cierta Æ pij = pi. . p.j , la expresión anterior queda como:

2

r

s

∑∑

i =1 j =1

(nij − npi. p. j ) 2

npi. p. j

∼χ

Densidades conocidas

2

rs −1

ni .

pˆ i . =

n

ni.n. j ⎞

⎛

⎜ nij −

⎟

r

s

2

n ⎠

⎝

∼χ

∑∑

( r −1)( s −1)

ni.n. j

i =1 j =1

n rs-1-(r-1)-(s-1)

Densidades desconocidas

A. Morillas: C. no paramétricos (I)

20

Característica A

CONTRASTE DE HOMOGENEIDAD

Muestras o experimentos

1

2

..

j

..

s Total

1

n11 n12 .. n1j .. n1s n1.

2

n21 n22 .. n2j .. n2s n2.

..

..

..

..

..

..

..

..

i

ni1 ni2 ..

nij

.. nis

ni.

..

..

..

..

..

..

..

..

r

nr1 nr2 .. nrj .. nrs

nr.

Total n.1 n.2 ..

n.j

.. n.s

n

A. Morillas: C. no paramétricos (I)

21

OBJETO E HIPÓTESIS NULA

Objeto: Comprobar si las muestras provienen de la misma

población (poblaciones homogéneas para variable A)

Repetición de un experimento multinomial (s veces)

Igual proporción de observaciones en cada categoría de la

característica A

H0: La probabilidad de éxito en cada categoría es la misma:

H0 : pi1 = pi2 = ... = pij = ... = pis = pi. , ∀ i =1,2,...,r

A. Morillas: C. no paramétricos (I)

22

ESTADÍSTICO DE PRUEBA

H0 es compuesta Æ Test de la RV Æ Se demuestra que la χ2 del

test de la RV (-2 ln λ), coincide con el test de independencia Æ

Discrepancia entre valores observados y esperados.

Los valores esperados son:

• eij = E(nij ) = n. j pi . Æ si se conocen las pi teóricas

• eij = n. j (ni . /n) Æ si se estiman de la muestra por MV

2

ni.n. j ⎞

⎛

⎟

⎜ nij −

r

s

2

n ⎠

⎝

Estadístico prueba (RCO derecha): ∑∑

∼χ

( r −1)( s −1)

ni.n. j

i =1 j =1

(r-1)s con las pi conocidas

(r-1)s-(r-1)

n

A. Morillas: C. no paramétricos (I)

23