Diapositivas tema 1 Archivo

Anuncio

Extracción de Señales - Tema 1

Profesora: Ana Laura Badagián

I.

II.

III.

IV.

V.

Descomposición de una serie de tiempo.

Análisis espectral univariante.

Introducción al análisis de Fourier.

Estimaciones del espectro poblacional.

Introducción al análisis espectral multivariado.

James D. Hamilton, (1994):

Time Series

Analysis, Chapter 6: Spectral Analysis, pp:

152-179. Princeton University Press, New

Jersey

Las razones para desagregar una serie de tiempo

económica en sus componentes inobservables se

explicitan al inicio del capítulo 4 del libro de Espasa y

Cancelo (1993):

“El análisis de la coyuntura de un fenómeno

económico normalmente no se realiza directamente a

través de la evolución de sus datos originales, ya que

éstos contienen muchas oscilaciones de escaso

interés económico que pueden llevar a conclusiones

equivocadas. Por el contrario, dicho análisis se

efectúa a través de señales extraídas de los datos,

que sirven de estimación de lo que un analista puede

considerar como un aspecto esencial del fenómeno

en cuestión.”

Los datos originales de una serie económica

presentan grandes oscilaciones, muchas de las

cuales no son de interés desde el punto de vista

del análisis económico. Así, los aspectos

esenciales de un fenómeno económico no son

directamente observables, con lo cual es

necesario disponer de procedimientos que

permita cuantificarlos a partir de la información

disponible (los datos originales). Al analista

corresponde definir cuál o cuáles componentes o

señales son de interés.

Los componentes inobservables de una serie temporal son

básicamente:

a)

El componente tendencial o tendencia, Tt , que recoge

aquella parte de la evolución de la serie que se encuentra

relacionada con factores de largo plazo (persistentes).

b)

El componente estacional, St , se encuentra asociado a

las oscilaciones cuasicíclicas que se cancelan al interior

del año (12 meses, 4 trimestres, etc.).

c)

El componente cíclico, Ct , que recoge las fluctuaciones

cuya periodicidad es mayor al año, pero inferior al "largo

plazo“.

d)

El componente irregular, It , cuya estructura es aleatoria y

contiene las oscilaciones no sistemáticas que afectan

puntualmente a la serie considerada. Se suele caracterizar

este componente como un proceso estocástico ruido

blanco.

La serie observada surge, entonces, de la

agregación de los cuatro componentes. El formato

de la agregación depende de que el modelo

subyacente

sea

aditivo

o

multiplicativo,

respectivamente. Así, en el caso aditivo:

Yt = Tt + Ct + St + It ,

mientras que en el multiplicativo,

Yt = Tt . Ct . St . It .

El componente inobservable sobre el que el analista

concentra su atención suele denominarse señal de

interés.

Desde el punto de vista metodológico, existe un

incentivo por utilizar procedimientos que tengan

propiedades conocidas y deseables desde el

punto de vista teórico para analizar las

fluctuaciones macroeconómicas. Este aspecto

implica

contar

con

procedimientos

de

descomposición

que

especifiquen

las

características del componente que se desea

estudiar y que sea posible su estimación a partir

del análisis de los datos originales.

Extracción de señales es una expresión tomada del

campo de la ingeniería: los sistemas de audio tienen

un parámetro, el denominado “coeficiente de señalruido”, que define la calidad de los sonidos emitidos).

En este campo, la extracción de señales se realiza a

partir de un sistema que filtra la “señal de interés” (la

música) eliminando el ruido (distorsiones que afectan

al sistema de audio).

El punto de partida de los procedimientos de extracción

de señales es, entonces, que en la práctica la

información que proporciona la observación y medición

de un fenómeno (económico) se encuentra

contaminada. Por ello, es necesario “filtrar” los datos

de modo de recuperar la “señal” que ellos contienen.

Observación: La señal “pura” nunca se observa, por lo

que siempre se está expuesto a cometer errores.

El tema metodológico planteado no es en absoluto trivial

y se traduce básicamente en un problema de filtrado de

los datos originales.

Un filtro es una combinación lineal de las observaciones

(originales) de una variable para distintos momentos del

tiempo, que se realiza con la finalidad de obtener una

estimación de una señal "deseada" por el analista.

Su aplicación siempre distorsiona el proceso original al

que se aplica. Muchas veces dichas distorsiones no son

precisamente

“deseadas”,

pudiendo

conducir

a

interpretaciones equivocadas sobre el comportamiento de

la variable analizada y a estimaciones sesgadas de sus

componentes inobservables. Por esta razón, resulta

importante contar con herramientas que permitan analizar

las propiedades estadísticas de dichas transformaciones.

La dependencia temporal en series económicas puede estudiarse

en el dominio del tiempo o en el dominio de la frecuencia.

En el primer caso, es necesario partir explicitando el proceso

estocástico que genera los datos como la suma de un

componente sistemático y una perturbación aleatoria

impredecible. La parte sistemática suele formularse como una

simple combinación lineal de observaciones y perturbaciones

pasadas, mientras que la parte impredecible se asimila a un

proceso estocástico ruido blanco.

El análisis en el dominio de la frecuencia, o análisis espectral,

interpreta el proceso estocástico de manera que el

comportamiento en el tiempo de la variable es el resultado de la

combinación (adición) de ciclos de distinta amplitud y duración.

El análisis espectral permite estudiar de qué forma las

diferentes periodicidades o frecuencias contribuyen a la

explicación de la variabilidad total de la serie.

Si bien los dos tipos de análisis aportan la misma

información sobre la serie observada desde diferentes

perspectivas, algunos aspectos del comportamiento de la

serie pueden visualizarse más fácilmente en el dominio del

tiempo y otros en el de la frecuencia.

El enfoque tradicional para el tratamiento de las series

económicas ha sido en el dominio del tiempo. No

obstante, la utilización del análisis espectral se revela

como más conveniente cuando el analista enfrenta un

problema que requiere la estimación de uno o varios de

los componentes inobservables.

Por un lado, cada procedimiento de descomposición

implica la aplicación de diferentes filtros o

transformaciones de los datos originales, los cuáles

tienen fuertes consecuencias en cuanto a la

atenuación de algunos ciclos o al realzamiento de

otros, siendo relevante analizar sus efectos, de modo

de no arribar a conclusiones erróneas respecto a la

señal de interés.

El análisis espectral proporciona las herramientas

para conocer cómo son afectadas las series en este

sentido, aportando información relevante acerca de

los efectos de los filtros que se aplican a series de

tiempo macroeconómicas.

Por otro lado, el análisis del comportamiento cíclico

de una serie macroeconómica en el dominio del

tiempo oculta un conjunto de influencias económicas

que provienen de ciclos de diferentes amplitudes y

longitudes, que pueden evidenciarse realizando la

descomposición de las fluctuaciones en diferentes

frecuencias cíclicas.

El nexo entre el dominio del tiempo y el análisis

espectral es la función generatriz de autocovarianzas,

cuyo análisis constituye la base para el estudio de las

propiedades cíclicas de las series de tiempo. La

función de autocovarianzas y/o la función de

autocorrelaciones contienen toda la información

sobre la dependencia temporal de una serie de

tiempo. En el dominio del tiempo la autocovarianza

de orden τ , que se anota γτ , se define como

para todo t entero, donde

es un proceso estocástico

real o más particularmente, la serie de tiempo en

estudio y µy su esperanza matemática.

De manera general, una función generatriz registra

la información sobre cierta secuencia.

Dada la secuencia ,

, posiblemente

compuesta por infinitos términos, la función

generatriz de dicha secuencia se define como:

La

variable

z

no

necesariamente

tiene

interpretación. Puede decirse que ella es portadora

de información sobre la forma en que se genera la

secuencia.

Sea ahora el proceso estocástico real

, cuya

varianza es igual a γ0 y la τ –ésima autocovarianza

igual a γτ .

Se define

como la secuencia de

autocovarianzas. Si dicha secuencia es absolutamente

sumable, la función generatriz de autocovarianzas

está dada por:

donde el argumento de la función, z, es un escalar

complejo.

Bajo tales condiciones, el proceso yt se puede formular a

través de la representación de Cràmer, es decir como la

suma infinita de funciones periódicas -senos y cosenostal que:

Para ω∈[-π,π], donde los coeficientes cω son

Utilizando que

la formulación de

Cramer puede reescribirse de la siguiente forma:

Esta representación de los procesos covarianza

estacionarios provee una forma matemáticamente

rigurosa de expresar la noción de que las series

macroeconómicas contienen componentes asociados con

fluctuaciones de diferentes frecuencias: los movimientos

lentos o de baja frecuencia asociados intuitivamente al

concepto de tendencia, los de frecuencia media que se

vinculan al ciclo, y por último, los movimientos rápidos o

de alta frecuencia relacionados a los factores estacionales

e irregulares.

La pregunta clave es entonces, ¿qué

frecuencias son dominantes y cuáles de

menor importancia para explicar los

movimientos de yt ? Una respuesta sencilla

a dicha cuestión la proporciona la función de

densidad espectral o espectro poblacional.

Usando el Teorema de De Moivre, cualquier número

complejo z puede expresarse como z = cos(ω)-i sen(ω)

= e-iω , donde i =√-1 y ω es el ángulo en radianes que

forma z con el eje real. Si en la función generatriz de

autocovarianzas z es reemplazado por e-iω y se divide

por 2π , la función resultante de ω se denomina función

de densidad espectral o espectro poblacional (o

sencillamente espectro) de yt :

donde -π < ω < π , o puede escribirse como:

Si la secuencia de autocovarianzas es absolutamente

sumable, el

espectro poblacional existe y tiene un

conjunto de propiedades importantes, a saber:

i) Es una función de ω, no negativa, continua y real.

ii) Si las γτ 's representan las autocovarianzas de un

proceso estocástico covarianza estacionario, entonces el

espectro será no negativo para todo valor de ω .

iii) Como cos(ωτ ) = cos(-ωτ ), el espectro es simétrico

alrededor de ω = 0 , de forma que Sy(ω) = Sy(-ω).

iv) Como cos(ωτ + 2π kτ ) = cos(ωτ), para cualquier k y τ

entero, el espectro es una función periódica de ω: S(ω)

=S(ω + 2π k). Así, el conocimiento del valor de S(ω) para

cualquier valor de ω en el intervalo [0,π] implica el

conocimiento de S(ω) para cualquier valor de ω .

De esta forma, el espectro constituye un recurso para

realizar la descomposición de la varianza de una serie por

sus frecuencias. El área debajo del espectro en el intervalo

[-π,π], es igual a la varianza de yt .

Esta propiedad brinda alguna idea sobre la interpretación

de la varianza en el dominio del tiempo, ya que la misma

es la suma del espectro a lo largo de todas las frecuencias

entre -π y π . La varianza de una serie económica se

distribuye desigualmente entre las frecuencias -excepto en

el caso de un proceso ruido blanco-, de forma que el

componente de crecimiento, el componente de ciclo

económico (business cycle) y el componente estacional

contribuyen de manera diferente a la variabilidad de la

serie analizada.

Una formulación más general de lo planteado es:

Así, el espectro de un proceso estocástico contiene la

misma información que la función generatriz de

autocovarianzas, ya que el mismo es simplemente una

combinación lineal de las autocovarianzas. Sin

embargo, la diferencia fundamental es que la función

de densidad espectral arroja luz sobre la importancia

de los componentes cíclicos para diferentes

frecuencias.

Puede definirse una función acotada no decreciente F(ω)

llamada función de distribución espectral que cumple:

donde gy(t ) es la función generatriz de momentos. La

función de distribución espectral determina una medida

F(A), llamada distribución espectral de la serie de tiempo,

donde Sy(ω)=F'(ω) y sobre la banda de frecuencias A se

cumple que

El cociente F(A)/γ0, proporciona información sobre la

contribución de los componentes asociados a las

frecuencias incluidas en A a la varianza del proceso.

Así, al visualizar el gráfico de la función de densidad

espectral de una serie, un pico puede interpretarse

como un indicador de un componente cíclico con un

período o longitud de onda constante e igual a 2π/ω

donde ω es la frecuencia correspondiente.

Algunos casos particulares de un espectro son los

siguientes:

1) Si el proceso generador de los datos es un ruido

blanco el espectro es una recta horizontal. Un ruido

blanco yt=εt , tiene varianza

y autocovarianzas

para

.

Así, la función generatriz de momentos es

el espectro es constante e igual a .

y

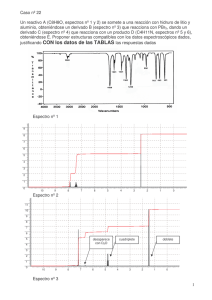

El gráfico del espectro de un ruido blanco con varianza 2π

se presenta en la figura 1. Se caracteriza por ser plano en

el nivel

para todas las frecuencias. De aquí viene el

término ruido blanco: así como una luz blanca, consiste en

un número infinito de frecuencias cuyo peso es el mismo.

¿Cuánto es el área debajo de la densidad espectral entre

las frecuencias -π y π?

Cuadro 1: Frecuencias y períodos en series trimestrales y anuales

2π

p=

ω

2) El espectro de una serie trimestral con estacionalidad y

tendencia presenta tres picos marcados en las

frecuencias cero, π/2 y π .

Esto significa en términos de períodos, que los

componentes que se asocian a un período infinito,

anual y dos trimestres son importantes para explicar

la variabilidad total de la serie en cuestión,

respectivamente. Justamente, el período infinito se

asocia a una señal suave o con fluctuaciones lentas

(frecuencia cero), que es característica esencial del

componente de tendencia.

Por otra parte, las series trimestrales estacionales

tienen la particularidad de presentar regularidades o

ciclos que se repiten casi sistemáticamente cada año

y al interior del año cada dos trimestres. Esto es

representado por los picos en las frecuencias π /2 y

π.

Si la serie de tiempo contiene una raíz autorregresiva

unitaria, el pico del espectro será infinito en la frecuencia

cero. Considérese el proceso estacionario AR(1):

con perturbaciones ruido blanco. El espectro del proceso

está dado por:

y es sencillo observar que

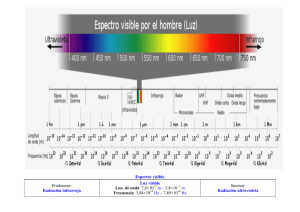

Una observación importante es que la frecuencia más alta –

período más bajo- sobre la que se tiene información directa

es π, la que se conoce como la frecuencia de Nyquist. Con

datos trimestrales, no se pueden detectar ciclos con una

mayor frecuencia que dos trimestres, ω = π , problema que

se relaciona con el tema de la agregación en el tiempo o

muestreo.

Este se refiere al proceso por el cual una señal continua se

mide a través de una secuencia de números discretos, por

ejemplo de periodicidad trimestral.

El inconveniente más serio relacionado a esto se denomina

aliasing, e implica que si una serie contiene ciclos con una

frecuencia mayor que la trimestral –por ejemplo, mensual-,

estos serán imputados a ciclos con una frecuencia entre

cero y π.

3) Granger (1966) plantea que la mayoría de las series

macreconómicas anuales presentan una "forma espectral

típica". La misma se exhibe en la figura 3. La característica

más evidente de la forma espectral típica identificada por

Granger es la elevada importancia que adquieren los

componentes asociados a las frecuencias bajas, aún

cuando la tendencia del proceso haya sido previamente

removida.

Este aspecto hace que la función de densidad

espectral univariada no sea por sí sola una

herramienta

“productiva”,

sino

que

debe

complementarse con los espectros multivariados, de

forma de comprender mejor las relaciones entre las

variables económicas.

Previo a la definición de los instrumentos del análisis

espectral multivariado se introducen algunos

conceptos del análisis de Fourier y se plantean

alternativas metodológicas para estimar la función de

densidad espectral.

La idea fundamental del análisis de Fourier es que

cualquier función determinística de la frecuencia ω,

puede ser aproximada por una suma infinita de

funciones trigonométricas, y a esta suma se le

denomina representación de Fourier.

Las funciones trigonométricas cos(ω) y sen(ω) son los

“bloques fundamentales” sobre los que se construye el

análisis de Fourier y la aproximación a toda función

periódica. Ambas son funciones cuyo período es 2π y

por tanto, cualquier combinación lineal de estas

funciones es también periódica de período 2π. Si se

considera una función f(ω) de la forma

donde {at} y {bt} son secuencias arbitrarias de

constantes sujetas a la restricción de que la serie infinita

planteada converja para todo ω, entonces f (ω) será una

función cuyo período es 2π.

Sea ahora

complejos con

una secuencia de números reales o

entonces existe una función definida en los complejos,

f (ω), llamada transformación de Fourier perteneciente al

intervalo [- π,π], tal que:

Una función f(ω) que es de particular interés, es el

espectro Sx(ω), que es la transformación de Fourier del

covariograma y como tal, es una especie de función

generatriz de covarianzas.

Por su parte, la inversa de la transformación de Fourier se

define como:

Por otro lado, si las frecuencias toman T valores igualmente

espaciados en el rango [0,2π], y siendo T el número de

observaciones de xt, entonces el intervalo de muestreo es

2π/T , y usando las frecuencias se tiene que:

el resultado es la transformación de Fourier discreta:

y su inversa:

El espectro poblacional fue expresado en función de la

secuencia

que son los momentos poblacionales de

segundo orden. Sea ahora, un conjunto de T

observaciones

. Se puede calcular hasta T-1

autocovarianzas muestrales a partir de las fórmulas

donde

es la media muestral.

Análogamente al espectro poblacional, se define el

periodograma muestral como

o como

De la misma forma que para el espectro poblacional

El periodograma muestral constituye una forma obvia de

estimar el espectro poblacional. Sin embargo, esta

aproximación presenta serias limitaciones. Sea el proceso

donde la secuencia

es absolutamente sumable

y

es una secuencia de variables aleatorias

independientes y semejantes con

Sea Sy(ω) el espectro poblacional y supóngase que Sy

(ω) > 0 para todo ω . Fuller demuestra que para todo ω≠0

y un tamaño de muestra lo suficientemente grande,

Además, para λ≠ω , la variable

y es aproximadamente independiente de la primera. Dado

que una variable que se distribuye χ2(2) tiene esperanza

igual a 2,

y como Sy(ω) es una magnitud poblacional

De esta forma, si el tamaño de muestra es lo

suficientemente grande, el periodograma muestral

proporciona un estimador aproximadamente insesgado del

espectro poblacional.

Sin embargo, el intervalo de confianza a un 95% para una

variable χ2(2), es (0.05, 7.4), de forma que resulta poco

probable que ^Sy(ω) sea menor que 0.025 y/o mayor que

3.7 veces el verdadero valor de Sy(ω) . La gran amplitud de

dicho intervalo permite establecer que el periodograma

muestral como estimador del espectro poblacional es

insatisfactorio.

Por otro lado, se espera que un estimador mejore a

medida que se utiliza un tamaño de muestra mayor.

Sin embargo, ^Sy(ω) no es consistente, es decir que

no se vuelve “más preciso” a medida que aumenta el

tamaño de la muestra, porque con éste también se

incrementa el número de autocovarianzas a estimar.

Otra desventaja es que tiene una apariencia

“irregular”, aún cuando se refiere a un proceso ruido

blanco, pues el número de frecuencias de Fourier en

un intervalo dado se incrementa de forma

aproximadamente lineal con el tamaño de la muestra

Ejemplo: Serie ci

cit = 0,9cit−1 + εt

εt ≡ N(0,1)

ci0 = 0

€

Periodograma

Muestral de ci

Periodograma de ci (Nro de observaciones = 200)

omega

frec escalada

periodos

0.03142

1

200.00

0.06283

2

100.00

0.09425

3

66.67

0.12566

4

50.00

……………………………………………………………….

3.01593

96

2.08

3.04734

97

2.06

3.07876

98

2.04

3.11018

99

2.02

3.14159

100

2.00

densidad espectral

1.5180

36.339

30.545

2.3750

0.12145

0.0038706

0.010269

0.011944

0.011360

Ejemplo PBI trimestral

Máx: 5 trimestres

A) Estimación paramétrica del espectro

Ya sea en el caso de que el verdadero proceso generador

de los datos sea un proceso ARMA(p,q) o que pueda ser

aproximado por el mismo, entonces los parámetros del

proceso pueden estimarse por máxima verosimilitud y el

espectro teórico puede calcularse a partir de ellos. Este

procedimiento consta de dos etapas básicas. En primer

lugar, se estiman los coeficientes de un proceso ARMA(p,q)

por máxima verosimilitud, donde los valores de p y q se

establecen de forma que el modelo se ajuste lo más

adecuadamente posible al verdadero proceso generador de

los datos

En segundo lugar, se sustituyen los parámetros estimados

φ1, φ2, φp, θ1, θ2, θq y σ2 en la expresión del espectro

donde ω∈[0,π].

Parzen (1969) demuestra que si el modelo ajustado es

autorregresivo puro de orden p

es decir que la varianza del espectro se incrementa con p.

Ello plantea un trade-off entre un mejor ajuste del modelo y

la minimización de la varianza del espectro. Por otro lado, p

no puede ser demasiado pequeño, pues el espectro

estimado puede resultar con un fuerte sesgo.

Berk (1974) muestra que el estimador espectral basado

en la modelización ARMA(p,q) es insesgado,

consistente y asintóticamente normal. Al basarse en un

modelo teórico tiende a ser más suave que el estimado

mediante las técnicas no paramétricas, que se verá a

continuación, y parece mostrar una alta resolución

siendo capaz de seleccionar picos angostos (Priestley,

1981). Aún si el modelo está incorrectamente

especificado, si las autocovarianzas del verdadero

proceso se encuentran cercanas a las de una

especificación ARMA(p,q) este procedimiento debería

proporcionar una útil estimación del espectro

poblacional (Hamilton, 1994).

B) Estimación no paramétrica del espectro

El periodograma muestral tiene una apariencia “irregular”,

pues el número de frecuencias de Fourier en un intervalo

dado se incrementa de forma aproximadamente lineal con

el tamaño de la muestra. Dicho problema se soluciona

mediante la suavización del espectro usando la técnica de

las ventanas espectrales, o en otras palabras,

promediando el periodograma muestral para diferentes

frecuencias.

La estimación no paramétrica del espectro parte del

supuesto de que Sy(ω) se encuentra cerca de Sy(λ)

cuando ω está cerca de λ . Esto sugiere que Sy(ω) podría

ser estimado mediante un promedio ponderado de los

valores de ^Sy(λ) para valores de λ en un entorno de ω,

donde los ponderadores dependen de la distancia entre ω

yλ.

Sea ˆSy(ω) una estimación de Sy(ω) y sea ωj = 2πj/T . La

sugerencia es tomar

donde h representa el parámetro de ancho de banda e

indica cuántas frecuencias {ωj±1, ωj±2,…,ωj±h} son utilizadas

para estimar Sy(ω). Por su parte, los términos

,

denominados ponderadores de kernel indican cuál es el

peso relativo de cada frecuencia, y cumplen que

Existen diferentes tipos de funciones kernel. Una

aproximación que se suele utilizar es

proporcional a

, y como

los ponderadores propuestos son

y el estimador del espectro es

Por ejemplo, si h=2

y el estimador del espectro es

Sˆ y (ω j ) =

2

2 + 1− m ˆ

∑ 3 2 Sy (ω j +m ) =

()

m=−2

1

2

3

2

1

= Sˆ y (ω j−2 ) + Sˆ y (ω j−1 ) + Sˆ y (ω j ) + Sˆ y (ω j +1 ) + Sˆ y (ω j +2 )

9

9

9

9

9

El promedio simple de ^Sy(ω) a lo largo de diferentes

frecuencias puede ser representado de manera

equivalente como sigue (véase, Hamilton, 1994; pág. 166):

con

El periodograma muestral (sin promediar) es un caso

particular del estimador de kernel en el que

.

Los ponderadores

son menores o iguales que uno en

valor absoluto, con lo que el estimador del espectro

planteado subpondera las autocovarianzas

en

relación al periodograma muestral.

Un estimador del espectro bastante popular utiliza la

función kernel de Bartlett modificada, la que está dada

por

El estimador de Bartlett es entonces

Las autocovarianzas de orden mayor a q son tratadas

como si fueran cero o como si Yt fuera un proceso MA(q).

La elección de h, el parámetro de ancho de banda y la

del parámetro q, en general se basa en criterios

subjetivos.

Mientras que el periodograma es asintóticamente

insesgado, aunque con varianza grande, el estimador del

espectro poblacional que se basa en el promedio del

periodograma para diferentes frecuencias tiene menor

varianza, pero introduce algún sesgo.

La severidad del sesgo depende de la rapidez con que

desciende el espectro poblacional y del tamaño del

ancho de banda.

Una forma de elegir h y q podría de esta forma, basarse

en los gráficos del espectro estimado usando diferentes

valores de dichos parámetros y hacer un juicio subjetivo

sobre cuáles son los valores más plausibles.

Ejemplo ci

Ejemplo PBI trimestral

Sea

un proceso estocástico estacionario n-dimensional

con vector de medias

y matriz de autocovarianzas de

orden τ dada por

Resulta fácil demostrar que a diferencia del caso univariado,

Γ(τ ) y Γ(−τ) no tienen por qué ser iguales, pero el elemento

ij-ésimo de Γ(τ ) es igual al elemento ji-ésimo de Γ(-τ ), para

τ = 1, 2,…, de modo que Γ(τ ) = Γ’(-τ ).

Si la secuencia

es absolutamente sumable, la

función matricial generatriz de autocovarianzas, también

denominada función generatriz de covarianzas cruzadas

se define como

donde z es un escalar complejo y

es una matriz de

números complejos de dimensión nxn. Se dice que el

vector de procesos estocásticos

es conjuntamente

covarianza estacionario si

no depende

de t, sino solamente de τ.

De la misma forma que para un proceso univariado, el

espectro multivariado o la función de densidad espectral

cruzada se obtiene sustituyendo en la función generatriz

de autocovarianzas z por e−iω y dividiendo por 2π :

donde ahora Sy(ω) es una matriz de dimensión nxn que

se encuentra conformada por los espectros de cada uno

de los procesos componentes del vector en la diagonal

principal y fuera de ella por los denominados espectros

cruzados.

Así, todos los elementos de la diagonal principal son

reales no negativos, mientras que los restantes

elementos son en general complejos para toda

frecuencia ω.

Por otro lado, al igual que la función matricial generatriz

de covarianzas, el espectro multivariado no es en

general simétrico, sino que el elemento ij-ésimo es el

complejo conjugado del elemento ji-ésimo.

El espectro multivariado, de la misma forma que el

univariado cumple que

es decir que el área debajo del espectro multivariado es

la matriz de varianzas y covarianzas condicionales de yt .

Una generalización de esta propiedad es

El caso bivariado permite apreciar de manera sencilla

estos conceptos. Sea

, donde cada uno de los

componentes del vector son procesos estocásticos

conjuntamente estacionarios, con espectros continuos

para toda frecuencia ω , Sy(ω) y Sx(ω) respectivamente.

La matriz de autocovarianzas del proceso bivariado será:

Γ

El espectro cruzado entre yt y xt se define como:

y la matriz del espectro bivariado es

donde Syy(ω), Sxy(ω) y Sxx(ω) se definen de forma

análoga a Syx(ω).

Por otra parte, usando las relaciones trigonométricas e -iωt

= cos(ωt) - i sen(ωt ), sen(ωt) = -sen(-ωt ) y sen(0) = 0,

resultan las siguientes expresiones:

Los elementos que se encuentran fuera de la diagonal

principal son magnitudes complejas y pueden

reformularse utilizando dos

cantidades reales, el

cospectro, co(ω) y la cuadratura espectral, qu(ω). Por

ejemplo, Syx(ω) puede escribirse como

donde

Estas dos funciones tienen las siguientes propiedades:

El cospectro entre yt y xt para una determinada frecuencia

ω se interpreta como la contribución a la covarianza entre

yt y xt que tienen los ciclos correspondientes a dicha

frecuencia. Resulta fácil observar que el cospectro puede

ser positivo para determinadas frecuencias y negativo para

otras, dado que las autocovarianzas pueden tomar ambos

signos.

La cuadratura espectral desde xt a yt para una cierta

frecuencia ω es una magnitud proporcional a la porción de

la covarianza entre yt y xt causada por los ciclos

correspondientes a la frecuencia ω. Estos ciclos pueden

ser muy importantes para cada una de las variables yt y xt

en forma individual, lo que se refleja en altos valores de

Sy(ω) y Sx(ω) y, sin embargo, no producir una alta

covariación contemporánea entre las variables porque para

un período determinado las dos series se encuentran en

diferentes fases del ciclo.

Las funciones de cospectro y cuadratura espectral se

relacionan con los conceptos de ganancia, fase y

coherencia, que son relevantes en el estudio del ciclo

macroeconómico.

Estos permiten realizar un estudio por frecuencias de la

correlación y el cambio de fase entre los principales

agregados macroeconómicos.

La ganancia se define como

es decir, es el cociente entre el espectro cruzado entre

yt y xt y el espectro de xt . Representa el coeficiente de

la regresión de la serie yt sobre xt para una determinada

frecuencia ω. Así, la función de ganancia mide el

incremento en la amplitud del ciclo correspondiente a

una determinada frecuencia ω de una serie yt dado un

incremento en la amplitud del ciclo correspondiente a la

misma frecuencia en la serie xt .

La función de fase expresada en radianes se define como

Para facilitar su interpretación se suele expresar en

unidades temporales a través de la operación Ph(ω)/ω,

que se anotará ph(ω). Esta función proporciona

información sobre el desfase - liderazgo o rezago- de

una serie respecto a la otra. Si ph(ω) es positiva

(negativa), los ciclos de Y asociados a la frecuencia ω

lideran (rezagan) a los ciclos de X caracterizados por la

misma frecuencia y el valor de dicha función indica por

cuántos períodos es el desfase.

Priestley (1981) y Hamilton (1994) plantean que las

funciones de ganancia y fase se relacionan de la

siguiente forma recomponiendo el espectro cruzado:

Por último, la coherencia entre dos series de tiempo se

define como

donde |.| denota la operación módulo. Es una función real

y cumple que 0 ≤ Coh(ω) ≤ 1. Es una medida del grado en

que dos series yt y xt se encuentran conjuntamente

influidas por ciclos correspondientes a una frecuencia ω.

Indica cómo es el movimiento conjunto de un grupo de

series de tiempo a lo largo del ciclo de negocios y cuán

fuerte es la correlación de las series para diferentes

frecuencias. Un valor próximo a uno (cero) para una

determinada frecuencia ω indica una elevada (escasa)

correspondencia entre las fluctuaciones con período 2π/ω

de las dos series.