Ética aplicada a las ciencias naturales y la tecnología

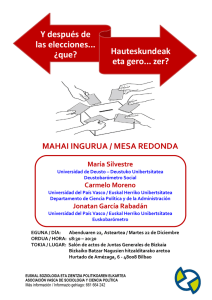

Anuncio