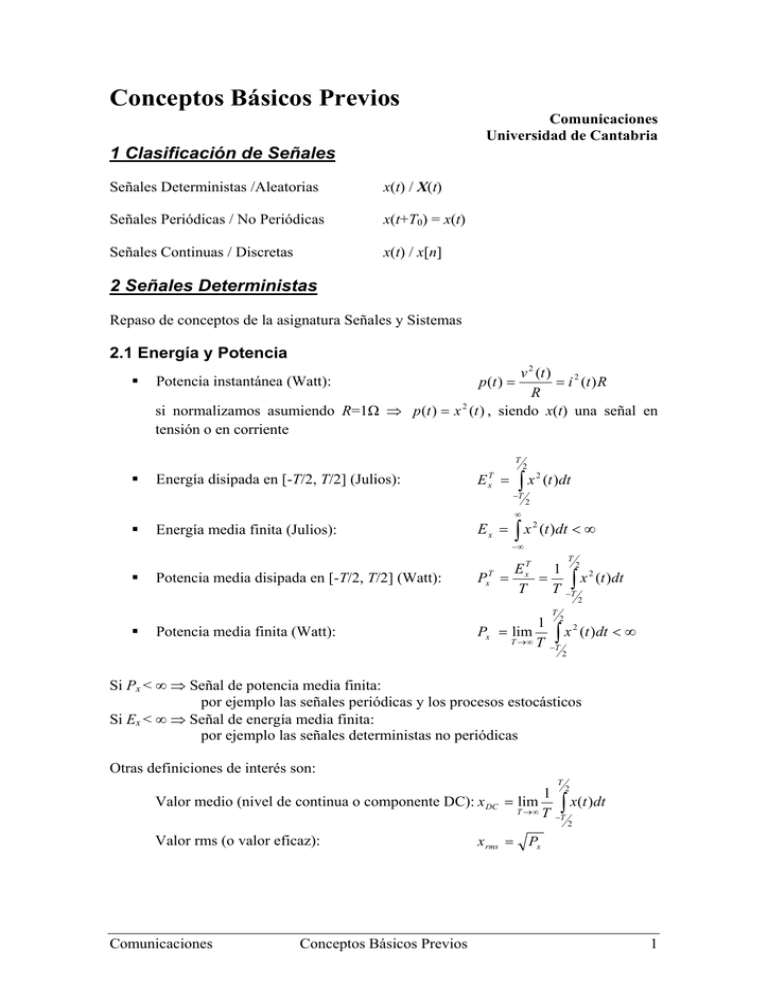

Conceptos Básicos Previos

Anuncio

Conceptos Básicos Previos

Comunicaciones

Universidad de Cantabria

1 Clasificación de Señales

Señales Deterministas /Aleatorias

x(t) / X(t)

Señales Periódicas / No Periódicas

x(t+T0) = x(t)

Señales Continuas / Discretas

x(t) / x[n]

2 Señales Deterministas

Repaso de conceptos de la asignatura Señales y Sistemas

2.1 Energía y Potencia

v 2 (t )

i 2 (t ) R

R

2

si normalizamos asumiendo R=1Ω p (t ) x (t ) , siendo x(t) una señal en

tensión o en corriente

Potencia instantánea (Watt):

p (t )

Energía disipada en [-T/2, T/2] (Julios):

E

T

2

x

T

x

T

2

(t )dt

2

Energía media finita (Julios):

x

Ex

2

(t )dt

T

Potencia media disipada en [-T/2, T/2] (Watt):

ET

1 2 2

PxT x

x (t )dt

T

T T

2

Potencia media finita (Watt):

1

T T

Px lim

T

2

x

T

2

(t )dt

2

Si Px < Señal de potencia media finita:

por ejemplo las señales periódicas y los procesos estocásticos

Si Ex < Señal de energía media finita:

por ejemplo las señales deterministas no periódicas

Otras definiciones de interés son:

T

Valor medio (nivel de continua o componente DC): x DC

1 2

lim x(t )dt

T T

T

2

Valor rms (o valor eficaz):

Comunicaciones

Conceptos Básicos Previos

x rms

Px

1

2.2 Caracterización frecuencial

Las señales de energía finita poseen Transformada de Fourier (TF):

X(f )

j 2 f t

x(t ) e

dt x(t )

X ( f )e

j 2 f t

df

Teorema de Parseval:

Ex

x (t )dt X

2

2

( f ) df ,

siendo X 2 ( f ) la Densidad Espectral de Energía (Julios/Hz).

Las señales de potencia media finita deterministas son las señales periódicas. Dado su

periodo T0=1/f0, su potencia se calcula como:

1

Px x 2 (t )dt

T0 T0

Estas señales no poseen TF1, sino Desarrollo en Serie de Fourier (DSF):

1

j 2f 0 nt

j 2f nt

x(t ) cn e 0 cn x(t ) e

dt

T0 T0

n

Teorema de Parseval:

Px

siendo S x ( f )

c

n

n

2

1

2

2

x

(

t

)

dt

cn ,

T0 T0

n

( f nf 0 ) la Densidad Espectral de Potencia (Watt/Hz).

Ejercicio 1) Dibujar las siguientes señales2 y calcular analíticamente y dibujar su TF

(o la DEP en el caso del apartado c).

a)

t

x(t )

T

b) x(t ) 2Wsinc(2Wt )

c)

1

2

x (t ) A cos( 2f 0 t )

solución: X ( f ) Tsinc( fT )

f

solución: X ( f )

2W

A2

solución: S x ( f )

( f

4

f0 )

A2

( f f0 )

4

Se puede decir que poseen TF formada por deltas de Dirac en múltiplos de la frecuencia fundamental f0.

1,

x

0,

x 0.5;

x 0.5.

Comunicaciones

1 x ,

x

0,

x 1;

x 1.

Conceptos Básicos Previos

sinc( x)

sin( x)

x

2

2.3 Autocorrelación determinista

Para señales de energía finita, la autocorrelación mide la similitud entre una señal y

una versión retardada de ella misma:

R x

x(t ) x(t )dt .

Algunas propiedades de la autocorrelación son:

TF

Rx

X( f )

2

R x R x

R x R x 0 E x

Si se consideran señales periódicas, de periodo T0=1/f0, la autocorrelación sigue la

expresión

1

R x

T0

T0

2

x(t ) x(t )dt ,

T0

2

y posee las siguientes propiedades:

TF

R x

Sx ( f )

R x R x

R x R x 0 Px

Ejercicio 2) Calcular y dibujar la autocorrelación de las siguientes señales.

t

a)

solución: Rx ( ) T

T

T

2

A

b) x (t ) A cos( 2f 0 t )

solución: R x ( )

cos( 0 ) con ω0=2πf0

2

2.4 Filtrado de señales deterministas

La señal de salida de un sistema lineal e invariante en el tiempo (LTI) se obtiene

convolucionando la señal de entrada con la respuesta al impulso del sistema.

x(t)

L.T.I.

y(t) = x(t)h(t)

h(t)

En el dominio de la frecuencia, es posible calcular la TF de la salida como el producto

de la TF de la señal de entrada con la respuesta frecuencial del sistema. En el caso de

2

señales periódicas, la DEP de la señal de salida es S y ( f ) S x ( f ) H ( f ) .

Comunicaciones

Conceptos Básicos Previos

3

3 Señales Aleatorias

En esta sección se realiza un repaso de los conceptos básicos de la teoría de la

probabilidad, las variables aleatorias y los procesos estocásticos tratados en las

asignaturas de Métodos Matemáticos para Telecomunicación y Tratamiento de Señales.

3.1 Teoría de la Probabilidad y Variable Aleatoria

En este apartado se considera, a modo de ejemplo, el estudio de un canal de

comunicaciones binario simétrico.

Fuente

0,1

0,1

Receptor

Canal

Es posible definir dos variables aleatorias discretas, X e Y, que representan,

respectivamente, el bit transmitido y el bit recibido. El rango de valores de dichas v.a.’s

es ΩX = ΩY = {0,1}.

Cualquier v.a. discreta queda completamente definida y caracterizada por las

probabilidades de ocurrencia de los valores del rango (en el ejemplo, P(X=0)=0.6 y

P(X=1)=0.4). A partir de dichas probabilidades es posible construir la función densidad

de probabilidad, fX(x), y la función de distribución de probabilidad, FX(x).

f X ( x)

FX ( x )

fX(x) 0.6

P( X x ) ( x x )

i

xi X

0.4

i

0

P( X x )u ( x x )

i

xi X

FX(x)

i

1

x

1

x

0.4

0.6

Otros estadísticos de interés son:

Media:

Varianza:

E[ X ] X

0

x P( X x ) 0 P( X 0) 1P( X 1) 0.4

xi X

i

i

(x

Var[ X ] X2 E X- X

2

xi X

i

X

) 2 P( X xi ) 0.24

A continuación se detallan algunas expresiones relativas a la probabilidad de sucesos:

Probabilidad condicionada: P(A|B) = P(A∩B)/P(B)

Probabilidad conjunta:

P(A∩B) = P(A|B)P(B) = P(B|A)P(A)

Probabilidad de la unión:

P(AB) = P(A) + P(B) – P(A∩B)

Probabilidad Total:

Teorema de Bayes:

Independencia:

Comunicaciones

N

N

i

i 1

P(B) P(B | A i )P(A i ) donde Ai , A i A j

P(B | A)P(A)

P(B)

P(A∩B) = P(A)P(B) P(A|B) = P(A) P(B|A) = P(B)

P(A | B)

Conceptos Básicos Previos

4

El siguiente esquema representa las probabilidades a priori y las verosimilitudes del

ejemplo del canal binario simétrico:

P(Y=0| X=0)=0.8

P(X=0)=0.6

P(Y=0)=¿?

P(Y=0| X=1)=0.2

P(Y=1| X=0)=0.2

P(X=1)=0.4

P(Y=1)=¿?

P(Y=1| X=1)=0.8

Ejercicio 3) En el ejemplo del canal binario simétrico y haciendo uso de las

expresiones de probabilidad anteriores, calcule:

a) La probabilidad de recibir un bit 0 y la probabilidad de recibir un bit 1.

Solución: 0.56 y 0.44

b) La probabilidad de que lo enviado haya sido “0” cuando se ha recibido “0”.

Solución : 0.857

c) La probabilidad de error del enlace.

Solución: P(error) = P(Y=0|X=1)P(X=1)+P(Y=1|X=0)P(X=0) = 0.2

Otro tipo de variable aleatoria son las v.a.’s continuas, cuyo rango está formado por un

intervalo (o intervalos) de valores. Las variables aleatorias continuas quedan totalmente

caracterizadas bien por la función de distribución de probabilidad,

x

FX ( x) P( X x) f X ( x)dx , o bien por la función densidad de probabilidad,

f X ( x ) dF X ( x ) / dx .

Algunos ejemplos son

f X ( x ) cte

v.a. uniforme:

f X ( x)

v.a. Gaussiana:

o

1

en x ,

2

1

2

2

X

e

x X 2

2 X2

Función de distribución complementaria: Q( x)

1

2

e

u2

2

du

x

Los estadísticos más importantes son:

Media: E[ X ] X

xf

X

( x)dx

Varianza: Var[ X ]

2

X

E X - x

2

X

X

2 f X ( x)dx EX 2 X 2

Es importante recordar que la independencia de dos v.a.’s se produce si y solo si

f XY ( x, y ) f X ( x ) f Y ( y ) f X ( x | y ) f X ( x ) f Y ( y | x ) f Y ( y )

Comunicaciones

Conceptos Básicos Previos

5

3.2 Procesos Estocásticos

Fuente de

información

binaria

0110010 Codificador

1→ +A

0→ -A

bits

h(t)

Filtro

t

x(t)

1

0

T

símbolos

t

t

señal

Una vez realizado el experimento aleatorio (consistente en generar una secuencia

binaria, convertir los bits en símbolos +A y –A y darles forma rectangular) se obtiene

una señal x(t) determinista (una realización). El conjunto de todas las señales x(t) de

este ejemplo forman el proceso estocástico X(t). En un instante concreto t0, X(t0) es una

v.a.. Se puede decir que un proceso estocástico es una v.a. que cambia con el tiempo.

Estadísticos de un proceso estocástico (en general dependen del tiempo):

E[ X (t )] X (t )

Media:

xf

X

( x; t )dx

R X t1 , t 2 E X (t1 ) X (t 2 )

Autocorrelación:

x x

1 2

f X ( x1 , x2 ; t1 , t 2 )dx

Pot X (t ) E X 2 (t ) RX t , t

Potencia:

Un p.e. se dice que es estacionario en sentido amplio si y sólo si X (t ) cte y

R X t1 , t 2 R X t 2 t1 R X . Para este tipo de procesos estocásticos, se define la

Densidad Espectral de Potencia como la transformada de Fourier de la autocorrelación:

S X f TF R X ( )

La siguiente figura muestra los estadísticos de la salida de un filtro cuya entrada es un

proceso estocástico estacionario en sentido amplio:

X(t)

L.T.I.

h(t)

Y(t)

Y (t ) X (t ) H (0)

RY ( ) R X ( ) h( ) h( ) R X ( ) Rhh ( )

SY ( f ) S X ( f ) H ( f )

2

Un proceso estocástico, N(t), se dice que es ruido blanco gaussiano (AWGN) si:

N

N

TF

a)

Es blanco: S N ( f ) 0 Watt/Hz

RN ( ) 0 ( )

2

2

n2

1

2

2

b)

Su fdp es Gaussiana3: f N ( n)

e

2

3

El AWGN posee potencia infinita, por lo que, estrictamente hablando, posee una fdp degenerada (σ=);

si bien es cierto que, si se filtra un proceso AWGN, el proceso resultante siempre es gaussiano (y con

potencia finita)

Comunicaciones

Conceptos Básicos Previos

6

Ejercicio 4) Considere AWGN con densidad espectral de potencia N0/2 Watt/Hz a la

entrada de un filtro paso bajo ideal de ancho de banda W Hz. Calcule los siguientes

estadísticos del proceso estocástico de salida:

N

f

a) La densidad espectral de potencia. (solución: 0

)

2 2W

b) La autocorrelación. (solución: N 0Wsinc (2W ) )

c) La potencia media. (solución: N0W)

4 Unidades Logarítmicas

Decibelio (dB) es una medida relativa de potencias:

V

P

R

10 log10 1 20 log10 1rms 10 log10 2

P2

R1

V2 rms

Relación Señal-Ruido (Signal to Noise Ratio):

P

SNR 10 log10 señal

Pruido

Unidades de Potencia:

dBW: decibelios respecto a 1Watt

Pot (dBW) = 10log10(Pot(Watt))

dBm: decibelios respecto a 1mWatt

Pot (dBm) = 10log10(Pot(mWatt)) =30 + Pot(dBW)

Comunicaciones

Conceptos Básicos Previos

7