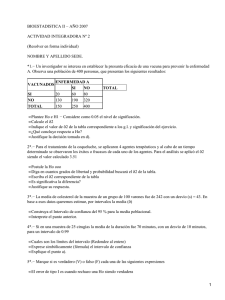

METODOS_LEONARDO

Anuncio

LOMATEMATICAS lV (METODOS NUMERICOS)

2011

METODO RAPSHON Vs METODO DE BISECCION

Johan Leonardo Laverde Pulido

Ingeniería industrial

leonardo_l07@hotmail.com

abstract: The following work is an example of how you can obtain the breakpoint in a plot by two methods,

and our intention is to have the certainty which of the two methods is better, more reliable and faster.

II.

I.

DESARROLLO DE CONTENIDOS

INTRODUCCION:

A. METODO DE BISECCION:

El siguiente trabajo es para presentar dos métodos

y definir el mejor método, el mas rápido, seguro,

confiable y rápido.

En análisis numérico, el método de Newton

(conocido también como el método de NewtonRaphson o el método de Newton-Fourier) es un

algoritmo eficiente para encontrar aproximaciones

de los ceros o raíces de una función real. También

puede ser usado para encontrar el máximo o

mínimo de una función, encontrando los ceros de

su primera derivada.

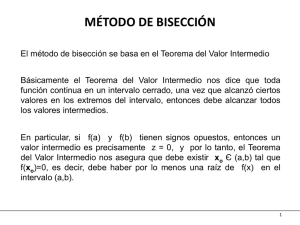

En matemáticas, el método de bisección es un

algoritmo de búsqueda de raíces que trabaja

dividiendo el intervalo a la mitad y seleccionando

el subintervalo que tiene la raíz.

Unas cuantas iteraciones del método de

bisección aplicadas en un intervalo

[a1;b1]. El punto rojo es la raíz de la

función.

En matemáticas, el método de bisección

es un algoritmo de búsqueda de raíces

que trabaja dividiendo el intervalo a la

mitad y seleccionando el subintervalo

que tiene la raíz.

Este es uno de los métodos más sencillos

y de fácil intuición para resolver

ecuaciones en una variable. Se basa en el

teorema del valor intermedio (TVI), el

cual establece que toda función continua

f en un intervalo cerrado [a,b] toma todos

los valores que se hallan entre f(a) y f(b).

Esto es que todo valor entre f(a) y f(b) es

la imagen de al menos un valor en el

intervalo [a,b]. En caso de que f(a) y f(b)

tengan signos opuestos, el valor cero

sería un valor intermedio entre f(a) y f(b),

por lo que con certeza existe un p en [a,b]

que cumple f(p)=0. De esta forma, se

asegura la existencia de al menos una

solución de la ecuación f(a)=0.

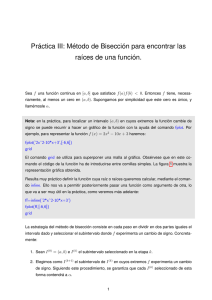

El método consiste en lo siguiente:

Debe existir seguridad sobre la continuidad de la

función f(x) en el intervalo [a,b]

A continuación se verifica que

Se calcula el punto medio m del intervalo [a,b] y

se evalúa f(m) si ese valor es igual a cero, ya

hemos encontrado la raíz buscada

GRAFICA EN MatLab:

function x = biseccion(fun,a,b,tol)

En caso de que no lo sea, verificamos si f(m) tiene

signo opuesto con f(a) o con f(b)

% Aproxima por el método de la bisección una

raíz de la ecuación fun(x)=0

Se redefine el intervalo [a, b] como [a, m] ó [m, b]

según se haya determinado en cuál de estos

intervalos ocurre un cambio de signo

disp('Método de la bisección');

Con este nuevo intervalo se continúa

sucesivamente encerrando la solución en un

intervalo cada vez más pequeño, hasta alcanzar la

precisión deseada

v=feval(fun,b);

En la siguiente figura se ilustra el procedimiento

descrito.

El método de bisección es menos eficiente que el

método de Newton, pero es mucho más seguro

para garantizar la convergencia. Si f es una

función continua en el intervalo [a, b] y f(a)f(b) <

0, entonces este método converge a la raíz de f. De

hecho, una cota del error absoluto es:

u=feval(fun,a);

n=1;

if sign(u)==sign(v)

disp('Error la función debe cambiar de signo en

(a,b)');

end

while ((b-a)*0.5==tol)

c=(b+a)/2; w=feval(fun,c);

disp(['n=', num2str(n)]);

en la n-ésima iteración. La bisección converge

linealmente, por lo cual es un poco lento. Sin

embargo, se garantiza la convergencia si f(a) y

f(b) tienen distinto signo.

Si existieran más de una raíz en el intervalo

entonces el método sigue siendo convergente pero

no resulta tan fácil caracterizar hacia qué raíz

converge el método.

disp(['c=', num2str(c)]);

disp(['f(c)=', num2str(w)]);

if sign(u)==sign(w)

a = c; u=w;

else

b=c; v=w;

end

n=n+1;

end;

x=c;

B. METODO DE NEWTON RAPHSON:

Donde f ' denota la derivada de f.

Nótese que el método descrito es de

El método de Newton-Raphson es un

método abierto, en el sentido de que su

convergencia global no está garantizada.

La única manera de alcanzar la

convergencia es seleccionar un valor

inicial lo suficientemente cercano a la

raíz buscada. Así, se ha de comenzar la

iteración con un valor razonablemente

aplicación exclusiva para funciones de una

sola variable con forma analítica o implícita

cognoscible. Existen variantes del método

aplicables a sistemas discretos que permiten

estimar las raíces de la tendencia, así como

algoritmos que extienden el método de

Newton a sistemas multivariables, sistemas

de ecuaciones, etc.

cercano al cero (denominado punto de

arranque o valor supuesto). La relativa

cercanía del punto inicial a la raíz

Estimación del Error

depende mucho de la naturaleza de la

propia función; si ésta presenta múltiples

puntos de inflexión o pendientes grandes

en el entorno de la raíz, entonces las

Se puede demostrar que el método de

Newton-Raphson tiene convergencia

cuadrática: si α es raíz, entonces:

probabilidades de que el algoritmo

diverja aumentan, lo cual exige

seleccionar un valor supuesto cercano a

la raíz. Una vez se ha hecho esto, el

método linealiza la función por la

recta tangente en ese valor supuesto. La

abscisa en el origen de dicha recta será,

según el método, una mejor

para una cierta constante C. Esto significa

que si en algún momento el error es menor o

igual a 0,1, a cada nueva iteración doblamos

(aproximadamente) el número de decimales

exactos. En la práctica puede servir para

hacer una estimación aproximada del error:

Error relativo entre dos aproximaciones

sucesivas:

aproximación de la raíz que el valor

anterior. Se realizarán sucesivas

iteraciones hasta que el método haya

convergido lo suficiente.

Sea f : [a, b] -> R función derivable

definida en el intervalo real [a, b].

Empezamos con un valor inicial x0 y

definimos para cada número naturaln

Con lo cual se toma el error relativo como si

la última aproximación fuera el valor exacto.

Se detiene el proceso iterativo cuando este

error relativo es aproximadamente menor

que una cantidad fijada previamente.

CODIGO EN MATLAB:

Programa escrito en Matlab para hallar las raíces

usando el método de NEWTON-RAPHSON

disp ('NEWTON-RAPHSON')

xo=input('Valor inicial =');

n=input ('numero de iteraciones=');

salida=ones(n,4); % matiz de salida de datos

for i=1:n

x1=xo-[(exp(-xo)-xo)]/[(-exp(-xo)-1)];

Ejemplo

vsal=[xo;x1];

er=[[abs((xo-x1)/xo)]]*100; % error relativo

porcentual

ea=[[abs((x1-xo)/x1)]]*100; % error

xo=x1;

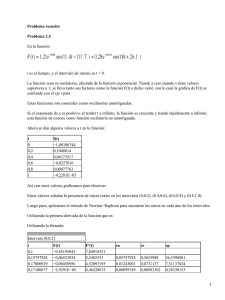

Consideremos el problema de encontrar un

número positivo x tal que cos(x) = x3. Podríamos

tratar de encontrar el cero de f(x) = cos(x) - x3.

Sabemos que f '(x) = -sin(x) - 3x2. Ya que cos(x)

≤ 1 para todo x y x3 > 1 para x>1, deducimos que

nuestro cero está entre 0 y 1. Comenzaremos

probando con el valor inicial x0 = 0,5

salida(i,1)=i;

salida(i,2)=x1;

salida(i,3)=er;

salida(i,4)=ea;

end

disp('iteraizerea');

disp(num2str(salida));

Los dígitos correctos están subrayados. En

particular, x6 es correcto para el número de

decimales pedidos. Podemos ver que el número de

dígitos correctos después de la coma se

incrementa desde 2 (para x3) a 5 y 10, ilustando la

convergencia cuadrática.

III.

CONCLUSIONES:

En conclusión la mejor, mas rápido y

confiable de los métodos mencionados

anteriormente es el método de newton

raphson .

Donde f ' denota la derivada de f.

El método de Newton-Raphson es un

aplicación exclusiva para funciones de una

método abierto, en el sentido de que su

sola variable con forma analítica o implícita

convergencia global no está garantizada.

cognoscible. Existen variantes del método

La única manera de alcanzar la

aplicables a sistemas discretos que permiten

convergencia es seleccionar un valor

estimar las raíces de la tendencia, así como

inicial lo suficientemente cercano a la

algoritmos que extienden el método de

raíz buscada. Así, se ha de comenzar la

Newton a sistemas multivariables, sistemas

iteración con un valor razonablemente

de ecuaciones, etc.

cercano al cero (denominado punto de

arranque o valor supuesto). La relativa

cercanía del punto inicial a la raíz

depende mucho de la naturaleza de la

propia función; si ésta presenta múltiples

puntos de inflexión o pendientes grandes

en el entorno de la raíz, entonces las

probabilidades de que el algoritmo

diverja aumentan, lo cual exige

seleccionar un valor supuesto cercano a

la raíz. Una vez se ha hecho esto, el

método linealiza la función por la

recta tangente en ese valor supuesto. La

abscisa en el origen de dicha recta será,

según el método, una mejor

aproximación de la raíz que el valor

anterior. Se realizarán sucesivas

iteraciones hasta que el método haya

convergido lo suficiente.

Sea f : [a, b] -> R función derivable

definida en el intervalo real [a, b].

Empezamos con un valor inicial x0 y

definimos para cada número naturaln

Nótese que el método descrito es de