00 introduccion - Generando Conocimiento

Anuncio

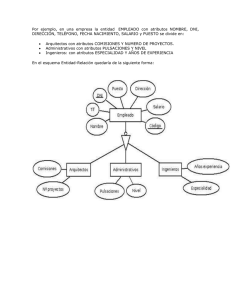

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

0. INTRODUCCIÓN

Se presenta de forma concisa y práctica la herramienta de minería de datos WEKA.

Estos apuntes son una recolección de información de muy variadas fuentes, páginas de Internet,

artículos etc., todas ellas aparecen citadas en las referencias. Esperamos que estos sean de utilidad

para los alumnos que se acerquen al análisis de datos y en particular para aquellos que tengan

interés en aplicar los conocimientos teóricos en el campo de la práctica.

Ésta, es una

herramienta de

aprendizaje

automático y data

mining, escrita en

lenguaje Java,

gratuita y

desarrollada en la

Universidad de

Waikato.

WEKA1 se

distribuye como

software de libre

distribución.

La primera sección tiene un enfoque teórico - práctico, pretendiendo servir de guía de utilización

de esta herramienta para ello se obviarán los detalles técnicos y específicos de los diferentes

algoritmos, que se presentan en una sección aparte, y se centrará en su aplicación, configuración y

análisis dentro de la herramienta. Por tanto, se remite al lector a la sección 2 con los detalles de las

técnicas y los algoritmos para conocer sus características, parámetros de configuración,

comparaciones, etc. Para reforzar el carácter práctico de la primera sección, además se adoptará un

formato de tipo tutorial, con un conjunto de datos disponibles sobre el que se irán aplicando las

diferentes facilidades de WEKA. Se han seleccionado algunas de las técnicas disponibles para

aplicarlas a ejemplos concretos, siguiendo el acceso desde la herramienta al resto de técnicas

implementadas, presentada a modo ilustrativo.

En un anexo electrónico (en disco) se adjuntará material oficial bajado de la página de Weka y

algunos artículos de interés, además de los “dataset” o ficheros de datos que se utilizaran tanto en

los ejemplos como en los ejercicios.

1

El programa WEKA se puede descargar desde: http://www.cs.waikato.ac.nz/ml/weka

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

A continuación se citan las principales referencias bibliográficas consultadas para armar estos

apuntes.

0.1. REFERENCIAS

DIEGO GARCÍA MORATE, Manual de Weka, (diego.garcia.morate(at)gmail.com)

JOSÉ ANTONIO GÁMEZ MARTÍN, apunte de cátedra Minería de Datos, Sistemas Informáticos Ingeniería Informática, Curso 2006/2007, Universidad de Castilla-La Mancha , Escuela Politécnica

Superior de Albacete (http://www.pol-ab.uclm.es/ )

JOSÉ MANUEL MOLINA LÓPEZ y JESÚS GARCÍA HERRERO, Técnicas de Análisis de Datos,

Aplicaciones Prácticas Utilizando Microsoft Excel y Weka, apuntes de la cátedra Técnicas de IA para

el Análisis de Datos, Actividad Docente, Grupo de Docencia Inteligencia Artificial, Informática Teórica

y Compiladores, (http://scalab.uc3m.es/~docweb/index.html)

JOSÉ HERNÁNDEZ ORALLO y CÈSAR FERRI RAMÍREZ, Práctica de minería de datos:

introducción a Weka , apuntes del Curso de Doctorado Extracción Automática de Conocimiento en

Bases de Datos e Ingeniería del Software, Universitat Politècnica de València, Marzo 2006

(jorallo@dsic.upv.es y cferri@dsic.upv.es).

LÓPEZ DE ULLIBARRI GALPARSORO I, PITA FERNÁNDEZ, S., Medidas de concordancia: el

índice de Kappa, Unidad de Epidemiología Clínica y Bioestadística. Complexo HospitalarioUniversitario Juan Canalejo., A Coruña (España) Cad Aten Primaria 1999; 6: 169-171.

M.ASUNCIÓN VICENTE, Inteligencia Artificial y Reconocimiento de Patrones, Departamento:

Ingeniería de Sistemas Industriales, Curso 5º, 2006-2007, (http://isa.umh.es/asignaturas/iarp/)

MIGUEL GARRE, JUÁN JOSÉ CUADRADO y MIGUEL ÁNGEL SICILIA, Comparación de

diferentes algoritmos de clustering en la estimación de coste en el desarrollo de software, Dept. de

Ciencias de la Computación - ETS Ingeniería Informática, Universidad de Alcalá, Ctra. Barcelona km

33.6 – 28871, Alcalá de Henares, Madrid.

WEKA. University of Waikato (http://www.cs.waikato.ac.nz/ml/weka)

WekaDOC, artículos sobre Weka,( http://weka.sourceforge.net/wekadoc/)

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

MANUAL DE WEKA

Se han seleccionado algunas de las técnicas disponibles para aplicarlas a ejemplos concretos,

siguiendo el acceso desde la herramienta al resto de técnicas implementadas, a continuación se

enunciará el ejemplo que se resolverá durante toda esta sección. Se sugiere que el lector aplique los

pasos indicados y realice los análisis sugeridos para cada técnica con objeto de familiarizarse y

mejorar su comprensión. Éste análisis tiene un enfoque introductorio e ilustrativo para acercarse a

las técnicas disponibles y su manipulación desde la herramienta, dejando abierto para el

investigador llevar el estudio de este dominio a resultados y conclusiones más elaboradas

Los principales 1ejemplos seleccionados contienen datos provenientes del campo de la enseñanza,

correspondientes a 2alumnos que realizaron las pruebas de selectividad en los años 1993-2003

procedentes de diferentes centros de enseñanza secundaria de la comunidad de Madrid. Por tanto,

en estos ejemplos se ilustra la aplicación y análisis de técnicas de extracción de conocimiento sobre

datos del campo de la enseñanza, aunque sería directa su traslación a cualquier otra disciplina

Datos de ejemplo (selectividad.arff):

El fichero de datos objeto de análisis en esta guía contiene muestras correspondientes a 18802 alumnos

presentados a las pruebas de selectividad y los resultados obtenidos en las pruebas. Los datos que describen

cada alumno contienen la siguiente información: año, convocatoria, localidad del centro, opción cursada (de

5 posibles), calificaciones parciales obtenidas en lengua, historia, idioma y las tres asignaturas opcionales,

así como la designación de las asignaturas de idioma y las 3 opcionales cursadas, calificación en el

bachillerato, calificación final y si el alumno se presentó o no a la prueba.

Los datos de entrada a la herramienta, sobre los que operarán las técnicas implementadas, deben estar

codificados en un formato específico, denominado Attribute-Relation File Format. Los datos deben estar

dispuestos en el fichero de la forma siguiente: cada instancia en una fila, y con los atributos separados por

comas. Por tanto, puede comprobarse que la cabecera del fichero de datos, "selectividad.arff", sigue el

formato mencionado anteriormente:

@relation selectividad

@attribute Año_académico real

@attribute convocatoria {J, S}

@attribute localidad {ALPEDRETE, ARANJUEZ, ... }

@attribute opcion1ª {1,2,3,4,5}

@attribute nota_Lengua real

@attribute nota_Historia real

@attribute nota_Idioma real

@attribute des_Idioma {INGLES, FRANCES, ALEMAN}

@attribute des_asig1 {BIOLOGIA, DIB.ARTISTICO_II,... }

@attribute calif_asig1 real

@attribute des_asig2 {BIOLOGIA, C.TIERRA, ...}

@attribute calif_asig2 real

@attribute des_asig3 {BIOLOGIA, C.TIERRA, ...}

@attribute calif_asig3 real

@attribute cal_prueba real

@attribute nota_bachi real

@attribute cal_final real

@attribute Presentado {SI, NO}

@data ...

1

2

Analizados con la interfaz Explorer (ver sección 1.4)

ACTIVIDAD DOCENTE, Grupo de Docencia Inteligencia Artificial, Informática Teórica y Compiladores,

Técnicas de IA para el Análisis de Datos - http://scalab.uc3m.es/~docweb/index.html

-1-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Objetivos del análisis

En nuestro caso, uno de los objetivos perseguidos podría ser el intentar relacionar los resultados obtenidos en

las pruebas con características o perfiles de los alumnos, si bien la descripción disponible no es muy rica y

habrá que atenerse a lo que está disponible. Algunas de las preguntas que podemos plantearnos a responder

como objetivos del análisis podrían ser las siguientes:

¿Qué características comunes tienen los alumnos que superan la prueba? ¿y los alumnos mejor

preparados que la superan sin perjudicar su expediente?

¿existen grupos de alumnos, no conocidos de antemano, con características similares?

¿hay diferencias significativas en los resultados obtenidos según las opciones, localidades, años, etc.?,

¿la opción seleccionada y el resultado está influida depende del entorno?

Como veremos, muchas veces el resultado alcanzado puede ser encontrar relaciones triviales o

conocidas previamente, o puede ocurrir que el hecho de no encontrar relaciones significativas, lo

puede ser muy relevante. Por ejemplo, saber después de un análisis exhaustivo que la opción o localidad

no condiciona significativamente la calificación, o que la prueba es homogénea a lo largo de los años, puede

ser una conclusión valiosa, y en este caso "tranquilizadora".

1. ENTORNO WEKA

Esta ave da nombre a una extensa colección de algoritmos de Máquinas de conocimiento desarrollados por la universidad de Waikato (Nueva Zelanda) implementados en Java; útiles para ser

aplicados sobre datos mediante los interfaces que ofrece o para embeberlos dentro de cualquier

aplicación. Weka contiene las herramientas necesarias para realizar transformaciones sobre los

datos, tareas de clasificación, regresión, clustering, asociación y visualización. Diseñado como una

herramienta orientada a la extensibilidad por lo que añadir nuevas funcionalidades es una tarea

sencilla.

Sin embargo, y pese a todas las cualidades que Weka posee, tiene un gran defecto y éste es la

escasa documentación orientada al usuario que tiene, junto a una usabilidad bastante pobre, lo

que la hace una herramienta díficil de comprender y manejar sin información adicional3.

3

WekaDOC, artículos sobre Weka, http://weka.sourceforge.net/wekadoc/

-2-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

La licencia de Weka es GPL4, lo que significa que este programa es de libre distribución y difusión. Además, ya que Weka está programado en Java, es independiente de la arquitectura, ya que

funciona en cualquier plataforma sobre la que haya una máquina virtual Java disponible.

Esta sección tiene por objetivo explicar el funcionamiento básico de este programa y sentar unas

bases para que el lector pueda ser autodidacta.

1.1. INSTALACIÓN Y EJECUCIÓN

WEKA se distribuye como un fichero ejecutable comprimido de java (fichero "jar"), que se invoca

directamente sobre la 5máquina virtual JVM.

Una vez descomprimido Weka y teniendo apropiadamente instalada la máquina de virtual Java,

para ejecutar Weka simplemente debemos ordenar dentro del directorio de la aplicación el mandato:

java -jar weka.jar

La herramienta se invoca desde el

intérprete de Java, en el caso de utilizar

un entorno windows, bastaría una

ventana de comandos para invocar al

intéprete Java:

No obstante, si estamos utilizando la máquina virtual de Java de Sun (que habitualmente es la más

corriente), este modo de ejecución no es el más apropiado, ya que, por defecto, asigna sólo 100

megas de memoria de acceso aleatorio para la máquina virtual, que muchas veces será insuficiente

para realizar ciertas operaciones con Weka (y obtendremos el consecuente error de insuficiencia de

memoria); por ello, es altamente recomendable ordenarlo con el mandato:

java -Xms<memoria-mínima-asignada>M

-Xmx<memoria-máxima-asignada>M -jar weka.jar

Dónde el parámetro -Xms indica la memoria RAM mínima asignada para la máquina virtual y Xmx la máxima memoria a utilizar, ambos elementos expresados en Megabytes si van

acompañados al final del modificador “M”. Una buena estrategia es asignar la mínima memoria a

utilizar alrededor de un 60% de la memoria disponible.

Para obtener la lista de opciones estándar, si usamos la máquina virtual de Sun, ordenamos el

mandato java -h, y para ver la lista de opciones adicionales java -x.

Una vez que Weka esté en ejecución aparecerá una ventana denominada selector de interfaces

(figura 1.1), que nos permite seleccionar la interfaz con la que deseemos comenzar a trabajar con

Weka. Nos ofrece cuatro opciones posibles de trabajo:

4

5

GNU Public License. http://www.gnu.org/copyleft/gpl.html

En las primeras versiones de WEKA se requería la máquina virtural Java 1.2 para invocar a la interfaz

gráfica, desarrollada con el paquete gráfico de Java Swing. A partir de la versión, Weka 3-4, se requiere

Java 1.3 o superior. La misma se puede bajar desde la Web: http://www.sun.com

-3-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Figura 1.1. Ventana de Selección

Las posibles interfaces a seleccionar son Sim ple Cli, Explorer, Experimenter y Knowledge flow que

se explica en la Figura 1.1, se explicarán detenidamente y de forma individual en secciones

siguientes.

1.2. FICHEROS .arff

Nativamente Weka trabaja con un formato denominado ARFF, acrónimo de Attribute-Relation File

Format. Es un 6archive de texto ASCII que describe una lista de instancias que comparten un

conjunto de atributos.

Un fichero con este formato, no sólo contiene los datos desde donde vamos a efectuar el

aprendizaje, además incluye meta-información sobre los propios datos, como por ejemplo el

nombre y tipo de cada atributo, así como una descripción textual del origen de los datos. Podemos

convertir ficheros en texto conteniendo un registro por línea y con los atributos separados con

comas (formato csv) a ficheror arff mediante el uso de un filtro convertidor.

6

Estos ficheros fueron desarrollados por el proyecto de aprendizaje de maquinas del departamento de

Ciencias de computación de la Universidad de Waikato para el uso con el software: Weka machine learning

software. (Mas información puede ser obtenida en http://www.cs.waikato.ac.nz/~ml/).

-4-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Estos ficheros tienen dos secciones distintas. La primera sección es la información de encabezado, a

la que le sucede la información de DATA o datos. El encabezado de los archivos ARFF contiene los

nombres de las relaciones, una lista de atributos (las columnas en los datos) y sus tipos.

1. Cabecera. Se define el nombre de la relación. Su formato es el siguiente:

@relation <nombre-de-la-relación>

Donde <nombre-de-la-relación> es de tipo String7. Si dicho nombre contiene algún espacio

será necesario expresarlo entrecomillado.

2. Declaraciones de atributos. En esta sección se declaran los atributos que compondrán

nuestro archivo junto a su tipo. La declaración de atributos toma la forma de una secuencia

ordenada. Cada atributo tiene su @attribute el cual define el nombre del atributo y el tipo de

dato. El orden que son declarados los atributos indican la columna en que se encuentras los

datos de dicho atributo en el @data. La sintaxis es la siguiente:

@attribute <nombre-del-atributo> <tipo> .

Donde <nombre-del-atributo> es de tipo String, debe comenzar con un carácter alfabético. El

nombre deberá llevar comillas si incluye espacios. El <tipo-dato> puede ser de cuatro tipos

para correr en WEKA: numérico, <nominal-specification>, string y date [<date-format>].

•

Atributos Numéricos. Pueden ser números real o integer (reales o enteros)

NUMERIC Expresa números reales8.

•

INTEGER Expresa números enteros.

Date (fecha) attributes. Los atributos de Fecha se declaran de la siguiente forma:

@attribute <nombre> date [<date-format>]

Donde <nombre> es el nombre del atributo y <date-format> es un string opcional que

especifica como se podrán imprimir los valores de fecha (son los mismos formatos simples

de fecha).

DATE Expresa fechas, para ello este tipo debe ir precedido de una etiqueta de formato entrecomillada. La etiqueta de formato está compuesta por caracteres separadores (guiones

y/o espacios) y unidades de tiempo, el formato por descarte es el combinado hora y fecha

de ISO-8601: "yyyy-MM-dd'T'HH:mm:ss":

dd Día. MM Mes. yyyy Año. HH Horas. mm Minutos. ss Segundos.

•

Atributos String. Sirven para crear atributos que tiene valores arbitrarios de texto, los

cuales son de mucho uso en aplicaciones de minería, (Weka Filters to manipulate strings

(like StringToWordVectorFilter)). Los atributos string se declaran de la siguiente forma:

@ATTRIBUTE LCC

string

STRING Expresa cadenas de texto, con las restricciones del tipo String comentadas

anteriormente.

•

Atributos Nominales. Los valores Nominales son definidos por medio de las listas de

posibles valores del <nominal-specification> de la siguiente forma:

{<nombre-nominal1>, <nominal nombre-nominal2>, < nombre-nominal3>, ...}

7

8

Entendiendo como tipo String el ofrecido por Java

Debido a que Weka es un programa Anglosajón la separación de la parte decimal y entera de los números

reales se realiza mediante un punto en vez de una coma.

-5-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

ENUMERADO El identificador de este tipo consiste en expresar entre llaves y separados

por comas los posibles valores (caracteres o cadenas de caracteres) que puede tomar el

atributo. Por ejemplo, si tenemos un atributo que indica el tiempo podría definirse:

@attribute tiempo {soleado,lluvioso,nublado}

3. Sección de datos. La declaración de @data es una línea simple que denota el comienzo del

segmento de datos del archivo. El formato es:

@data

Declaramos los datos que componen la relación separando entre comas los atributos y con

saltos de línea las relaciones. Cada instancia esta representada en una sola línea, que tiene

como final un fin de instancia. Los valores de cada instancia están delimitados por comas.

Deben aparecer en el orden que fueron declarados en la sección de cabecera.

@data 4,3.2

Aunque éste es el modo “completo" es posible definir los datos de una forma abreviada

(sparse data), formato que se explica más adelante.

En el caso de que algún dato sea desconocido se expresará con un símbolo de cerrar

interrogación (“?").

Como se ve a continuación:

@data

4.4,?,1.5,?,Iris-setosa

Es posible añadir comentarios con el símbolo “ %”, que indicará que desde ese símbolo hasta el

final de la línea es todo un comentario. Los comentarios pueden situarse en cualquier lugar del

fichero.

Ejemplo 1: Los valores nominales y de string son sensible a casos, por lo que si contienen cualquier

espacio deberán ir entre comillas como se ve:

@relation LCCvsLCSH

@attribute LCC string

@attribute LCSH string

@data

AG5,

'Encyclopedias and dictionaries.; Twentieth century.'

AS262, 'Science -- Soviet Union -- History.'

AE5,

'Encyclopedias and dictionaries.'

AS281, 'Astronomy, Assyro-Babylonian.;Moon -- Phases.'

AS281, 'Astronomy, Assyro-Babylonian.;Moon -- Tables.'

Ejemplo 2: Las fechas deberás ser especificadas en la sección data usando la representación

especificada de string en la declaración de atributos, como se ve:

@RELATION Timestamps

@ATTRIBUTE timestamp DATE "yyyy-MM-dd HH:mm:ss"

@DATA

"2001-04-03 12:12:12"

"2001-05-03 12:59:55"

-6-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Archivos Sparse ARFF (desparramados)

Si tenemos una muestra en la que hay muchos datos que sean 0 podemos expresar los datos

prescindiendo de los elementos que son nulos, rodeando cada una de las filas entre llaves y situando

delante de cada uno de los datos el número de atributo9.

Los archivos Sparse ARFF son muy similares a los ARFF normales, pero con los datos con valor 0

no serán representados. Tienen el mismo encabezado (i.e. @relation y @attribute) pero la sección

data es distinta, como se ve en ejemplo:

En vez de representar cada valor en este orden:

@data

0, X, 0, Y, "class A"

0, 0, W, 0, "class B"

Los atributos distintos de cero son identificados explícitamente por un numero de atributo y su valor

de la siguiente manera:

@data

{1 X, 3 Y, 4 "class A"}

{2 W, 4 "class B"}

Cada instancia esta rodeada por < >, y el formato de entrada para cada entrada es: <index> <space>

<value> donde index es el atributo índice (partiendo de 0).

Hay que notar que los valores omitidos en instancias sparse son 0, no son valores que faltan!. Si un

valor es desconocido se deberá representar con un signo de interrogación (?).

Nota: Existe un problema al guardar objetos de instancias Sparce (SparseInstance objects) de los datasets

que tienen atributos string. En Weka, los valores de datos string son guardados como números; estos

números actúan como índices en un arreglo de posibles valores de atributos. Entonces el primer valor string

es asignado con índice 0 lo que quiere decir que el valor se guardara como 0. Cuando la instancia Sparce es

escrita, la instancia string con valor interno 0 no saldrá, por lo tanto el valor se perderá y cambiarán los

valores de atributos. Para solucionar el problema, hay que agregar un valor “dummy string” en el índice 0

que nunca será usado.

1.3. SIMPLE CLI

Simple CLI es una abreviación de Simple Client. Esta interfaz (figura 1.3) proporciona una consola

para poder introducir mandatos. A pesar de ser en apariencia muy simple es extremadamente

potente porque permite realizar cualquier operación soportada por Weka de forma directa; no

obstante, es muy complicada de manejar ya que es necesario un conocimiento completo de la

aplicación.

Su utilidad es pequeña desde que se fue recubriendo Weka con interfaces. Actualmente ya prácticamente sólo es útil como una herramienta de ayuda a la fase de pruebas.

9

La numeración de atributos comienza desde el 0, por lo que primero es el 0 y no el 1

-7-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Figura 1.3: Interfaz de modo consola

Los mandatos soportados son los siguientes:

java <nombre-de-la-clase><args>

Ejecuta el método “main” de la clase dada con los argumentos especificados al ejecutar este

mandato (en el caso de que realmente se haya proporcionado alguno). Cada mandato es atendido en

un hilo independiente por lo que es posible ejecutar varias tareas concurrentemente.

Detiene la tarea actual.

“Mata” la tarea actual. Este comando es desaconsejable, sólo debe usarse

Hill

en el caso de que la tarea no pueda ser detenida con el mandato break.

cls (Clear Screen).

Limpia el contenido de la consola.

Exit

Sale de la aplicación.

help <mandato>

Proporciona una breve descripción de cada mandato.

Break

1.3.1 Utilización de WEKA desde la línea de comandos.

En ocasiones es más práctico utilizar los algoritmos de WEKA desde la línea de comandos. Por

ejemplo, si se quiere lanzar muchas veces un clasificador para obtener estadísticas de resultados, se

puede automatizar el proceso mediante un bucle.

Lanzamiento de un comando Weka desde MS-DOS

Como ejemplo, se generará desde MS-DOS un árbol de decisión a partir de un fichero de datos de

entrenamiento propio de WEKA. Para ello, en primer lugar abriremos una ventana de comandos de

MS-DOS. Dentro de esa ventana, nos situaremos en el directorio donde se encuentra instalado

WEKA. 10En la mayor parte de los ordenadores, este directorio será “…\data\”:

java weka.classifiers.trees.J48 –t data\weather.arff –C 0.30

Los comandos se ingresan de la misma manera si ingresamos a la interfaz Simple CLI, la carpeta por

defecto en la que trabaja es la de “…\data\...”.

10

-8-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Veamos en detalle la instrucción tecleada:

(lanza el intérprete java)

(elige un clasificador de entre todos los disponibles, en

weka.classifiers.trees.J48

este caso el generador de árboles de decisión J48)

–t data\weather.arff

(indica cuál es el fichero de datos de entrenamiento a utilizar).

(fija un parámetro del clasificador. En este caso es el umbral de confianza para

–C 0.30

la poda de los árboles).

Java

El resultado que aparecerá en pantalla será el siguiente:

Options: -C 0.30

J48 pruned tree

-----------------outlook = sunny

| humidity <= 75: yes (2.0)

| humidity > 75: no (3.0)

outlook = overcast: yes (4.0)

outlook = rainy

| windy = TRUE: no (2.0)

| windy = FALSE: yes (3.0)

Number of Leaves : 5

Size of the tree : 8

Time taken to build model: 0.02 seconds

Time taken to test model on training data: 0 seconds

=== Error on training data ===

Correctly Classified Instances 14 100 %

Incorrectly Classified Instances 0 0 %

Kappa statistic 1

Mean absolute error 0

Root mean squared error 0

Relative absolute error 0 %

Root relative squared error 0 %

Total Number of Instances 14

=== Confusion Matrix ===

a b <-- classified as

9 0 | a = yes

0 5 | b = no

=== Stratified cross-validation ===

Correctly Classified Instances 9 64.2857 %

Incorrectly Classified Instances 5 35.7143 %

Kappa statistic 0.186

Mean absolute error 0.2857

Root mean squared error 0.4818

Relative absolute error 60 %

Root relative squared error 97.6586 %

Total Number of Instances 14

=== Confusion Matrix ===

a b <-- classified as

7 2 | a = yes

3 2 | b = no

La forma de lanzar cualquier otro clasificador o cualquier otra función de WEKA es similar. Para

determinar el tipo de funciones disponibles, basta con comprobar los distintos directorios que

existen a partir de weka_java\weka\:

•

•

•

•

•

Associations: algoritmos para generar reglas a partir de datos.

AttributeSelection: selección de características.

Classifiers: clasificadores.

Clusterers: agrupación de datos.

Core: funciones núcleo de WEKA (no se usan directamente).

-9-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

•

•

•

•

•

Datagenerators: generación automática de datos (aleatorios).

Estimators: estimadores estadísticos.

Experiment: interfaz de usuario.

Filters: filtros de datos y de atributos.

Gui: interfaz de usuario.

Dentro de cada directorio existen múltiples subdirectorios, por lo tanto la cantidad de algoritmos

disponible en WEKA es muy elevada.

Lanzamiento de un Comando Weka desde Matlab

Es práctico lanzar los comandos de WEKA desde Matlab para poder incluir bucles y funciones de

lectura automática de resultados fácilmente.

Para lanzar WEKA desde Matlab se realiza una llamada al sistema (a MS-DOS) mediante el

comando !:

Desde la ventana de comandos de Matlab, nos situaremos en el directorio correcto mediante el

comando cd:

>> cd ‘c:\iarp\weka_java’

Una vez en el directorio correcto, teclearemos:

>> !java weka.classifiers.trees.J48 –t data\weather.arff –C 0.30

Y obtendremos el mismo resultado que el obtenido sobre la ventana de MS-DOS. Una ventaja

adicional de utilizar Matlab es que el comando se puede modificar a voluntad desde dentro del

programa, mediante la instrucción eval.

Por ejemplo, para generar un árbol de decisión con un umbral de confianza ajustable para la poda

podemos teclear las siguientes instrucciones de Matlab:

>> conf = 0.30;

>> orden = sprintf (‘!java weka.classifiers.trees.J48 –t data/weather.arff –C %f’,

conf);

>> eval(orden);

El resultado será similar al obtenido en el resto de pruebas Por último, será posible realizar un bucle para

distintos valores del parámetro del clasificador, de la forma siguiente:

>> cf = [0.05 0.10 0.15 0.20 0.25 0.30];

>> for i=1:6

>> orden = sprintf(‘!java weka.classifiers.trees.J48 –t data/weather.arff –C %f’,

cf(i));

>> eval(orden);

>> end;

Lectura automática de resultados de Weka

Comprobar los resultados de WEKA sobre la pantalla no es práctico cuando se realizan múltiples

experimentos dentro de un bucle. Desde Matlab es posible leer automáticamente los resultados,

siempre que éstos se hayan guardado anteriormente en un fichero.

Para guardar los resultados en un fichero, basta con utilizar el operador de redirección de MS-DOS

(símbolo >) que hace que los datos no se muestren en pantalla sino que se escriban en el fichero que

se indique.

-10-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Desde Matlab, bastaría con teclear un comando como el siguiente:

>> !java weka.classifiers.trees.J48 –t data\weather.arff > out.txt

La redirección hace que los resultados se guarden en el fichero ‘out.txt’ y que no aparezcan en

pantalla. Para comprobar que todo ha funcionado correctamente, se buscará el fichero anterior

desde el explorador de Windows y se abrirá con el programa Wordpad (el programa Notepad puede

mostrar incorrectamente los saltos de línea).

El último paso consiste en extraer automáticamente la información deseada del fichero de

resultados. Supongamos que los datos que nos interesan son los porcentajes de clasificaciones

correctas tanto sobre los datos de entrenamiento como en un experimento de validación cruzada.

Tales datos aparecen en el siguiente punto de los resultados:

1. Porcentaje de clasificaciones correctas sobre los datos de entrenamiento:

=== Error on training data ===

Correctly Classified Instances 14

100 %

2. Porcentaje de clasificaciones correctas en un experimento de validación cruzada:

=== Stratified cross-validation ===

Correctly Classified Instances 9 64.2857 %

Podemos escribir un programa Matlab que lea el fichero de resultados y busque precisamente esa

información. El programa es el siguiente:

% lee resultados de WEKA

function [porcent1, porcent2] = lee_weka (fichero)

% abre fichero de resultados

file = fopen(fichero, 'r');

% busca primer dato

cadena = busca_comienzo('=== Error on training data ===', file);

cadena = busca_comienzo('Correctly Classified Instances', file);

datos = sscanf(cadena(31:length(cadena)), '%f');

porcent1 = datos(2);

% busca segundo dato

cadena = busca_comienzo('=== Stratified cross-validation ===', file);

cadena = busca_comienzo('Correctly Classified Instances', file);

datos = sscanf(cadena(31:length(cadena)), '%f');

porcent2 = datos(2);

fclose(file);

return

% busca una cadena que comienza por unos ciertos caracteres

function cadena = busca_comienzo(comienzo, file);

carac = length(comienzo);

seguir=1;

while seguir==1

cadena = fgets(file);

if (length(cadena)>=carac)

if cadena(1:carac)==comienzo

seguir=0;

end

end

end

return

-11-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

La forma de utilizar el programa será la siguiente:

· En primer lugar, el programa se debe copiar en el directorio de la asignatura:

C:\iarp\weka_java

· En Segundo lugar, se lanzará el programa desde Matlab de la forma siguiente:

>> [porcent1, porcent2] = lee_weka('out.txt')

porcent1 = 100

porcent2 = 64.2857

Una vez que somos capaces de leer los resultados, es posible lanzar un clasificador con distintos

valores para sus parámetros en un bucle y almacenar todos los resultados. Se probará el siguiente

programa Matlab:

>> cf = [0.05 0.10 0.15 0.20 0.25 0.30];

>> for i=1:6

>> orden = sprintf

(‘!java weka.classifiers.trees.J48 –t data/weather.arff –C %f >

out.txt’, cf(i));

>> eval(orden);

>> [p1(i), p2(i)] = lee_weka(‘out.txt’);

>> end;

Una vez ejecutado el programa anterior, los resultados estarán disponibles en los vectores p1 y p2, y

podrán ser mostrados, por ejemplo, mediante un comando plot:

>> plot(p1,‘r*’);

>> plot(p2,‘go’);

1.4. EXPLORER

El modo Explorador es el modo más usado y más descriptivo11. Éste permite realizar operaciones

sobre un sólo archivo de datos. La ventana principal es la mostrada en la figura 1.4.

Es muy importante reseñar que Weka es un programa en continuo desarrollo y cada una de las 4

interfaces que posee evoluciona en separado por lo que actualmente no son equivalentes por completo, es

decir, hay ciertas funcionalidades sólo realizables por algunas de las interfaces y no por otras y viceversa

11

-12-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Figura 1.4: El modo explorador. Ventana inicial.

Como se puede observar existen 6 sub-entornos de ejecución. Una vez seleccionada la opción

Explorer, se crea una ventana con 6 pestañas en la parte superior que se corresponden con

diferentes tipos de operaciones, en etapas independientes, que se pueden realizar sobre los datos:

Además de estas pestañas de selección, en la parte inferior de la ventana aparecen dos elementos

comunes. Uno es el botón de “Log”, que al activarlo presenta una ventana textual donde se indica

la secuencia de todas las operaciones que se han llevado a cabo dentro del “Explorer”, sus tiempos

de inicio y fin, así como los mensajes de error más frecuentes. Junto al botón de log aparece un

icono de actividad (el pájaro WEKA, que se mueve cuando se está realizando alguna tarea) y un

indicador de status, que indica qué tarea se está realizando en este momento dentro del Explorer.

-13-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

1.4.1.

Preprocesado

Esta es la parte primera por la que se debe pasar antes de realizar ninguna otra

operación, ya que se precisan datos para poder llevar a cabo cualquier análisis. El primer

paso para comenzar a trabajar con el explorador es definir el origen de los datos. Weka soporta

diferentes fuentes que coinciden con los botones que están debajo de las pestañas superiores

mostrados en la ventana 1.5. La disposición de la parte de preprocesado del Explorer, Preprocess,

es la que se indica en la figura 1.5 siguiente.

Figura 1.5. Ventana de Preprocesamiento

Hay tres posibilidades para obtener los datos: un fichero de texto, una dirección URL o una base de

datos, dadas por las opciones: Open file, Open URL y Open DB, correspondientes a los primeros

tres botones en la parte superior de la sección de proceso:

La manera más fácil y más común de obtener la data para introducir en Weka es aquella con

formato ARFF y cargarla usando el botón Open File… (ARFF tienen extención “.arff”).

Entonces, para abrir ficheros en Weka, las diferentes posibilidades son las siguientes:

Open File

Al pulsar sobre este botón aparecerá una ventana de selección de fichero. Aunque el formato por

defecto de Weka es el arff eso no significa que sea el único que admita, para ello tiene

interpretadores de otros formatos. Éstos son:

-14-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

− CSV

Archivos separados por comas o tabuladores. La primera línea contiene los

atributos. Podemos convertir ficheros en texto conteniendo un registro por línea y con los

atributos separados con comas (formato csv) a ficheror arff mediante el uso de un filtro

convertidor, como se explicará más adelante.

− C4.5

Archivos codificados según el formato C4.5. Unos datos codificados según este

formato estarían agrupados de tal manera que en un fichero .names estarían los nombres de los

atributos y en un fichero .data estarían los datos en sí. Weka cuando lee ficheros codificados

según el formato C4.5 asume que ambos ficheros (el de definición de atributos y el de datos)

están en el mismo directorio, por lo que sólo es necesario especificar uno de los dos.

Instancias Serializadas

Weka internamente almacena cada muestra de los datos como una instancia de la clase instance.

Esta clase es serializable12 por lo que estos objetos pueden ser volcados directamente sobre un

fichero y también cargados de uno.

Para cargar un archivo arff simplemente debemos buscar la ruta donde se encuentra el fichero y

seleccionarlo. Si dicho fichero no tiene extensión arff, al abrirlo Weka intentará interpretarlo, si

no lo consigue aparecerá un mensaje de error como el de la figura 1.5.

Figura 1.5. Error al abrir un fichero.

Pulsando en Use converter nos dará la opción de usar un interpretador de ficheros de los tipos ya

expuestos.

Open Url

Con este botón se abrirá una ventana que nos permitirá introducir una dirección en la que definir

dónde se encuentra nuestro fichero. El tratamiento de los ficheros (restricciones de formato, etc.)

es el mismo que el apartado anterior.

Open DB

Con este botón se nos da la posibilidad de obtener los datos de una base de datos.

12

En Java un objeto es serializable cuando su contenido (datos) y su estructura se transforman en una

secuencia de bytes al ser almacenado. Esto hace que estos objetos puedan ser enviados por algún flujo de

datos con comodidad

-15-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Figura 1.6: Ventana para seleccionar una base de datos.

Para configurarla lo primero es definir la url por la cual es accesible la base de datos, la contraseña

para acceder, el nombre de usuario, la consulta que queremos realizar y si queremos o no usar el

modo de datos abreviado (sparse data). Así mismo los botones de la parte inferior dan posibilidad

de cargar y guardar esta configuración en un fichero.

Una vez seleccionado el origen de los datos podremos aplicar algún filtro sobre él o bien pasar a las

siguientes secciones y realizar otras tareas.

Los botones que acompañan a abrir el fichero: Undo y Save, nos permiten deshacer los cambios y

guardar los nuevos datos ya transformados (en formato arff). Además, se muestra en la ventana

(figura 1.7) una vez cargados los datos, un cuadro resumen, Current relation, con el nombre de la

relación que se indica en el fichero (en la línea @relation del fichero arff), el número de instancias

y el número de atributos, junto con un resumen con estadísticas de los mismos (media aritmética,

rango de los datos, desviación estándar, número de instancias distintas, de qué tipo son, etc.). de

modo que se pueden seleccionar para ver sus detalles y propiedades.

Figura 1.7: Modo explorador con un fichero de datos cargado.

-16-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

En la parte derecha aparecen las propiedades del atributo seleccionado. Si es un atributo simbólico,

se presenta la distribución de valores de ese atributo (número de instancias que tienen cada uno de

los valores). Si es numérico aparece los valores máximo, mínimo, valor medio y desviación

estándar.

Si seleccionamos cada uno de los atributos, conoceremos más información del atributo en cuestión:

tipo (Type) nominal o numérico, valores distintos (Distinct), número y porcentaje de instancias con

valor desconocido para el atributo (Missing codificado en el fichero arff con “?”) y valores de

atributo que solamente se dan en una instancia (Unique). Debajo de este resumen se muestra un

histograma con información sobre la distribución de los ejemplos para ese atributo, arriba de éste

hay un menú desplegable que permite variar el atributo de referencia que se representará en color

para contrastar ambos atributos. Pulsando en Visualize all se abre una ventana desplegable

mostrando todas las gráficas pertenecientes a todos los atributos.

En nuestro ejemplo (pruebas de selectividad), utilizaremos siempre los datos almacenados en un

fichero, que es lo más rápido y cómodo de utilizar. En el ejemplo que nos ocupa, abra el fichero

“selectividad.arff” con la opción Open File.

Siguiendo con el ejemplo, una vez cargado e fichero “selective.arff”, observamos la siguiente ventana:

En la parte inferior se presenta gráficamente el histograma con los valores que toma el atributo. Si es

simbólico, la distribución de frecuencia de los valores, si es numérico, un histograma con intervalos

uniformes. En el histograma se puede presentar además con colores distintos la distribución de un segundo

atributo para cada valor del atributo visualizado. A modo de ejemplo, a continuación mostramos el

histograma por localidades, indicando con colores la distribuciones por opciones elegidas.

-17-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Se ha seleccionado la columna de la localidad de Leganés, la que tiene más instancias, y donde puede verse

que la proporción de las opciones científicas (1 y 2) es superior a otras localidades, como Getafe, la segunda

localidad en número de alumnos presentados.

Ejercitación: Visualice los histogramas de las calificaciones de bachillerato y calificación final de

la prueba, indicando como segundo atributo la convocatoria en la que se presentan los alumnos

1.4.1.1.

Creación e Importación de ficheros CVS

Los ficheros de datos están habitualmente en formato ASCII (texto) delimitado por espacios en

blanco o en formato Excel. Weka no puede leer directamente ficheros Excel (de extensión .xls),

pero sí ficheros ASCII que usen como delimitador la coma, como los CSV (columnas separas por

coma).

Creación del fichero CSV

Tenemos un fichero de datos procedentes de MS Excel, la tabla de datos maquina.xls:

Figura 1.8. Hoja de Excel con la tabla “maquina”

-18-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Este fichero contiene 3 variables numéricas y 2 categórica. La primera fila contiene, además, las

etiquetas de las variables.

Generamos un fichero CVS desde Excel ingresando en Archivo, Guardar como...

Figura 1.9. Guardar Como desde Excel

Se abre una ventana (figura 1.10) en la que especificamos la carpeta o directorio de destino (P.ej.:

A:\, C:\Mis Documentos, ...) el nombre de fichero (en este caso, calidad maquina.cvs) y el tipo de

archivo como CSV (delimitado por comas):

Figura 1.10 Selección del destino y tipo de fichero a guardar

-19-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Pinchamos en Guardar y ya tenemos el fichero CSV que Weka puede leer.

Nota: la generación de ficheros delimitados por coma o por punto y coma depende de la configuración

regional del sistema operativo. Si tenemos configurado el signo decimal como “.” (punto), los archivos que

se creen bajo este sistema usaran como separador de columna (atributo) el “;” (punto y coma); cómo Weka

importa sólo los delimitados por coma y no por punto y coma, tendremos que reemplazar los “;” (punto y

coma) por “,” (comas) con la ayuda del Block de Nota de Windows.

Lectura de fichero CSV y creación del fichero ARFF

Como dijimos, Weka no trabaja directamente con ficheros de datos ASCII, sino que necesita

convertirlos a un formato propio de fichero, lo que se conoce como ficheros ARFF. Para realizar esa

conversión, por ejemplo, en el caso del fichero “maquina.csv” que hemos creado, pinchamos en

“Open File...”, indicamos en tipo de archivo “todos los archivos” y seleccionamos el fichero CSV

que creamos.

Figura 1.11. Cargar el fichero CSV desde Weka.

Weka detecta que no es un fichero ARFF y permite usar el conversor (figura 1.12). Pinchamos en

“User Conver” y luego “OK”.

Figura 1.12. Uso del conversor CSVLoader de Weka

-20-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Weka carga el fichero:

Fichero 1.13. Fichero cargado

Finalmente para guardar este archivo en el formato ARFF, incesamos en “Save”, donde indicamos

el destino, nombre y tipo de archivo (asegurarse de escribir la extensión “.arff” junto con el

nombre).

Figura 1.14. Guardar el fichero en el formato ARFF

-21-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

1.4.1.2.

Aplicación de filtros

Weka permite aplicar una gran diversidad de filtros sobre los datos, permitiendo realizar transformaciones sobre ellos de todo tipo. Al pulsar el botón Choose dentro del recuadro Filter se nos

despliega un árbol en el que seleccionar los atributos a escoger (figura 1.15). Permite escoger un

filtro y tener sus opciones de configuración.

Figura 2.15: Aplicando un filtro en el modo explorador.

WEKA tiene integrados filtros que permiten realizar manipulaciones sobre los datos en dos niveles:

atributos e instancias. Las operaciones de filtrado pueden aplicarse “en cascada”, de manera que

cada filtro toma como entrada el conjunto de datos resultante de haber aplicado un filtro anterior.

Una vez que se ha aplicado un filtro, la relación cambia ya para el resto de operaciones llevadas a

cabo, existiendo siempre la opción de deshacer la última operación de filtrado aplicada con el

botón Undo. Además, pueden guardarse los resultados de aplicar filtros en nuevos ficheros, que

también serán de tipo ARFF, para manipulaciones posteriores

Tendremos acceso a multitud de herramientas para el preprocesamiento de datos. Estas

herramientas permiten (entre otras muchas funcionalidades):

− Realizar un filtrado de atributos

− Cambiar el tipo de los atributos (discretizar o numerizar)

− Realizar muestreos sobre los datos

− Normalizar atributos numéricos

− Unificar valores de un mismo atributo

El mismo tipo de cuadro de diálogo es usado para otros objetos como clasificadores (classifiers) y

agrupadores (clusters), como se verá a continuación. Un simple click en el botón izquierdo del

Mouse en el nombre del filtro, en la parte superior de la ventana, genera un la lista (drop down list)

de todos los filtros, ahí se hace click en el requerido. Cuando es escogido un filtro, el campo en la

ventana cambia para reflejar las opciones disponibles. Haciendo click en cualquiera de éstas, da la

oportunidad de cambiar su configuración (settings).

Puede verse que los filtros de esta opción son de tipo no supervisado (unsupervised): son

operaciones independientes del algoritmo análisis posterior, a diferencia de los filtros supervisados

que se verán en la sección de “selección de atributos”, que operan en conjunción con algoritmos de

clasificación para analizar su efecto.

-22-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Están agrupados según modifiquen los atributos resultantes o seleccionen un subconjunto de

instancias (los filtros de atributos pueden verse como filtros "verticales" sobre la tabla de datos, y

los filtros de instancias como filtros "horizontales"). Como puede verse, hay más de 30

posibilidades, de las que destacaremos únicamente algunas de las más frecuentes. A continuación se

hace una breve descripción de cada uno de ellos13.

Attribute Los filtros agrupados en esta categoría son aplicados a atributos.

•

Add Añade un atributo más. Como parámetros debemos proporcionarle la posición que va a ocupar este

nuevo atributo (esta vez comenzando desde el 1), el nombre del atributo y los posibles valores de ese

atributo separados entre comas. Si no se especifican, se sobreentiende que el atributo es numérico.

•

AddExpression Este filtro es muy útil puesto que permite agregar al final un atributo que sea el valor de

una función. Es necesario especificarle la fórmula que describe este atributo, en donde podemos calcular

dicho atributo a partir de los valores de otro u otros, refiriéndonos a los otros atributos por “a” seguido del

número del atributo (comenzando por 1). Por ejemplo: (a3^3.4)*a1+sqrt(floor(tan(a4)))

Los operadores y funciones que soporta son +, —, *, /, ^, log, abs, cos, exp, sqrt, floor (función techo),

ceil (función suelo), rint (redondeo a entero), tan, sin, (,). Otro argumento de este filtro es el nombre del

nuevo atributo.

•

AddNoise Añade ruido a un determinado atributo que debe ser nominal. Podemos especificar el

porcentaje de ruido, la semilla para generarlo y si queremos que al introducir el ruido cuente o no con los

atributos que faltan.

•

ClusterMembership Filtro que dado un conjunto de atributos y el atributo que define la clase de los

mismos, devuelve la probabilidad de cada uno de los atributos de estar clasificados en una clase u otra.

Tiene por parámetro ignoredAttributeIndices que es el rango de atributos que deseamos excluir para

aplicar este filtro. Dicho intervalo podemos expresarlo por cada uno de los índices los atributos separados

por comas o definiendo rangos con el símbolo guión (“-”). Es posible denotar al primer y último atributo

con los identificadores first y last (en este caso la numeración de los atributos comienza en 1, por lo que

first corresponde al atributo número 1).

•

Copy Realiza una copia de un conjunto de atributos en los datos. Este filtro es útil en conjunción con

otros, ya que hay ciertos filtros (la mayoría) que destruyen los datos originales. Como argumentos toma un

conjunto de atributos expresados de la misma forma que el filtro anterior. También tiene una opción que es

invertSelection que invierte la selección realizada (útil para copiar, por ejemplo, todos los atributos menos

uno).

•

Discretize Discretiza un conjunto de valores numéricos en rangos de datos. Como parámetros toma los

índices de los atributos discretizar (attribute indices) y el número de particiones en que queremos que

divida los datos (bins). Si queremos que las particiones las realice por la frecuencia de los datos y no por el

tamaño de estas tenemos la opción useEqual-Frecuency. Si tenemos activa esta última opción podemos

variar el peso de las instancias para la definición de los intervalos con la opción

DesiredWeightOfInstancesPerInterval. Si, al contrario tenemos en cuenta el número de instancias para la

creación de intervalos podemos usar findNumBins que optimiza el procedimiento de confección de los

mismos. Otras opciones son makeBinary que convierte los atributos en binario e invertSelection que

invierte el rango de los atributos elegidos.

•

FistOrder Este filtro realiza una transformación de los datos obteniendo la diferencia de pares

consecutivos de datos, suponiendo un dato inicial adicional de valor 0 para conseguir que la cardinalidad

del grupo de datos resultante sea la misma que la de los datos origen.

Por ejemplo, si los datos son 1 5 4 6, el resultado al aplicar este filtro será 1 4 -1 2. Este filtro toma un

único parámetro que es el conjunto de atributos con el que obtener esta transformación.

13

Por una cuestión de organización interna Weka cataloga todos los filtros dentro de una categoría

denominada Unsu-pervised, en futuras versiones se espera que se habiliten filtros de clase Supervised.

-23-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

•

MakeIndicator Crea un nuevo conjunto de datos reemplazando un atributo nominal por uno booleano

(Asignará “1” si en una instancia se encuentra el atributo nominal seleccionado y “0” en caso contrario).

Como atributos este filtro toma el índice el atributo nominal que actuará como indicador, si se desea que la

salida del filtro sea numérica o nominal y los índices los atributos sobre los que queremos aplicar el filtro.

•

MergeTwoValues Fusiona dos atributos nominales en uno solo. Toma como argumentos la posición del

argumento resultado y la de los argumentos fuente.

•

NominalToBinary Transforma los valores nominales de un atributo en un vector cuyas coordenadas son

binarias.

•

Normalize Normaliza todos los datos de manera que el rango de los datos pase a ser X(i) =

[0,1]. Para normalizar un vector se utiliza la fórmula:

x (i)

n

∑ x(i)

2

i =1

•

NumericToBinary Convierte datos en formato numérico a binario. Si el valor de un

dato es 0 o desconocido, el valor en binario resultante será el 0.

•

NumericTransform Filtro similar a AddExpression pero mucho más potente. Permite aplicar un método

java sobre un conjunto de atributos dándole el nombre de una clase y un método.

•

Obfuscate Ofusca todas las cadenas de texto de los datos. Este filtro es muy útil si se desea compartir una

base de datos pero no se quiere compartir información privada.

•

PKIDiscretize Discretiza atributos numéricos (al igual que Discretize), pero el número de intervalos es

igual a la raíz cuadrada del número de valores definidos.

•

RandomProjection Reduce la dimensionalidad de los datos (útil cuando el conjunto de datos es muy

grande) proyectándola en un subespacio de menor dimensionalidad utilizando para ello una matriz

aleatoria. A pesar de reducir la dimensionalidad los datos resultantes se procura conservar la estructura y

propiedades fundamentales de los mismos.

El funcionamiento se basa en el siguiente producto de matrices: X(i×n)∗R(n×m) = Xrp(i×m)

Siendo X la matriz de datos original de dimensiones i (número de instancias) × n (número de atributos), R

la matriz aleatoria de dimensión n (número de atributos) × m (número de atributos reducidos) y Xrp la

matriz resultante siendo de dimensión i×m.

Como parámetros toma el número de parámetros en los que queremos aplicar este filtro

(numberOfAttributes) y el tipo de distribución de la matriz aleatoria que puede ser:

−

Sparse 1 − 3 con probabilidad

−

Sparse 3 -1 con probabilidad

−

Gaussian Utiliza una distribución gaussiana.

1

2

1

6

, 0 con probabilidad

2

1

.

y 1 con probabilidad

2

3

y

3 con probabilidad

1

6

.

Además de estos parámetros, pueden utilizarse también el número de atributos resultantes después de la

transformación expresado en porcentaje del número de atributos totales (percent), la semilla usada para la

generación de números aleatorios (seed), y si queremos que aplique antes de realizar la transformación el

filtro ReplaceMissingValues,

•

Remove Borra un conjunto de atributos del fichero de datos.

•

RemoveType Elimina el conjunto de atributos de un tipo determinado.

•

RemoveUseless Elimina atributos que oscilan menos que un nivel de variación. Es útil para eliminar

atributos constantes o con un rango muy pequeño. Como parámetro toma el máximo porcentaje de

variación permitido, si este valor obtenido es mayor que la variación obtenida la muestra es eliminada.

•

ReplaceMissingValues Reemplaza todos los valores indefinidos por la moda en el caso de que sea un

atributo nominal o la media aritmética si es un atributo numérico.

-24-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

•

Standarize Estandariza los datos numéricos de la muestra para que tengan de media 0 y la unidad de

varianza. Para estandarizar un vector x se aplica la siguiente fórmula:

x(i ) =

x(i ) − x

σ ( x)

•

StringToNominal Convierte un atributo de tipo cadena en un tipo nominal.

•

StringToWordVector Convierte los atributos de tipo String en un conjunto de atributos representando la

ocurrencia de las palabras del texto. Como atributos toma:

−

DFTranform que indica si queremos que las frecuencias de las palabras sean transformadas según la

regla:

− TFTransform Otra regla de transformación: log(1+frecuencia de la palabra i en la instancia j)

− attributeNamePrefix, prefijo para los nombres de atributos creados

− Delimitadores (delimiters), conjunto de caracteres escape usados para delimitar la unidad fundamental

(token). Esta opción se ignora si la opción onlyAlphabeticTokens está activada, ya que ésta, por

defecto, asigna los tokens a secuencias alfabéticas usando como delimitadores todos los caracteres

distintos a éstos.

− lowerCaseTokens convierte a minúsculas todos los tokens antes de ser añadidos al diccionario.

− normalizeDocLength selecciona si las frecuencias de las palabras en una instancia deben ser

normalizadas o no.

− outputWordCounts cuenta las ocurrencias de cada palabra en vez de mostrar únicamente si están o no

están en el diccionario.

− useStoplist si está activado ignora todas las palabras de una lista de palabras excluidas (stoplist).

− wordsToKeep determina el número de palabras (por clase si hay un asignador de clases) que se

intentarán guardar.

•

SwapValues Intercambia los valores de dos atributos nominales.

•

TimeSeriesDelta Filtro que asume que las instancias forman parte de una serie temporal y reemplaza los

valores de los atributos de forma que cada valor de una instancia es reemplazado con la diferencia entre

el valor actual y el valor pronosticado para dicha instancia. En los casos en los que la variación de tiempo

no se conozca puede ser que la instancia sea eliminada o completada con elementos desconocidos (símbolo

“?”). Opciones:

−

−

−

−

attributeIndices Especifica el rango de atributos en los que aplicar el filtro.

FillWithMissing Las instancias al principio o final del conjunto de datos, donde los valores calculados

son desconocidos, se completan con elementos desconocidos (símbolo “?”) en vez de eliminar dichas

instancias, que es el comportamiento por defecto.

InstanceRange Define el tamaño del rango de valores que se usará para realizar las restas. Si se usa un

valor negativo significa que realizarán los cálculos con valores anteriores.

invertSelection Invierte la selección realizada.

Instance Los filtros son aplicados a instancias concretas enteras.

•

NonSparseToSparse Convierte una muestra de modo completo a modo abreviado.

•

Randomize Modifica el orden de las instancias de forma aleatoria.

•

RemoveFolds Permite eliminar un conjunto de datos. Este filtro está pensado para eliminar una partición

en una validación cruzada.

-25-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

•

RemoveMisclassified Dado un método de clasificación lo aplica sobre la muestra y elimina aquellas

instancias mal clasificadas.

•

RemovePercentage Suprime un porcentaje de muestras.

•

RemoveRange Elimina un rango de instancias.

•

RemoveWithValues Elimina las instancias acordes a una determinada restricción.

•

Resample Obtiene un subconjunto del conjunto inicial de forma aleatoria.

•

SparseToNonSparse Convierte una muestra de modo abreviado a modo completo. Es la operación

complementaria a NonSparseToSparse.

Aplicando filtros

La configuración de un filtro sigue el esquema general de configuración de cualquier algoritmo

integrado en WEKA. Una vez seleccionado el filtro específico con el botón Choose, aparece su

nombre dentro del área de filtro (el lugar donde antes aparecía la palabra None). Se puede

configurar sus parámetros haciendo clic sobre esta área, momento en el que aparece la ventana de

configuración correspondiente a ese filtro particular. Si no se realiza esta operación se utilizarían los

valores por defecto del filtro seleccionado.

El 14proceso general de configuración, es elegir el filtro deseado y sus opciones, luego hacer click

en el botón “Add” para sumarlo a la lista. Los filtros solo serán aplicados cuando se hace click en el

botón “Apply Filters” y serán aplicadas en el orden que aparezcan en la lista.

- Se puede remover en cualquier filtro de la lista con el botón “Delete”.

- El botón “Replace” en la parte superior de la sección de pre proceso reemplaza la “Base

Relation” con el “Current Working Relation”, haciendo los cambios permanentes, al menos hasta

que un nuevo archivo es cargado.

- Finalmente, el botón “Save”… en la parte superior derecha de la pantalla, guarda el “Working

Relation” en archivo de extención ARFF, dejándolo habilitado para usos futuros.

1.4.1.2.1. Ejemplo de aplicación de filtros de atributos.

Vamos a indicar, de entre todas las posibilidades implementadas, la utilización de filtros para

eliminar atributos, para discretizar atributos numéricos, y para añadir nuevos atributos con

expresiones, por la frecuencia con la que se realizan estas operaciones.

Filtros de selección

Vamos a utilizar el filtro de atributos “Remove”, que permite eliminar una serie de atributos del

conjunto de entrada. En primer lugar procedemos a seleccionarlo desde el árbol desplegado con el

botón Choose de los filtros. A continuación lo configuraremos para determinar qué atributos

queremos filtrar.

Como primer filtro de selección, vamos a eliminar de los atributos de entrada todas las

calificaciones parciales de la prueba y la calificación final, quedando como únicas calificaciones la

nota de bachillerato y la calificación de la prueba. Por tanto tenemos que seleccionar los índices

5,6,7,10,12,14 y 17, indicándolo en el cuadro de configuración del filtro Remove:

14

Interfaz Experiemnter permite armar un listado de filtros a aplicar con las opciones Add

-26-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Como puede verse, en el conjunto de atributos a eliminar se pueden poner series de valores

contiguos delimitados por guión (5-7) o valores sueltos entre comas (10,12,14,17). Además, puede

usarse “first” y “last” para indicar el primer y último atributo, respectivamente.

La opción invertSelection es útil cuando realmente queremos seleccionar un pequeño subconjunto

de todos los atributos y eliminar el resto. Open y Save nos permiten guardar configuraciones de

interés en archivos. El botón More, que aparece opcionalmente en algunos elementos de WEKA,

muestra información de utilidad acerca de la configuración de los mismos. Estas convenciones

para designar y seleccionar atributos, ayudan, y para guardar y cargar configuraciones específicas es

común a otros elementos de WEKA.

Una vez configurado, al accionar el botón Apply del área de filtros se modifica el conjunto de datos

(se filtra) y se genera una relación transformada. Esto se hace indicar en la descripción “Current

Relation”, que pasa a ser la resultante de aplicar la operación correspondiente (esta información se

puede ver con más nitidez en la ventana de log, que además nos indicará la cascada de filtros

aplicados a la relación operativa). La relación transformada tras aplicar el filtro podría almacenarse

en un nuevo fichero ARFF con el botón Save, dentro de la ventana Preprocess.

Filtros de discretización

Estos filtros son muy útiles cuando se trabaja con atributos numéricos, puesto que muchas

herramientas de análisis requieren datos simbólicos, y por tanto se necesita aplicar esta

transformación antes. También son necesarios cuando queremos hacer una clasificación sobre un

atributo numérico, por ejemplo clasificar los alumnos aprobados y suspensos. Este filtrado

transforma los atributos numéricos seleccionados en atributos simbólicos, con una serie de

etiquetas resultantes de dividir la amplitud total del atributo en intervalos, con diferentes opciones

para seleccionar los límites.

Por defecto, se divide la amplitud del intervalo en tantas "cajas" como se indique en bins (por

defecto 10), todas ellas de la misma amplitud. Por ejemplo, para discretizar las calificaciones

numéricas en 4 categorías, todas de la misma amplitud, se configuraría así:

-27-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Observe el resultado después de aplicar el filtro y los límites elegidos para cada atributo. En este

caso se ha aplicado a todos los atributos numéricos con la misma configuración (los atributos

seleccionados son first-last, no considerando los atributos que antes del filtrado no eran numéricos).

Observe que la relación de trabajo ahora (“current relation”) ahora es el resultado de aplicar en

secuencia el filtro anterior y el actual.

A veces es más útil no fijar todas las cajas de la misma anchura sino forzar a una distribución

uniforme de instancias por categoría, con la opción useEqualFrequency. La opción findNumBins

permite opimizar el número de cajas (de la misma amplitud), con un criterio de clasificación de

mínimo error en función de las etiquetas.

Haga una nueva discretización de la relación (eliminando el efecto del filtro anterior y dejando la

relación original con el botón Undo) que divida las calificaciones en 4 intervalos de la misma

frecuencia, lo que permite determinar los cuatro cuartiles (intervalos al 25%) de la calificación en la

prueba: los intervalos delimitados por los valores {4, 4.8, 5.76}

Podemos ver que el 75% alcanza la nota de compensación (4). El 50% está entre 4 y 5.755, y el

25% restante a partir de 5.755.

-28-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Filtros de añadir expresiones

Muchas veces es interesante incluir nuevos atributos resultantes de aplicar expresiones a los

existentes, lo que puede traer información de interés o formular cuestiones interesantes sobre los

datos. Por ejemplo, vamos a añadir como atributo de interés la "mejora" sobre la nota de

bachillerato, lo que puede servir para calificar el "éxito" en la prueba. Seleccionamos el filtro de

atributos.

AddExpression, configurado para

obtener la diferencia entre los

atributos calificación en la prueba, y

nota de bachillerato, en las

posiciones15 y 16: después de

aplicarlo aparece este atributo en la

relación, sería el número 19, con el

histograma indicado en la figura.

Después de aplicarlo aparece este

atributo en la relación, sería el

número 19, con el histograma

indicado en la figura:

-29-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

1.4.1.2.2. Ejemplo de aplicación de filtros de instancias.

De entre todas las posibilidades implementadas para filtros de selección de instancias (selección de

rangos, muestreos, etc.), nos centraremos en la utilización de filtros para seleccionar instancias

cuyos atributos cumplen determinadas condiciones.

Selección de instancias con condiciones sobre atributos

Vamos a utilizar el filtro RemoveWithValues, que elimina las instancias de acuerdo a condiciones

definidas sobre uno de los atributos.

Las opciones que aparecen en la ventana de

configuración son las indicadas a continuación.

El atributo utilizado para filtrar se indica en

"attributeIndex". Si es un atributo nominal, se

indican los valores a filtrar en el último

parámetro, "nominalIndices". Si es numérico, se

filtran las instancias con un valor inferior al

punto de corte, "splitPoint". Se puede invertir el

criterio de filtrado mediante el campo

"invertSelection".

Este filtro permite verificar una condición

simple sobre un atributo. Sin embargo, es

posible hacer un filtrado más complejo sobre

varias condiciones aplicadas a uno o varios

atributos sin más que aplicar en cascada varios

filtros.

A modo de ejemplo, utilice tres filtros de este tipo para seleccionar los alumnos de Getafe y

Leganés con una calificación de la prueba entre 6.0 y 8.0. Compruebe el efecto de filtrado

visualizando los histogramas de los atributos correspondientes (localidad y calificación en la

prueba), tal y como se indica en la figura siguiente:

-30-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

1.4.2.

Clasificación

En esta sección abordamos el problema de la clasificación, que es el más frecuente en la práctica.

En ocasiones, el problema de clasificación se formula como un refinamiento en el análisis, una vez

que se han aplicado algoritmos no supervisados de agrupamiento y asociación para describir

relaciones de interés en los datos.

Se pretende construir un modelo que permita predecir la categoría de las instancias en función de

una serie de atributos de entrada. En el caso de WEKA, la clase es simplemente uno de los atributos

simbólicos disponibles, que se convierte en la variable objetivo a predecir. Por defecto, es el último

atributo (última columna) a no ser que se indique otro explícitamente

Pulsando en la segunda pestaña (zona superior) del explorador entramos en el modo clasificación

(figura 1.16). En la parte superior de la sección de clasificadores, está el cuadro “Cassifier”. Este

cuadro contiene un campo de texto que da el nombre de los clasificadores seleccionados por el

momento y sus opciones. Haciendo click en el cuadro de texto, muestra un cuadro de diálogo de un

editor genérico de objeto (generic object editor), al igual que los filtros. Esto permite elegir un

clasificador de los que están disponibles en la Weka y configurarlo.

Como podemos observar en la figura 1.16., el entorno cambia bastante con respecto a la ventana

anterior. La parte superior, como es habitual sirve para seleccionar el algoritmo de clasificación y

configurarlo. El resto de elementos a definir en esta ventana se describen a continuación

Figura 1.16: El modo clasificación dentro del explorador.

-31-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

Si queremos realizar una clasificación lo primero será elegir un clasificador y configurarlo a nuestro gusto, para ello pulsaremos sobre el botón Choose dentro del área Classifier. Una vez pulsado se

desplegará un árbol que nos permitirá seleccionar el clasificador deseado. Una vez seleccionado

aparecerá, en la etiqueta contigua al botón Choose, el filtro seleccionado y los argumentos con los

que se ejecutará. Esta información es muy útil si queremos utilizar el interfaz de consola ya que

podremos configurar nuestro filtro con la interfaz y luego obtener el resultado apto para línea de

mandato.

Para poder acceder a las propiedades de cada clasificador deberemos hacer doble-click sobre la

etiqueta antes mencionada. Al darle aparecerá una nueva ventana con las propiedades junto a una

breve explicación del mismo.

Estos métodos se han agrupado a grandes rasgos en las siguientes familias15:

El resultado de aplicar el clasificador elegido será, probado según las opciones que serán

configuradas haciendo click en el cuadro “test options”. Podemos establecer como queremos

efectuar la validación del modelo aprendido. Entonces una vez elegido el clasificador y sus

características el próximo paso es la configuración del modo de entrenamiento (Test Options).

Weka proporciona 4 modos de prueba:

el clasificador es evaluado en torno a la calidad de predicción de la clase de las

instancias que fue entrenado.

Con esta opción Weka entrenará el método con todos los datos disponibles y luego lo aplicará otra

vez sobre los mismos; evalúa el clasificador sobre el mismo conjunto sobre el que se construye el

modelo predictivo para determinar el error, que en este caso se denomina "error de

resustitución". Por tanto, esta opción puede proporcionar una estimación demasiado optimista del

comportamiento del clasificador, al evaluarlo sobre el mismo conjunto sobre el que se hizo el

modelo

el clasificador es evaluado en torno a calidad de predicción de la clase de un set

de instancias cargadas de un archivo.

Marcando esta opción tendremos la oportunidad de seleccionar, pulsando el botón Set... , un

fichero de datos con el que se probará el clasificador obtenido con el método de clasificación

usado y los datos iniciales. Sobre cada dato se realizará una predicción de clase para contar los

errores.

15

Esta clasificación no es exhaustiva, ya que hay métodos de aprendizaje que caerían en más de uno de

estos grupos.

-32-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

el clasificador es evaluado por validación cruzadas.

Pulsando el botón Cross-validation Weka realizará una validación cruzada 16estratificada del número de particiones dado (Folds). La validación cruzada consiste en: dado un número n se divide

los datos en n partes y, por cada parte, se construye el clasificador con las n - 1 partes restantes y

se prueba con esa. Así por cada una de las n particiones. Esta opción es la más elaborada y

costosa.

Se dividen las instancias en tantas carpetas como se indica y en cada evaluación se toman las

instancias de cada carpeta como datos de test, y el resto como datos de entrenamiento para

construir el modelo. Los errores calculados son el promedio de todas las ejecuciones.

el clasificador es evaluado con respecto a la calidad de predicción de un cierto

porcentaje de datos (data), en los cuales están sustentadas las pruebas.

Se define un porcentaje con el que se construirá el clasificador y con la parte restante se probará.

La cantidad de datos (held) sustentada depende del valor ingresado en el campo “%”.El valor

indicado es el porcentaje de instancias para construir el modelo, que a continuación es evaluado

sobre las que se han dejado aparte. Cuando el número de instancias es suficientemente elevado,

esta opción es suficiente para estimar con precisión las prestaciones del clasificador en el dominio

Mayores alcances (opciones avanzadas) de opciones de prueba, pueden ser configuradas haciendo

click en botón “More options…”: (figura 2.17).

Figura 2.17: Ventana de opciones adicionales en el modo de clasificación.

Las opciones que se nos presentan son:

(salida del modelo): el modelo de clasificación del set de total entrenamiento,

puede ser visto, visualizado o tener otras salidas, permite visualizar (en modo

texto y, con algunos algoritmos, en modo gráfico) el modelo construido por el

clasificador (árbol, reglas, etc.). Una vez construido y probado el clasificador, nos

mostrará en la salida del clasificador (parte media derecha de la ventana 1.16) el

modelo que ha construido.

16

Una validación-cruzada es estratificada cuando cada una de las partes conserva las propiedades de la

muestra original (porcentaje de elementos de cada clase).

-33-

APRENDIZAJE AUTOMÁTICO CON WEKA – CÉSARI MATILDE

(salida estadística por clase): las estadísticas precisión/rellanado

(precesion/recall) y verdadero/falso (true/false), para cada clase pueden

obtenerse. Obtiene estadísticas de los errores de clasificación por cada

uno de los valores que toma el atributo de clase

(salida medidas de evaluación de entropía): Muestra

información de mediciones de la entropía en la clasificación.

(matriz de confusión): la matriz de confusión de las predicciones de los

clasificadores están incluidas en las salidas. Esta tabla cuyo número de

columnas es el número de atributos muestra la clasificación de las

instancias. Da una información muy útil porque no sólo refleja los

errores producidos sino también informa del tipo de éstos.

Si tuviéramos el problema de clasificar un conjunto de vacas en dos clases gordas y flacas y aplicamos

un clasificador, obtendríamos una matriz de confusión como la siguiente.

Gordas Flacas

32

4

Gordas

4

43

Flacas

Tabla 2.1: Ejemplo de una matriz de confusión

Donde las columnas indican las categorías cllasificadas por el clasificador y las filas las categorías reales de los datos. Por lo que los elementos en la diagonal principal son los elementos que

ha acertado el clasificador y lo demás son los errores.

(guarda predicciones de visualización): las predicciones de los

clasificadores son recordados para poder ser visualizados.

(evaluación sensible de costo), los errores son evaluados con respecto

a matriz de costos. El botón “Set…”permite especificar la matriz de

costos usada.

especifica semilla al azar (random seed) usada cuando se azarisan

los datos antes de dividirlos para propósitos de evaluación.

Atributos de Clase

Los clasificadores en Weka, están diseñados para ser entrenados para predecir atributos de clase

simple, el cual es el objetivo de la predicción. Algunos clasificadores solo pueden aprender clases

nominales, otras solo numéricas (problemas de regresión), y otra, pueden aprender ambas.

Debajo de este cuadro de la ventana existe un menú desplegable que nos permitirá seleccionar un

atributo de nuestra muestra. Este atributo es el que actuará como resultado real de la clasificación.

Por descarte, las clases serán el último atributo en los datos. Si se requiere entrenar un clasificador