Pruebas para evaluar diferencias

Anuncio

9/23/14 Pruebas para evaluar diferencias Métodos paramétricos vs no paramétricos • Mayoría se basaban en el conocimiento de las distribuciones muestrales (t-­‐student, Normal, F): – EsFman los parámetros de las poblaciones de origenà “Paramétricos” • Métodos paramétricos son robustos y son preferidos porque Fenen mayor potencia • Hay situaciones en las que no es correcto o no es posible hacer supuestos sobre las distribuciones muestrales subyacentes: – Por el escaso número de observaciones – Por el nivel de medición de las variables 1 9/23/14 Métodos paramétricos vs no paramétricos • ¿qué hacemos cuando no se cumple la normalidad o hay muy pocos datos? • Opciones: – Si hay valores extremos y el tamaño muestral es pequeño cualquier método de inferencia es dudoso. – A veces podemos transformar los datos (log es la transformación más usada) – Existen métodos paramétricos que asumen otras distribuciones (Poisson, Gamma) – Existen métodos que no asumen una distribución à “no paramétricos” o de distribución libre Métodos paramétricos vs no paramétricos • Los métodos no paramétricos son la manera más directa de solucionar el problema de falta de normalidad – Estos métodos son muy simples de usar y están disponibles en so[ware estadísFcos • Tienen dos desventajas: – Menos poder que las soluciones paramétrica equivalentes – Las pruebas de hipótesis no paramétricas NO contestan a la misma pregunta que las pruebas paramétricas. • El test no paramétrico establece la hipótesis en términos de la mediana y el test paramétrico usa la media 2 9/23/14 Diferencias entre distribuciones de frecuencias • Dos Fpos básicos de preguntas: – Un set observado de frecuencias difiere de otro? • Análogo a una prueba de diferencia entre dos muestras – Las frecuencias observadas se ajustan a una distribución estándar? • Evaluación de observaciones contra frecuencias observadas • Pruebas: –

–

–

–

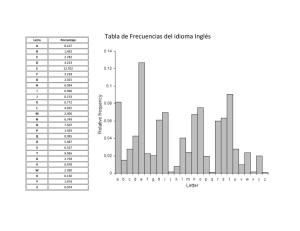

G Bondad de ajuste de chi-­‐cuadrado Kolmogorov – Smirnov Test de normalidad de Shapiro–Wilk Prueba G • En situaciones donde se Fenen frecuencias observadas de varias categorías y las proporciones esperadas para esas categorías son teóricas • Pone a prueba la hipótesis de que las frecuencias observadas no son diferentes de las esperadas • Ejemplo: Un cruce dihibrido de una planta sigue la proporción esperada 9:3:3:1? 3 9/23/14 Prueba G • Procedimiento: – Calcular las frecuencias esperadas: • FE=(Esperado/∑esperados)*total observaciones – Calcular la relación logarítmica: • RL=log(observado-­‐FE)*∑observados – Calcular el valor del estadíFco: • G=2*|(∑RL)| – Encontrar el valor pà una distribución chi-­‐cuadrado con GL igual a el número de categorías menos uno (X2(k-­‐1)) – Si el valor p < 0.05, la distribución observada es igual a la teórica Test de bondad de auste chi-­‐cuadrado • En situaciones donde se Fenen frecuencias observadas de varias categorías y las proporciones esperadas para esas categorías son teóricas • Pone a prueba la hipótesis de que las frecuencias observadas no son diferentes de las esperadas • Uno de las pruebas más uFlizadas en biología 4 9/23/14 Test de bondad de ajuste chi-­‐cuadrado • Procedimiento: – Calcular los valores esperados: • Una distribución de frecuencias (e.j. Poisson) • Asumir que todas las categorías son igualmente probables • A parFr de una hipótesis nula de proporciones – Se calcula el esFmador chi-­‐cuadrado como: – Se calcula la significancia del esFmador X2(valor p) Test de bondad de ajuste chi-­‐cuadrado • Las frecuencias observadas deben ser mayores a 1 • Distribución de ectoparásitos en una pez es aleatoria? • Valores esperados à distribución Poisson 5 9/23/14 Prueba Kolmogorov-­‐Smirnov • Es un test de bondad de ajuste para muestras grandes de datos conFnuos • Dos formas – Una muestra: compara datos observados con distribuciones esperadas • Set de datos difiere de una distribución normal – Dos muestras: evalua si dos distribuciones son iguales • Comparar set de datos de pesos de huevos de una población de patos con un set de otro siFo • Nota : Aunque parece similar a prueba t o de Mann–Whitney U: –

–

–

–

No responden la misma pregunta KS à p que dos distribuciones sean iguales T & M-­‐W à medias y medianas, respecFvamente Dos distribuciones pueden tener igual media y/o mediana y ser diferentes Prueba Kolmogorov-­‐Smirnov • Peso en gramos de 48 ratones sigue una distribución normal? 6 9/23/14 Prueba de Shapiro -­‐ Wilks • Otra prueba comunmente uFlizada para evaluar normalidad Diferencias entre dos muestras 7 9/23/14 Diferencias entre dos muestras • ¿son las diferencias de los valores representaFvos (media, mediana o varianza) de dos grupos de observaciones significaFvamente diferentes, o son sólo el resultado de el error asociado al muestreo? • Ho: las muestras provienen de poblaciones con valores representaFvos similaresà cualquier diferencia detectada proviene del error de muestreo • Ha: las muestras provienen de poblaciones con valores representaFvos diferentes à cualquier diferencia detectada no proviene del error de muestreo Muestras pareadas • Datos Pareados o Dependientes se presentan cuando: – Un mismo individuo experimental es evaluado dos veces (e.g. antes vs después) – Una unidad de muestreo es evaluada dos veces – Individuos similares (“clones”) son asignados aleatoreamente a dos tratamientos diferentes • Pruebas estadísFcas: • Prueba de t pareada • Prueba de rangos de Wilcoxon 8 9/23/14 Prueba de t pareada • Si las dos muestras provienen de una población con promedio igual (Ho es correcta), la diferencia entre los pares de observaciones deberían estar normalmente distribuidos alrededor de 0 • Ho:μ1 -­‐ μ2=0 Ha:μ1 – μ2≠0 Prueba de t pareada • Ejemplo: Se sugiere que la presencia de una estación eléctrica incrementó las par{culas en suspensión de una localidad. Se cuenta con un registro de par{culas 1 mes antes de la construcción y 1 mes después de la construcción 9 9/23/14 Prueba Rangos de Wilcoxon • Es la prueba No paramétrica equivalente a una prueba de t-­‐

pareada • Los datos deben estar registrados en una escala conFnua: peso, longitud, etc. • Procedimiento: 1. Establece diferencia en magnitud A – B = d 2. Organiza de menor a mayor (rango) las d 3. Asigna un signo (+ o -­‐) a cada d 4. Suma los rangos de cada signo por separado 5. El resultado menor es el estadísFco T 6. Compara estadísFco con una distribución 7. Toma decisión Prueba Rangos de Wilcoxon • Ejemplo: Se midió el flujo de agua en 7 estaciones de un río durante 2 días. ¿el flujo es significaFvamente diferente? 10 9/23/14 Datos No pareados o Independientes • Se presentan cuando unidad experiemental o de muestreo es evaluada una sola vez: – Dos grupos de observaciones son totalmente independientes: machos vs hembras, siFo A vs siFo B. • Pruebas estadísFcas: – Prueba de t independiente – Analisis de varianza de una vía – Prueba U de Mann-­‐Whitney Prueba de t independiente • Es el Fpo de prueba de t más usual • Evalua si los dos conjuntos de datos que se están comparando son similares – Ho:μ1 =μ2 – Ha:μ1 ≠μ2 • Supuestos: – Datos son conFnuos – Siguen una aproximada a la distribución normal – Las varianzas son homogéneas: • Test de Levene para igualdad de varianzas 11 9/23/14 Prueba de t independiente Prueba de t independiente • Ejemplo: Se pesaron 5 granos provenientes de dos culFvos experimentales “Premium” y “Super”. ¿es significaFvamente diferente el peso promedio del grano entre los dos culFvos? 12 9/23/14 Análisis de Varianza de Una Vía • Es la forma más simple de aplicar una Análisis de Varianza • Proporciona el mismo resultado que una prueba de t-­‐independiente • Supuestos: – Datos son conFnuos – Siguen una distribución normal – Las varianzas son homogéneas Análisis de Varianza de Una Vía • Ho:μ1 =μ2 – (la variación dentro de los grupos es igual a la variación entre los grupos) • Ha:μ1 ≠μ2 – (la variación dentro de los grupos es menor a la variación entre los grupos) 13 9/23/14 Prueba U de Mann-­‐Whitney • Es el equivalente No paramétrico para comparar dos grupos independientes • No considera supuesto de distribución normal ni homogeneidad de varianzas • Ideal para comparar muestras con valores extremos • Es una prueba {pica de rangos à Compara Medianas!!! • El tamaño de las muestras puede ser pequeño y no necesariamente igual 14

![Resultados, discusión y conclusiones [Modo de compatibilidad]](http://s2.studylib.es/store/data/006065578_1-296ede2d1e70632a69398a55a5da9e4d-300x300.png)