Análisis de Regresión y Correlación Lineal

Anuncio

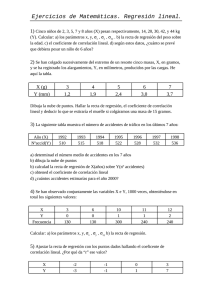

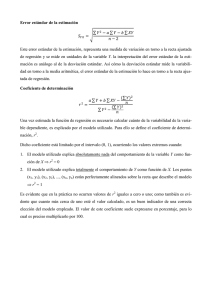

Análisis de Regresión y Correlación Lineal Problemas donde intervienen dos o más variables numéricas • Estudiaremos el tipo de relaciones que existen entre ellas, y de que forma se asocian Ejemplos: • La presión de una masa de gas depende de su volumen y de su temperatura. • En un proceso químico , el rendimiento del producto se relaciona con la temperatura de operación del proceso. • El peso y la presión arterial se relacionan. Analizaremos dos técnicas : la de regresión y correlación – Uno de los objetivos de muchas investigaciones en Ingeniería es hacer predicciones, preferentemente usando ecuaciones matemáticas. El análisis de regresión se utiliza principalmente con éste propósito – El investigador suele tener razones teóricas o prácticas para creer que determinada variable es causalmente dependiente de una o más variables distintas. – Si hay suficientes observaciones empíricas sobre estas variables, el análisis de regresión es un método apropiado para describir la estructura, fuerza y sentido exacto de esta asociación. Análisis de Regresión – El modelo permite predecir los valores de una variable dependiente basados en los valores de al menos una variable independiente – La distinción entre variables dependientes e independientes debe fundamentarse con conceptos teóricos, por experiencia y estudios anteriores. – Solo nos ocuparemos del caso de un modelo de regresión simple; usa una sola variable independiente x para predecir el valor de la variable dependiente y. El análisis de correlación • Se utiliza para medir la intensidad de la asociación entre las variables numéricas. • En otras palabras el análisis de correlación estima la fuerza de la dependencia de una variable respecto de la otra. Diagrama de dispersión El conjunto de observaciones ( xi , y i ) forman el diagrama de dispersión. Se ubican en un sistema de coordenadas. • A partir del diagrama de dispersión es posible , con frecuencia, visualizar una curva suave que aproxima a los datos. En algunos casos vemos que existe una relación lineal y en otros puede existir una relación no lineal . Solo nos ocuparemos del caso lineal. Tipos de relación entre variables (correlación) • Dos variables pueden estar relacionadas por una dependencia funcional, por una dependencia estadística o pueden ser independientes. • Raramente se determina una dependencia funcional rigurosa ya que ambas variables o una de ellas, están expuestas a factores aleatorios, surge entonces una dependencia estadística. • La dependencia se llama estadística cuando la variación de una de las variables da lugar a la alteración de la distribución de la otra. • La dependencia estadística se manifiesta en que, al variar una de las variables se altera el valor medio de la otra, en este caso se llama dependencia de correlación Dependencia de correlación • Dijimos que se da cuando al variar una de las variables se altera el valor medio de la otra. • Ejemplo :supongamos que estamos analizando las alturas de diferentes ciudades y las temperaturas. • Puede darse el caso de que a iguales alturas en diferentes ciudades, se obtienen distintas temperaturas. Es decir, y no es función de x. Esto se debe a factores aleatorios como vientos, lluvias, etc. Pero se puede demostrar que la temperatura media es función de la altura. Es decir Y está vinculada con X por una dependencia de correlación. Para precisar esto necesitamos el concepto de media condicional Ejemplo Media condicional • Supongamos que en tres ciudades que están a 200 m de altura sobre el nivel del mar las temperaturas son 5°C; 7°C; y 12°C respectivamente . • Para estudiar el enlace entre las variables aleatorias X e Y, admitamos que a cada valor de x, le corresponden varios valores de y. Media condicional x1 = 2 toma los valores y1 = 5; y 2 = 7 ;y 3 = 12 5 + 7 + 12 entonces y 2 = =8 3 Se llama media condicional (la variable aleatoria Y depende de X correlativamente) Se llama media condicional y x a la media aritmética de los valores de y correspondientes al valor de X = x Dependencia de correlación • Se llama dependencia de correlación de Y respecto de X, a la dependencia funcional de la media condicional respecto de x: yx = f (x) Ecuación de regresión de Y en X Función de regresión de Y en X Análogamente se determina xy = g ( y ) Determinación de las rectas de regresión • Las gráficas de f(x) y g(y) son rectas llamadas rectas de regresión • Y= ax+b • a = pendiente de la recta de regresión , también llamado coeficiente de regresión muestral de y en x DIAGRAMA DE DISPERSIÓN RECTA DE REGRESIÓN y = a + bx Cálculo de la Recta de Regresión de Y en X Se eligen los parámetros a y b de manera tal que los puntos del plano (los valores observados) se encuentren lo más cerca posible a la recta de regresión. Para el cálculo de la recta de regresión se aplica el método de mínimos cuadrados entre dos variables. uno. Y = ax + b donde a = ρ yx Notación Yi − yi :desviación, donde Yi es una ordenada calculada por la ecuación correspondiente al valor observado yi Como no podemos hacer mínima cada desviación, haremos mínima su suma: n ∑ (Y i − yi ) i =1 Tan cercana a cero como sea posible. Pero esta suma se puede hacer cero de muchas maneras y los errores compensarse, por lo que elegiremos para minimizar n F ( ρ, b ) = ∑ (Yi − y i ) 2 i =1 n n F ( ρ, b ) = ∑ (Yi − y i ) = ∑ ( ρ yx xi + b − y i ) i =1 2 i =1 2 Para minimizar n F ( ρ , b ) = ∑ (Yi − y i ) 2 i =1 n 2 ∂F ∂F = ρ x + b − y 2 ( yx i ∑ i ) .x i = 0 ∂ρ = 0 ∂ρ i =1 ∑ y i = bn + ρ ∑ xi n ⇒ ∂F ⇒ 2 ∂F = x + b − y = 2 0 ρ = 0 ( yx i ∑ i) ∂b ∂b x y = b x + ρ x2 ∑ i ∑ i i =1 ∑ i i Resolviendo el sistema obtenemos ρ yx = n ∑ xi y i − ∑ xi ∑ y i n ∑ xi2 − ( ∑ xi ) 2 y ∑ b= n Ecuación muestral de regresión de Y en X Ecuación muestral de regresión de X en Y i x ∑ −ρ i n y x = ρ yx x + b x y = ρ xy y + c Ejemplo Para ajustar una recta a un conjunto de datos apareados, veamos en este caso, X: representa el tiempo de recalentamiento e Y los espesores de óxido de cierta pieza: X (en min) 20 30 40 Y 3,5 7,4 7,1 60 70 90 100 120 150 180 15,6 11,1 14,9 23,5 27,1 22,1 32,9 (en Angst rom) ∑x y i i = 18469 2 x ∑ i = 98800 ∑x i = 860 ⇒ ρ yx = 0,17 ∑y b = 1,9 i = 165,2 y x = 0,17 x + 1,9 Cómo usar y x = 0,17 x + 1,9 Por ejemplo, para predecir que el espesor de óxido de hierro de una pieza calentada durante 80 minutos: y x = 0,17.80 + 1,9 = 15,5 Angstrom ? Coeficiente de correlación de la población La medida del grado de relación entre dos variables, se llama coeficiente de correlación (r) Supuestos para aplicar este modelo: a) X e Y son variables aleatorias. b) La población bivariable debe ser normal. (X e Y distribuidas normalmente) c) La relación entre X e Y es, en cierto sentido, lineal. Este supuesto implica que todas las medias de Y asociadas con valores de X, caen sobre una recta que es la recta de regresión de Y en X. Análogamente, todas las medias de X asociadas con valores de Y, caen sobre la recta de regresión de X en Y. Coeficiente de Correlación • • • • Es la medida de la intensidad de la relación lineal entre dos variables. El valor del coeficiente de correlación puede tomar valores desde menos uno hasta uno, indicando que mientras más cercano a uno sea el valor del coeficiente de correlación, en cualquier dirección, más fuerte será la asociación lineal entre las dos variables. Mientras más cercano a cero sea el coeficiente de correlación indicará que más débil es la asociación entre ambas variables. Si es igual a cero se concluirá que no existe relación lineal alguna entre ambas variables. Si el valor del coeficiente de correlación muestral es mayor de 0,93 se considera buena la estimación que se realiza con la recta de regresión. Hablaremos de correlación lineal fuerte cuando la nube se parezca mucho a una recta y será cada vez más débil (o menos fuerte) cuando la nube vaya desparramándose con respecto a la recta. En el gráfico observamos que en nuestro ejemplo la correlación es bastante fuerte, ya que la recta que hemos dibujado está próxima a los puntos de la nube. • Cuando la recta es creciente la correlación es positiva o directa: al aumentar una variable, la otra tiene también tendencia a aumentar, como en el ejemplo anterior. Cuando la recta es decreciente la correlación es negativa o inversa: al aumentar una variable, la otra tiene tendencia a disminuir.