Estimación robusta - Instituto Nacional de Estadistica.

Anuncio

ESTADISTICA ESPAÑOLA

Vol. 36, Núrn. 137, 1994, págs. 327 a 387

Estimación robusta

por

RUBEN H. ZAMAR

University of British Columbia

RESUMEN

En este artícula se presentan algunos enfoques recientes de la

teoría de estimación robusta, particularmente resultados en el área

de minimización del sesgo máximo. Se describen algunos estimadores robustos de regresión y se introduce la definición de curva de

sesgo máximo. Se discute !a relación entre esta curva y la sensitividad a errores groseros. Estos conceptos se ilustran en el caso de

modelos sencillos de posición y dispersión.

Palabras clave: estimadores minimax, sesgo máximo, sensibilidad a

contaminacíones.

C/asificación AMS: 62Jxx, 62H12.

1.

INTRODUCCION

Una práctica muy común en estadística (tanto teórica como aplicada) es suponer que los datos han sido generados por un mecanismo aleatorio y que éste

puede ser representado por un miembro F^ de la familia paramétrica de funciones de distribución

^={F^:HE O}

[1]

E^.^EAE^I^TI(^^1 E^^Ei,1tic)I„^

La característica más sobresaliente de estos modelos matemáticos es la suposición de que el mecanismo aleatorio que generó las observaciones es totalmente conocido a excepción del parámetro desconocido e. Naturalmente, el

principal problema en estos casos es la estimación de e usando un estimador 6„

con buenas propiedades estadisticas: sesgo pequeño o nulo y varianza pequeña. Un método que, en general, satisface estos requerimientos es el método de

máxima verosirnilitud. Muchos de los métodos de estimación usados en la práctica fueron derivados a partir de modelos paramétricos, notablemente modelos

normales o gaussianos. Además, las prapiedades estadísticas de estos métodos han sido estudiadas a la luz de tales modelos.

Desafortunadamente, ios mecanismos aleatorios que producen los datos en

la práctica muy raramente obedecen con exactitud a un modelo paramétrico. En

muchos casos, sin embargo, el modelo paramétrico provee una razonable aproximación del mecanismo estocástico F que cantrola la generación de las observaciones.

En resumen, la utilización del modelo [1 ] y, consecuentemente, el empleo de

^

estimadores de máxima verosimilitud 8„ se justifica usualmente por los siguientes argumentos:

a)

EI modelo [1 ] se cumple aproximadamente.

b)

Las buenas propiedades del método utilizado para estimar 9{máxima

verosimilitud) son continuas, de manera que, si el modelo es aproxima^

damente válido, entonces en es aproximadamente óptimo.

Mientras que la propiedad (a ) es cierta con frecuencia, la propiedad {b } no

lo es en muchos casos que incluyen el importante modelo normal. En efecto,

puede demostrarse que la eficiencia de la media aritmética X{el estimador óptimo bajo el modelo de pasición normal} puede ser arbitrariamente próxima a

cero para distribuciones que son arbitrariamente próximas a la normaf. Si, por

ejemplo, tenemos veinte mediciones independientes X; = µ+ E; , diecinueve de

las cuales son normales con desviación típica . 03 y una es un outlier x, y si el

promedio de las diecinueve observaciones normales es 1.0, entonces X=.95 +

+.05x ^^, si x-^ ^. Si, por ejempfo, x= 2.8, entonces X= 1.09, a pesar de

que, en este caso, las diecinueve observaciones normales estarán típicamente

contenidas en el intervalo (0.91, 1.09). Además, las densidades normales N(^, 6)

y .95N (1, 6} + .05N ( 2.8, 6) (a = . 03) son prácticamente indistinguibles,

EI ejemplo del párrafo anterior muestra que el estimador de máxima verosimilitud bajo el modelo normal ( en este caso, la media muestral) puede producir

estimaciones muy ineficientes si los datos son producidos por una distribución

que es próxima, pero no exactamente igual, a la normal. La conclusión, en mi

opinión, es que el hecho de que el modelo normal es solamente una buena

E•:ti^^fl?^^tAC'ION itOBt'S'fA

^?y

aproximación del mecanismo aleatorio que generó las observaciones es algo

que debe tenerse en cuenta explícitamente en el momento de escoger el estimador µn de µ.

Una manera de incorporar explícitamente ia cuestión de la naturaleza aproximada del modelo paramétrico F,^ es suponer que la distribución F pertenece a la

familia ^^ definida como

.^E _ { (1 -- E) F^ + ^H : 8 E O}

[2)

donde o<^< 0.5 es fijo y H es arbitraria y desconocida. Esta familia de contaminación

inicialmente propuesta por Tukey

es rnuy simple y, además, re#leja fielmente situaciones en que la mayoría de !as observaciones provienen de!

modelo [1 ], pero una pequeña fracción ^ de las observaciones son outlíers generados po r H.

Por supuesto, hay otros tipos de entornos de F® que podrían usarse en lugar

de [2]. Por ejemplo, entornos basados en distancias entre dístríbuciones como

la distancia de variación total o la distancia de Levy. Sin embargo, el entorno de

contaminación [2] tiene la doble ventaja de ser simple y apropiado.

EI comportamiento de un estimador consistente 6„ de e, bajo el modelo paramétrico^ Fe , puede medirse de forma natural en términos de la varianza asintótica A V (e„ , Fg ). Por otro lado, cuand© uno supone que la distribución F es un ele^

mento de ^^, los estimadores 6„ serán en generai asintóticamente sesgados y,

por lo tanto, el sesgo asintótico es un aspecto importante a considerar. Otro aspecto importante es el hecho de que la distribución F no está completamente

especificada, puesto que H es desconacida.

En lo que sigue supondremos que el es#imador 8„ depende de los datos únicamente a través de la distribución ernpí rica

Fn (z) =n 1 ^ bz,(z)

donde ^ Z (z )= 1 si cada elemento del vector z es menor o igual que el correspondíenté elemento del vector ^; , y b Z( z )= 0 en otro caso. Por lo tanto, 8n

,

puede escribirse corno

^^O

E^_^^1^^^[^)I^^T^^I(':1^ f^S1'A:^i^E.,1

n

También supondremos que el funcional H(F^ ) admite una extensión natural

^

H(F), con F en un conjunto de distribuciones que contiene a la familia F. Finalmente, supondrernos que el funcional 8 (F) es Fisher consistente:

n

6(Fe)=8, b'6E O

A

y que e^ ( F^ ) es consistente:

^

^

lim ^ (F^ } _ 9 {F), a.s. ^F]

^

para toda F E F. . Como, en general, H( F)^ 6 cuando F^^F , deberemos pres^

tar especial atención a la cuestián del sesgo asintótico de 8{F„ ).

A menudo, el espacio paramétrico O tiene ciertas propiedades de invarianza

(o equivarianza} que deben ser respetadas por la medida que se proponga para

evaluar el sesgo asintótico. Por ejemplo, en el caso del modelo simple de posición y dispersión [^ _(µ, 6}J, las medidas del sesgo asintótico del estimador

µ{F„ ) de µ y del estimadar á(F„ ) de 6 deben ser invariantes ante cambios de

posición y escala. Por ejemplo, las medidas de sesgo

lµ (F)-µl

6

Y

^s (F)

^

6

-1^

poseen las propiedades de invarianza deseadas. En general, el sesgo asintótico

del estimador 8(F) cuando F varia sobre .^t; , puede definirse coma

^

b^{F,e}=d[9((1 -^) F^+^H), 9]

donde d es una distancia que respeta las invariancias naturales del espacio O.

En este artículo únicamente consideraremos estimadores que tienen las propiedades de equivarianza requeridas por la naturaleza del espacio paramétrico.

Por ejemplo, sólo trabajamos con estimadores de posición que son equivariantes ante cambios de posición y escala y con estimadores de dispersión que son

invariantes con respecto a cambios de posición y equivariantes con respecto a

cambios de escala. En vista de las propiedades de invarianza de la distancia d y

de las propiedades de equivarianza de ios estimadores considerados en este ar-

F:^f1^1,^^c'!c)ti Kc)Bl':^ 1 :^

^^I

tículo, podemos concentrar nuestra atención en un valor canónico Ho de H,

como, por ejemplo, H^ _(0, 1) en el caso de rnodelos de posición y dispersión.

Más precisamente:

^

bé (F, 8) = d^ 8((1 -- E) FA + cH), 8]

^

= d[ 6((1 -- E} Feo + EH ), 80]

Por ejemplo, en ef caso de modelos de posición y dispersión, los sesgos del

estimador µ( F) de posición y 6( F) de dispersión se reducen a

lµ (F)-µl

^

=^µ(F)I

a

Y

^

6 (F)

^

,^

--1 (=^a(F)-1 ^

E6]

respectivamente.

Este trabajo está organizado como sigue. En la sección 2 discutiré los dos

principales aspectos de la teoría de robustez: eficiencia y estabilidad. En esta

sección también mencionaré brevemente los diferentes enfoques utilizados para

medir la estabilidad de un estimador. En las secciones 3 y 4 describiré dos irnportantes familias de estimadores robustos de regresión. En la sección 5 ilustraré el cálculo de la función de sesgo máximo y la derivación de estimadores de

sesgo minimax en el casa del modelo simple de posición. En la sección 6 daré

algunas conclusiones.

2. DEFINICIONES DE ROBUSTEZ

Ahora pasaremos a consíderar diferentes formas en que se puede medir ia

^

robustez del estimador 8 de 6.

Habiando en términos generales y desde un punto de vista ampiio e infor^

mal, se puede decir que el estimador {o funcianal) 8 (Fn ) es robusto si su cornportamiento es relativamente bueno y estable cuando F varía sobre el entorno

^

^f del modelo paramétrico F^. En otras palabras, el estimador 6(F^ ) debe poseer las siguientes dos propiedades:

EF1ClENCIA: 6 (Fn ) se comporta bien cuando el modelo paramétrico central

F = F^ se satisface.

F^!i l A[)15.^ 1('r1 E-.^PA!^i()I^A

n

ESTAB/LIDAD: EI buen comportamiento de 6{F^ ) se preserva cuando F varia sobre _`^._ .

^

Para cumplir el requerimiento de eficiencia,

8{F„ ) debe ser comparabie con

^

el estimador de máxima verosimilitud ^(F^ ) cuando F= Fe. Más precisamente:

^

1. 9(F} debe ser consistente en el sentido de Fisher

^

e(F^}=8,de

^

6{

F) debe ser asintóticamente normal, con matriz de covarianzas C^( F) y

2.

traza { C ^( FH }} ^ 1+ b

traza { C ,^ ( F^ ) }

[7]

donde ^> 0 es un número pequeño (b = 0.05 y^= 0.10 son valores usuales

de s).

Notemos que la eficiencia asintótica de un estimador multivariante se puede

medir de manera natural en términos de la traza de su matriz de covarianzas

asintótica, esta es, de su «varianza asintótica generalizada». La formalización

del requerimiento de estabilidad ha dada lugar a varios en#oques en la teoría de

robustez: Robustez Cualitativa, Robustez Cuantitativa y Robustez Infinitesimal.

Gada uno de estos enfoques será brevemente discutido a continuación.

Robustez Cualitativa

^

Este enfoque, iniciado par Hampel (1971), considera que el funcionai 9(F}

^

es estable {cualitativamente robusto) si 8 es continuo en una cierta manera {los

detalles técnicos pueden encontrarse en la referencia). Robustez cualitativa es

una propiedad muy básica y, por lo tanto, estimadores que no poseen esta propiedad pueden ser descartados desde el punto de vista de la robustez. Por otro

lado, esta teoría no es completamente satisfactoria por cuanto no permite comparaciones dentro de la clase de estimadores que son cualitativamente robustos.

Robustez Cuantivativa

Este enfoque, originado por Huber ( 1964), intenta cuantificar la estabilidad

^

de 9(F). Esto puede ser hecho en términos del sesgo asintótico máximo:

B ^ (E)=supbe{F,9)

FE 'tt.

E:S"T1!vfAClON RC)Bl!S"1^.A

o en términos de la varianza asintótica generalizada máxima:

AVé (^} = sup traza (C^ (F))

F E .`j F

EI punto de ruptura:

E*=sup{^:Be(

^

representa la mayor fracción de contaminación que el estimador e puede tolera^r

antes de camenzar a comportarse en forma totalmente aberrante. Para que ^

pueda ser considerado estable

cuantitativamente robusto

de acuerdo con

esta teorí a, el sesgo máximo B' ^(^) y la varianza máxima AV ^ (^) deben ser relativamente pequeños. ^bsérvese que el requerimiento de que B^ (^) sea pequeño er^uivale a que la primera condición de eficiencia la consistencia en el senn

sea relativarnente preservada cuando Fvatido de Fisher de 9 (b,^ (Fe , 8) = 0)

ría sobre ^^. Similarmente, el requerimiento de que AV ^(^) sea pequeña es

equivalente a que la segunda condición de eficiencia sea relativamente preservada cuando F varía sobre ^E.

Huber ( 1964) encantró los estimadores que minimizan B ^(E) y AV ^(^) en la

ciase de estimadores M de posición y abrió el camino para el desarrollo de la

teoría de robustez cuantitativa. Como estos estimadores minimizan el sesgo

máximo y la varianza máxima, son Ilamados estimadores minimax.

^

En general, la desviación típica de un estimador 6^ es típicamente de orden

/^, mientras que su sesgo asintótico, si existe, es de orden uno. Entances,

el sesgo asintótico máximo será el término dominante del error cuadrático medio

máximo cuando se permite sesgo asintótico bajo ^E. Es precisamente por esta

razón que Huber ( 1964), para poder derivar su famoso resultado sobre varianza

minimax, evitó ia posibilidad de sesgo asintótico restringiendo la familia }^^ al

subconjunto de funciones simétricas.

Finalmente, como todos los estimadores que consideraremos en este trabajo

son equivariantes, no hay pérdida de generalidad en suponer que 80 = 0. Entonces, el argumento «8» será, de ahora en adelante, omitido en b y B. La distribución bajo el modelo paramétrico central será denotada Fo.

Robustez Infinitesimal

Una manera muy útil de simplificar el estudio del sesgo máximo es aproximar linealmente B^ (^) cerca de cero:

B ^ (^) = B' ^ (0} ^ + o (^)

y concentrar la atención en la cantidad B' é(

F.S"T^,^1C)15^1^1C'A F-:tiE'ANOL^1

Sea bz la función de distribucián que asigna masa uno al punto z. La función

^

^

de infJuencia, IF (^ , z), y la sensibilidad a errores groseros, y(e), fueron definidas por Hampe! t 1974} como

^

lF {8 , z ) = lim

F --^o

^

^

8((1 --E) Fo+E^=)-6(Fo)

^

Y

^

^

y(e) = suP II ^F(e, z) II

z

respectivamente, suponiendo que ei límite existe.

A pesar de ciertas diferencias formales descritas a continuación, cuando y{8}

es finita (caso regular^ se cumple que

^

r (e) = B' ^ (o)

^

^as diferencias formales entre y(6) y B'^ (0) radican en: a) el orden en el que

se aplican la derivada y el supremo, y b) los conjuntos considerados para calcular el supremo. En e! caso de B',^ (o) el supremo se aplica primero y la diferenciacián después, mientras que en el caso de y(9} Ca diferenciación se apCica primero y el supremo después. Con respecto a b), en el caso de B',^ {o) el supre^

mo se aplica sobre el entorno completo ^^, en el caso de y(9) el supremo es

aplicada sobre el sub-entorno incluyendo distribuciones de masa puntual únicamente.

Durante muchos años, las propiedades de «tener influencia limitada» (y (8)

finita) y de «ser robusto» fueron consideradas como propiedades equivalentes.

Sin embargo, la influencia limitada no es una condición necesaria ni suficiente

de robustez: existen estimadores robustos con influencia ilimitada y estimadores

no robustos con influencia limitada. Los estimadores MM y Tau de regresión

descritos en la sección 3 son ejemplos de los primeros. A pesar de tener función

de influencia no acotada, estos estimadores son eficientes bajo el modelo normal y estables cuando este modelo no se cumple. EI alto punto de ruptura y la

eficiencia de estos estimadores es independiente del número de variables independientes y de su distribución. Un ejemplo triviaC de estimadores no robustos

con influencia acotada lo ofrecen los estimadores M de posición que usan la

desviación típica como estimador auxiliar de dispersión. Un ejemplo más interesante lo ofrecen los est'rmadores M generalizados de regresión (GM) descritos

en la sección 4, cuando el númera de variables independientes es grande. Los

Es^r^irwAC^c^^N Kc^^^!s^r.A

335

estimadores GM tienen influencia acotada, pero Maronna, Bustos y Yohai

(1979) mostraron que el punto de ruptura de estos estimadores es menor o igual

que 1/^p , donde p es el número de variables independientes.

3.

ESTIMADORES QUE MINIMIZAN UNA FUNCION DE LOS RESIDUOS

Una buena parte de la teoría de robustez se ocupa del problema de estimación robusta en el modelo de regresión lineal. Existen muchas propuestas de estimadores robustos de regresión y en esta sección nos ocuparemos sólo de algunas de ellas: estimadores S, ^ y MM, definidos por Rousseeuw y Yohai (1984),

Yohai y Zamar (1988) y Yohai (1987}, respectivamente. Estos estimadores tienen la propiedad de minimizar una función objetivo que depende de los datos

únicamente a través de los residuos. En la próxima sección nos ocuparemos de

otra clase de estimadores de regresión Ilamados estimadores M generalizados.

Estos estimadores minimizan una función objetivo más compleja que depende

de los datos a través de Ios residuos y de las variables independientes.

Los estimadores S no pueden ser estables y eficientes al mismo tiempo,

pero tienen la importante ventaja de poder calcularse directamente a partir de

los datos sin necesidad de estimadores iniciales de regresión ni dispersión. Por

esta razón, los estimadores S son a menudo utilizados como estimadores iniciales en los algoritmos de cálculo de estimadores robustos.

Los estimadores ^ y MM pueden cornbinar las propiedades de estabilidad y

eficiencia y se calculan a partir de estimadores S.

Para poder definir los estimadores S de regresión se definirán primero los

estimadores M de escala y dispersión.

Estimadores M de Escala

Huber (1964) definió los estimadores M de la escala de las observaciones

..., r^ como la solución de la ecuación

=b

La función x normalmente satisface las siguientes condiciones: i) x(y )= x(-y );

ii) x es no-decreciente en [0, ^}; iii) x es continua excepto en un número finito de

puntos, y iv} x(^) = 1. Por otro lado, la constante b se toma normalmente igual a

,

Fo x( Y), donde Fo es una distribucion especificada ( e.g. Fo (y) = 1- e-y }.

F^S^I^A[.)IS^^I.ICA ESF',=^Iti(}LA

Martin y Zamar {1989} mostrar-on que, cuando las observaciones r; son positivas,

Mediana {r; } I Fó ' (0.5)

es aproximadamente minimax entre ios estimadores M de escala. Observamos

que la mediana carresponde al caso en que la función ^ es del tipo 0-1 :

x(r )= 0,

= 1,

cuando y<_ a

[9]

cuando y > a

con a= F^ '(0.5). En efecto, cuando n es par y la función x es definida por [9J,

b=EFox(Y}=PF^{Y>F^' (.5)}=0.5

Y

1

^

^

{número de observaciones con r; > á F^ ' (0.5}}

^x(r.lcs)=0.5

n ;^,

'

n

Esta última igualdad, evidentemente, se verifica si á= Mediana {r; } l F^ ' (0.5}.

Un argumento similar combinado con una definición mós amplia de estimadores

M de escata ( ver Huber, 1981) se aplica en el caso en que n es impar.

Estimadores 1'VI de Dispersián

Supongarnos ahora que (y; , x; ), con x; E RP, satisfacen el madelo

y;=g(x;, 8} +aE;

dande g es una función que podemos supaner conocida, por simplicidad. Por

ejemplo, g(x^ , 9} = x; ^ o g{x; , 9} = e X'^ ^ I{1 + e X "^ e}. EI parámetro c^ representa la dispersión de los residuos

r; (9) = y; - g (x; , 8},

n

i = 1, . . . , n

n

[11J

n

Si 6 es un estimador de 8, entonces r; = r; {8) - y; - g(x; , e) son los residuos estimados y el estimador M de dispersión se defíne como la solución s de la ecuación

n ^ x ^ s / b

[12]

H^^rtM^^c^io^v ttc^Ht^s'r^t^

Martin y Zamar (1993) consideran el problema de estimación minimax en la

clase de estimadores M de dispersión cuando g(x; , E^) es constante (modelo de

posición y dispersión). La extensión de estos resultados al caso general podría

ser de cierto interés.

Estimadores S de Regresi^Sn

Sea r^ (t )= y; - g(x; , t), donde t E R P varía libremente, y sea S( t) el estimador M de escala de los números r; (t), i= 1, ..., n. Esto es, S(t) es la solución

en s de la ecuación ^12] con r; = r; (t ). EI estimador S de regresión se define

^

ahora como el vector 8„ que minimiza la escala S(t). Esto es, 8„ satisface la desigualdad

^

S( t)> S {8„ ),

para todo t E R p

Ademés, el estimador S de dispersión, á, se define simplemente como

[ 13]

Cuando la función x es de la forma [9] con a =^-' (3/4) y b= . 5, entonces

S (t) = Mediana {r; (t)}

y el estimador S de regresión en este caso minimiza la mediana ( en lugar de la

media) de los valores absolutos de los residuos. Un estimador muy parecido

que tiene la propiedad de minimizar la mediana del cuadrado de los residuos

fue definido por Rousseeuw ( 1984) y designado con las siglas LMS (least median ©f squares). '

EI cáiculo de estimadores S en forma exacta es un problema numérico muy

complejo, puesto que uno debe encontrar el minimo global de una función no convexa. Rousseeuw y Leroy (1987) proponen un algoritmo basado en sub-muestrea

que praporciona una solución aproximada en el caso del estimador LMS. En lugar de considerar todos los valores posibles de t, una se concentra en el conjunto finito t,, ..., tM de vectores que ajustan exactamente grupos de p+ 1 puntos

(entonces M= n! l[(p + 1)! ( n -- p-- 1)!]). Algoritmos anélogos también pueden

utilizarse para calcular aproximadamente estimadores S. Observemos que para

cafcular S(t^ ) debemos resolver la ecuación no lineal [12] y, cuando M es grande, el tiempo computacional requerido puede ser prohibitivamente alto. Afortunadamente, S(t^ ) necesita ser calculado en promedio /og (M) veces, únicamente cuando

1

r; ( tk )

ñ ^ x * < b

s

[14]

H.^^t a^ i»s^r^c;^ r:s^AVC^i..a

dande

s* -- min (s^, ..., sk _^}

y s^ es la solución de [12j con r, = r; {t^ ).

Estimadares Tau de Regresián

Desafortunadamente, los estimadores S de regresión no pueden ser simultáneamente robustos y eficientes bajo modelos narmales. Si la función ^ se escoge de manera que b(x) = 1/2, el correspondiente estimador S será robusto

(BP (x) = min {b (x), 1 -- b(x)}), pero la eficiencia bajo modelos normales será

rnuy ba^ a. La única manera de alcanzar alta eficiencia es usando una función ^

con b{^) grande (cerca de uno) y, por lo tanto, el correspondiente estimador no

será robusto.

Los estimadores Tau de regresión (así como los estimadores MM de regresión) fueron definidos con el objeto de alcanzar eficiencia y robustez simultáneamente. Sea S(t ) un estimador de escala de los residuos r; (t } y sea p una

función con !as mismas propiedades i)-iv} de x. E! estimador Tau de regresión

se define por !a propiedad de minimizar !a siguiente medida de la escala de !os

residuos r^ ( t }:

r; {t}

^

(t} = s^ (t} n^ P S t

(}

[15]

^.a idea intuitiva que motivó la definición de estas estimadores es !a siguiente: supongamos que !a función p es aproximadamente cuadrática cerca de cero.

Si fos residuos tipificados r; (t ) l S( t ) son relativamente pequeños, entonces

S^{ t) p{r; { ^t )! 5( t}) = r,? ( t) y!a medida de escala ^( t} no será muy diferente

de la función cuadrática ^ r;2 (t }. Por otro lado, si r; ( t )/ S(t } es grande, entances la influencia del punto i es reducida.

Por lo tanto, los estimadores Tau serán aproximadamente eficientes cuando

los datos son aproximadamente normaies y resistentes a la presencia de outlíers, supuesto que !as funcianes ^ y p sean escogidas convenientemente. Por

ejemplo, si x y p son de la familia bi-cuadrada propuesta por Tukey, los valores

apropiados de las constantes ci y c2 de ^ y p para alcanzar punto de ruptura de

1/2 y 95°lo de eficiencia san 1.^4 y 6.4, respectivamente.

ESTI^IA('1()N R()Bl'S"1`A

^i ^ y

Estimadores M de Regresión can Dispersión General

Sea r; (t ) definido como antes y sea ^s un estimador de la dispersión de los

residuos r; (^) (por ejemplo, [13]). EI estimador M de regresión con función de

pérdida p(definida como en la sección anterior) y estirnador de dispersión á, se

define por la propiedad de minimizar en t

r; (t)

1

n ^P^ á I

[16]

Cuando á está dada por [13] se obtiene el estimador MM (estimador M de regresión combinado con un estimador M de dispersión). Yohai ( 1987) probó que en

este caso el punto de ruptura está completamente determinado por la elección

de la función x y que la eficiencia bajo errores normales está completamente

determinada por la elección de la función p. Por lo tanto, estos estimadores pueden ser simultáneamente robustos y eficientes.

Si x y p son de la familia bi-cuadrada propuesta por Tukey, los valores apropiados de las constantes c1 y c2 de x y p para alcanzar punto de ruptura de 1/2

y 95% de eficiencia son 1.04 y 4.7, respectivamente.

Punto de Ruptura, Sensibilidad y Sesgo Máximo

Martin, Yohai y Zamar (1989) probaron que el estimador LMS es aproximadamente minimax entre todos los estimadores M de regresión can escala general. Yohai y Zamar (1993) probaron que esta propiedad minimax se extiende a la

clase de estimadores que dependen únicamente de los residuos (esto excluye

estimadores que reducen la influencia de puntos con alto leverage).

EI punto de ruptura de estos estimadores es independiente de la dimensión

p d e x.

La función de sesgo máximo B(E) de los estimadores de regresión con dispersión general sólo se conoce para el caso de los estimadores S y cuando la

distribución de x bajo el modelo central es elíptica ( ver Martin, Yohai y Zamar,

1989). Yahai y Zamar ( 1993) muestran que

B(>~) =y^+ o(^}

en el caso de estimadores M de regresión con dispersión general. Este resultado no requiere la hipótesis de que x tiene distribución elíptica bajo el modelo

central.

Fs^rf^^^^s^ric^t^ t^s^,^NC^^..^

4.

ESTIMADQRES DE REGRESfON CON INFLUENCIA ACOTADA

Estos estimadores fueron introducidos con el objeto de limitar la influencia

no solamente de outliers, sino también de puntos con alto /everag^e. En general,

son definidos implicitamente por la ecuación

1 ^ ^ r' (tk ) , (^ x. ^^ x.

n

'

'

s*

^

^

donde ^^ x ^^2 = x' ^ r' x y donde ^ es un estimador robusto de la matriz de covarianzas de x. La funci+án r^ (r, x} se supone: i) continua; ii} impar y no-decreciente en r; y iii) acotada, con sup r X r^ {r, x)= 1.

Todas las funciones ^ propuestas hasta ahora son de la forma

^ (r, x) = y! (rv(x)) w(x)

donde la función y^r es como las de los estimadores M de posición. Los estimadores de influencia acotada se obtienen escogíendo la función w o ia función v

con la prapiedad que sup w {x } ^( x^^ <^ o sup v (x ) ^^ x^(<^, Este es el caso

con los estirnadores propuestos por Mallows y por Andrews (ver Hill, 1977) que

tienen v (x )= 1 y w( x )= 1, respectivamente. Hill y Ryan (ver Hill, 1977) propusieron usar w{x )- v{x ), y finalmente Schweppe (ver Merril! y Schweppe, 1971 }

sugirió tomar v(x )= 1/ w(x ), con la idea de que los puntos con valores de (( x I I

grandes pero que satisfacen el modelo apropiadamente no vean su infiuencia limitada. Los estimadores propuestos por Huber (1973} tienen w(x )= v(x ) = 1, y

por lo tanto no tienen influencia acotada.

Estas estimadores son también Ilamados estimadores M generalizados (estimadores GM, usando las siglas en inglés} y se pueden calcular usando el método de Newton y Raphson. Antes de poder calcular estos estimadores, sin embargo, debemos

contar con estimadores robustos de á y de ^. La estimación ron

busta de ^ irnplica problemas nurnéricos muy serios que pueden resoiverse, al

menos aproximadarnente, usando métodos de re-muestreo similares a!os descritos en la sección anterior. ^a estimación de á, por otro lado, tiene que basar^

r;

{H)

y, por lo tanto, se requiere conse necesariamente en residuos estimados

^

tar con un estirnador robusto 8.

A diferencia de los estimadores de regresión descritos en la sección anterior,

la eficiencia de los estimadores GM depende de la distribución conjunta del vector de variables independientes x. Por ejemplo, estimadores ^M que en principio disfrutarian de una eficiencia del 95% cuando x tiene distribución normal

f:S"i'IMAC`1ON ROHI.'STA

^41

multivariante pueden resultar muy ineficientes si la distribución de x no es normal {ver Maronna, Bustos y Yahai, 1979). Notemos que mientras la hipótesis de

normalidad de los errores s^; bajo el modelo central puede parecer razonable, la

suposición de que x es normal multivariante bajo el modelo central puede ser injustificada en muchos casos.

Punta de Ruptura, Sensibilidad y Sesgo Máximo

A diferencia de los estimadores de regresión descritos en la sección anterior,

el punto de ruptura, la sensibilidad y la función de sesgo máximo de los estimadores GM depende de la dimensión del vector de variables independientes x

(ver Martin, Yohai y Zamar, 1989). A pesar de que, en general,

BGM (E) = ^^ ^ + O (E)

esto es, la función de sesgo máximo se comporta linealmente cerca de cero,

esta función (y el punto de ruptura) se deterioran rápidamente cuando la dimensión de x crece. Un punto de ruptura de 1/2 y un deteriora menor de la función

de sesgo máximo puede conseguirse calculando una sola etapa en el algoritrno

de Newton y Raphson, a partir de un estimador inicial 8 con punto de ruptura 1/2

y función de sesgo máximo de orden mayor o igual a 1/2 cerca de cero (ver

Simpson y Yohai, 1994). Estimadores GM calculados de esta forma han sido

propuestos recientemente por Simpson, Ruppert y Carroll (1992) y por Caakley

y Hettmansperger (1993).

5.

CALCULO DE LA FUNCION DE SESGO MAXIMO Y SUS DERIVADAS

En esta sección ilustraremos el cálculo de la función de sesgo máximo B{^)

en el caso sencillo del modelo de posición pura (dispersión conocida). También

mastraremos cómo se puede derivar el estimador M de posición con sesgo minimax e ilustraremos la derivación de aproximaciones lineales y cuadráticas para

B (E) .

Modelo de Posición Pura

Este es un modelo muy simple y será usado para ilustrar cómo obtener la

función B(^) y sus aproximaciones cerca de cero. EI modelo paramétrico central

está dado por

E^:S"iAUiS"1^IC`A f^Si'A!^f()1.r1

donde Fo está completamente especificada y es conocida (por ejemplo, F^ _

^ N (q,1)) y las observaciones Y,, ..., Y^ se supanen independientes e idénticamente distribuidas con distribucián F^^^.

Estimadores M

Los estimadores M de posíción fueron definidos por Huber (1964) como la

solución de la ecuación

dande yl es una función no decreciente, impar y acotada. Por ejemplo, la famosa función ^.^r de Huber:

si (y^<c

W H {Y ) = Y^

= signo (y } c,

si^yj>c

[^ 8]

donde c >_ Gl es una constante que puede tomarse igual a 1.345 si se desea una

eficiencia del 95% en el caso normal.

Sea

^^,(t, F) =-EF{yf(Y-t)}

[19]

Huber ( 1964, 1981) prueba que, si existe un único punto ^{F) tal que la función

^.^, (µ (F}, F} ! 0

entonces el estimadar M, µ„ = µ(F„ }, converge casi seguramente a µ(F}, esto es,

µ {Fn ) -^ ^ (F),

a.s. [F]

[2qj

Además, si ^,^, (t, F) es cont^inuamente diferenciable en un entorno de µ(F} y si

^.^, ( µ(F), F) ^ q, entonces µ(F^ ) es asintáticamente narmal con varianza asintótica

All(yf, F}=

EF { y^2 ( Y- µ (F)}}

^

[(d / dt) ^,^, ( µ (F), F)]2

{21 ]

ES'T'IMAC'IC.)l^ ROBUSTA

^4 ^

La función gw ( t)=^.^, ( t, Fo) juega un papel importante en el cálculo de B^, (^).

Usando la simetría de Fo y y, se verifica fácilmente que g^, (t ) es impar, estrictamente creciente y g^, (t) > 0 para todo t> o. Además,

^

9,^ ( t ) _ -EFo ^ ( Y - t ) _ --

^

lV (Y - t ) fo (Y ) dY

^

-0

4^(Y)[fo(Y-t)-fo(Y+t)^dY

donde [fo (y - t)- fo (y + t)] > O para todo par (y, t) con y> O y t> 0.

Sea F =(1 -^) Fo + E H. Por definición de µ( F),

^w(µ{F)^ F)=(1 -E)gW(µ(F))+E^,W(!^(F), H}=0

De aquí se sigue que

9',^(µ(F))=_`[^/(1 -E)^^^,(µ(F)^ H)=[^/(1 --E)^ EH^(Y--µ(F))

^[E/(1 -^)]E^,^(Y-µ(F))=[£l(1 -^)lV^(°°)

Usando la monotonía de g^, (t } concluimos que el sesgo máximo del estimador M

de posición con score yr,

B^, (E) = sup µ (F),

FE

f̀t.

satisface la ecuación

9',^ (B^, (E)) _ [E / (1 -- ^)] ^ (°^)

[22]

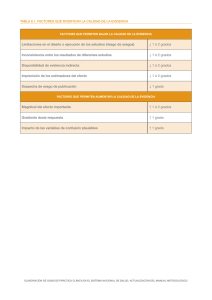

En la figura 1 presentamos las curvas de sesgo máximo de la mediana y del estimador de Huber con c= 1.345 y eficiencia del 95%. Observernos que la curva de

la mediana (línea Ilena) es uniformemente menor que la del estirnador de Huber (línea quebrada). En la sección siguiente se muestra que, en realidad, la mediana es

el estimador minimax de posición.

^4^

^STAE)tSTIC'A ^:SPA?^JC)LA

Figura 1

SESGO MAXIMO DE LA MEDIANA (iínea iiena) Y DEL ESTIMADOR DE HUBER

CON o - 1 .345 {línea quebrada)

2.5

2.0

1.0

^.5

fl.0

0.0

0.1

a.2

0.3

o.a

0.5

Epsilon

Estimador M de Posición de Sesgo Minimax

Supongamos, sin p^rdida de generaiidad, que ^ (^) = 1. Se deduce fácilmente

que si

9'^^. (t) ^ 9',^, (t),

d t>_ 0

8,^^ {E) <_ Bw2{E}

b' ^ >_ 0

entonces

Puesto que la función de score de la mediana es y^Med;a» ( t)= signo ( t) se sigue

inmediatamente que (usando que [fo (y- t)

gw ( t ) ^ g`^,^^;^^ (

- fo (y +

t}] ? 0}

t ) _ ^ _ [ ta (Y - t ) -- fo (Y + t ) ] dy = 2 Fo { t } -- 1

Por lo tanto,

B^ (£^ C ^^Median

^ ^ ^ O

(^^

ES"T'IMA(^'IC}N ROBl`STA

^45

y la mediana minimiza el sesgo máximo (es minimax) en la clase de los M-estimadores de posición.

Usando un método de prueba muy ingenioso (que no requiere el cálculo de

las funciones de sesgo máximo), Huber (1964) obtuvo un resultado aún más general: la mediana es minimax en la clase de todos los estimadores de posición T

que tienen !a propiedad

T(Y^ +b, ..., Y^+b)= T(Y^, ..., Y^)+b

Desafortunadamente, el método de Huber no se puede aplicar a otros modelos uniparamétricos (por ejernplo, escala o dispersión) ni multipararnétricos

corno posición multivariante y regresión. Sin embargo, el método de prueba descrito aquí sí puede aplicarse con éxito en otros modelos uniparamétricos y multiparamétricos. Ver, por ejemplo, Martin y Zamar (1989, 1993a y 1993b) y Martin,

Yohai y Zamar (1989).

Sensibilidad a Contaminaciones y Aproxirnaciones de Segundo orden

Naturalmente, la función de sesgo máxirno B^, (^) puede aproximarse cerca

de cero usando, por ejemplo, una expansión de Taylor de segundo orden:

2

B^ (E) = Y; (W) £ + ^2 (^) ^ + o (E2)

2

Observando que g^, (t )_

^

^

[23^

^r (y ) fo ( y+ t) dy , se obtiene

^

9w(^)_

^

^ {Y ) f^ (Y ) dY

Y

^

9'';^ (^) =

^

^ (Y ) f^' (Y ) dy = 0

Diferenciando dos veces los dos lados de [23] con respecto a^ y poniendo ^= o,

obtenemos

0

9;^(^)

r:s^rA[^is^ric^A ^-.^^Ar^c^t.a

Y

Y^ _ !g W (p ) _

9W (0)

Por lo tanta, ^23] puede escribirse com©

^

Bw tE} _ ^ ^

^ ^

^ ^ tY ) fo

£ ^ ^ + £) + Q ^£ 2)

(Y ) dY

EI factor

^ 4^ (Y } f© (Y ) dY

se obtiene también como resultado dei siguiente procedimiento: primero se ca!cula e1 iimite

lF(y, yf) = lim

E--^o

,bµ({1 -£) Fo+^Sy)

£

(donde Sy es una contaminación de masa uno en y} y luegc^ se calcula el supremo

^

n

y* (8) = sup iF (y, 9)

Y

Hampel (1968) conjeturá que

Be(£}^y*£

Noternos que debido al orden en que ei f imite y ei supremo se aplican en e1

cáiculo de y*, en general,

Aunque no existe una prueba formal de este hecho, y* _^y1 en todas los casas

en que B^, (^) es aproximadamente lineal cerca de cero, esto es, cuanda

8,^ (^) = C ^ + o {^)

E:STIMAC'1ON kOHUS'TA

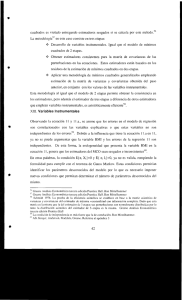

En la figura 2 comparamos las aproximaciones lineat (línea de puntos) y cuadrática ( línea quebrada) en el caso del estirnador de Huber con c= 1.345. Observamos que la aproximación lineal

B,^(^) -

c

2^^ (c)-1

^

es ampliamente superada por la aproximacián cuadrática

B (E) ^

`^

c

2^(c)-1

^ (1 + ^)

También notamos que la aproximación cuadrática es muy buena para valores

de ^ menores que .20.

Figura 2

APROXIMACION LINEAL ( línea de puntos) Y CUADRATICA (línea quebrada)

A LA FUNCION DE SESGO MAXIMO (línea Ilena)

5

4

3

2

1

0

0.0

0.1

0.2

0.3

Epsilon

0.4

0.5

E^S'TAUIS`T'1C`A E5F'A!VC)I.A

fi.

COMENTARIt^S FINALES

Aunque ya han transcurrido treinta años desde el inicio de fa teoria cuantitativa de robustez can el trabajo pionero de Huber (1964), esta teoría no está

completada, ni mucho menos. Las curvas de sesgo máximo de estimadores robustos de regresión aún no se conocen en la mayoría de los casos irnpartantes

(por ejemplo, en el caso de los estimadores MM y T). En los pocos casos en que

esta curva se conoce (estimadores S y estimadores GM) las resultados son parcialmente satisfactorios, puesta que sólo valen bajo condiciones restrictivas. En

el caso de los estimadares S debe asumirse que la distribución conjunta de las

variables independientes es esférica. En el caso de los estimadores GM debe

asumirse, adem^s, que la dispersián de los residuos y que la matriz de covarianzas de las variables independientes son conocidas. La función de sesgo máximo de estimadares robustos de la ordenada al Origen no se conoce aún en

.

ningun caso.

C7tra cuestión importante es que la curva de sesgo máximo captura sbio uno

de los dos aspectos irnportantes del concepto de robustez, el de la estabilidad.

EI otro aspecto importante es el de la eficiencia bajo el modelo y en sus inmediaciones. Desde ese punto de vista, la teoría de sesgo minimax sin condiciones

laterales de eficiencia está incompleta. Puede considerarse como una teoría de

estabilidad pero no como una teoría global de robustez.

•

REFERENCIAS

. (1993): «A bounded influence, h'rgh

breakdown, efficient regression estimator», J. Amer. Statist. Assoc., 88, 872880.

CC}AKLEY, W. C., y HETTMANSPERGER, T. P

HAMPEL, F. R. {1968): «Contributions to the theory of robust estimation», Ph. D.

thesis, University of Galifornia, Berkeley.

(1971 }: «A general qualitative definition of robustness», Ann. Math. Statist.,

42, 1$87- ^1896.

(1974): «The influence curve and its role in robust estimation», J. Amer.

Statist. Asscac., 69, 383-393.

Hi^^, R. W. (1977): «Robust regression when there are outliers in the carriers»,

Unpublished Ph. D. dissertation, Harvard University, Dept. of Statistics.

E^STIMAt'ION R(:)Bl.!STA

i49

HUBER, P. J. (1964}: «Robust estirnation of a location parameter», Ann. Math.

Statist., 35, 73-101.

-- (1973) :«Robust regression: Asymptotics, conjectures and Monte Carlo»,

Ann. Statist., 1, 799-821.

-- (1981) : Robust Statistics, Wiley, New York.

LI, B., y ZAMAR, R. H. (1991): «Min-max asymptotic variance when scale is unknown» , Statist. and Probability Letters, 11, 139-145.

R. A. (1981): «Robust M-estimators of multivariate location and scatter», Ann. Statist., 4, 51-67.

MARONNA ,

MARONNA, R. A.; BusTOS, o. H.., y YoHAI, V. J. (1979): «Bias- and efficiencyrobustness of general M-estimators for regression with random carriers», en

T. Gasser y M. Rosemblat (eds.), Smoothing Techniques for Curve Estimation, Springer-Verlag, New York.

MARTIN ,

R. D.; YoHAI, V. J. , y ZAMAR , R. H. (1989): «Min-max bias robust regression», Ann. Statíst., 4, 1608-1630.

MARTIN, R. D., y ZAMAR, R. H. (1989): «Asymptotically min-max bias-robust M-estimates for positive random variables», J. Am. Statist. Assoc., 17, 494-501.

-- (1993a): «Efficiency-constrained bias-robust estimates of location», Ann.

Statist., 1, 338-354.

(1993b): «Bias-robust estimates of scale», Ann. Statist., 2, 991-1017.

MERRILL ,

H. M.,

y SCHWEPPE ,

F. C. (1971): «Bad data supression in power sys-

tem static state estimation», IEEE Trans. Power App. Syst., PAS-90, 27182725.

RoussEEUw, P. (1984): «Least median of squares regression», J. Am. Statist.

Assoc., 79, 871-880.

RoussEEUw, P., y LEROY, A. M. (1987): Robust regression and outlier detection,

Wiley, New York.

RoussEEUw, P., y YoHAI, V. J. (1984): «Robust regression by means S-estimators», en J. Franke, W. Hardle y R. D. Martin (eds.), Robust and Nonlinear

Time Series Analysis. Lectures Notes in Statistics, 26, Springer, New York,

256-272.

SIMPSON, D. G.; RUPPERT, D., y CARROLL, R. J

. (1992): « On one-step GM estima-

tes and stability of inferences in linear regression», J. Am. Statist. Assoc.,

87, 439-450.

SIMPSaN, D. G., y YoHAI, V. J. (1993): «Functional stability of one-step GM estimators in linear regression». Unpublished manuscript.

F^sr^[^is^r^c^A FsPAÑC^^.A

^5()

YoHA^, V. J. {1987): « High breakdown point and high efficiency robust estimates

for regression», Ann. Statist., 15, 642-656.

YOHAI, V. J., y MARC}NNA ,

R. A. (1979) : «Asymptotic behavior of M-estimators for

the linear model», Ann. Statist., 7, 258-268.

YOHAI, V. J., y ZAMAR ,

R. H. (1988): «High breakdown point estimates of regres-

sion by means of the minimization of an efficient scale», J. Amer. Statist.

Assoc., 83, 406-414.

(1992}: «Optimally bounding the gross error sensitivity of unbounded influence M-estimates of regression», Tech. Rep. 92-44, Departamento de Estadistica y Econometría, Uníversidad Carlos 111, Madrid.

(1993}: t^A minirnax property af the least a-quantile estimates», Ann. Statíst.,

21 , 1824-1842.

^AnnaR, R. H. {1992): «Bias robust estimation in orthogonal regressian», Ann. of

Statist., 4, 1875-1888,

R4BUST ESTIMATION

SUMMARY

The present paper presents some recent approaches of the robust estimation theory, in particular the results in the area of maximum bias minimization. A description is made of some regression robust estimators and the definition of maximum bias curve is introduced, The relation between thís curve and the sensítivity to gross

errors is discussed. These concepts are explained in the case of

simple position and dispersion models.

Key Words: minimax estirnators, maxirnum bias, sensitivity to pollutíons.

AMS Classificati©n: 62Jxx, 62H 12.

^^.5'fIMA('IOti ROBl SIA

CO MENTARIO S

ANTONIO CUEVAS

Universidad Autánoma de Madrid

La teoría de la robustez ha conocido, al igual que otras muchas disciplinas

científicas, una época de auge seguida de un período de relativo estancarniento

que, con una visión positiva, podría considerarse como una crisis de madurez.

En la actualidad, la teoría y la práctica de la estadística robusta se desarrollan a

un buen ritmo.

Los trabajos de Rubén Zamar sobre sesgo minimax son un buen exponente

de esta recuperación.

Es un honor para Estadistica Española contar con un artículo invitado de

este autor, componente destacado de la excelente escuela argentina de estadística robusta creada en torno a Víctor Yohai (Graciela Boente, Oscar Bustos,

Nélida Ferretti, Ricardo Fraiman, Ricardo Maronna...).

Mi comentario está, inevitablemente, sesgado por mi experiencia personal

sobre el tema y se dirige hacia la fundamentación maternática de los conceptos

de robustez, con mayor énfasis en algunas ideas que rne parecen especialrnente atractivas. Me interesa también destacar las relacianes de la estadística robusta con otros campos de la investigación estadística o maternática, ya que, en

mi opinión, el valor de una teoría está muy relacionado con su capacidad para

«salir de sí misma» e interaccionar con otros temas.

En beneficio de una mayor claridad dividiré mi discusión en apartados.

1.

Funcionales estadisticos

^os desarrollos teóricos en estadística robusta han contribuido a popularizar

entre los investigadores la noción de estimador considerado como restricción de

F.^r.•>t^iti^ic^r^ ^^.^t}}^,!^t>i.f^

un funcional (definido sobre el espacio de funciones de distribución) al conjunto

de las distribuciones empiricas. Esta idea no es nueva, ya que está implícita en

la noción de consistencia propuesta por Fisher en los años veinte (y mencionada por ^amar en la introducción del artículo}; sus implicaciones estadisticas se

desarrallan con detalle por primera vez en el clásico trabajo de von Mises

(1947). Sin embargo, la explotación sistemática de este atractiva «enfoque funcional^^ no se ha generalizado hasta los años setenta, coincidiendo con el desarrollo de la estadística robusta. Así, la manera natural de definir y estudiar los Ly los M-estimadores es mediante funcionales estadísticos. Las propiedades de

difPrenciabilidad de estos funcionales prop©rcionan una metodologia general

para estudiar la distribución asintótica de los estimadores asociadas [ver, por

ejemplo, Fernholz (1983}]. EI aspecto que me interesa destacar aquí es, no obstante, que la metodología basada en la diferenciación de funcionales ha demostrado ser útil en otros desarrollos estadisticos, no directamente vincufados a la

robustez; por ejemplo, el trabajo de Parr (1985) proporciona una ele+gante y sencilla aplicación al estudio de las condiciones de validez asintótica del bootstrap.

Gill (1989) utiliza métodos de diferenciación funcional en estimación no paramétrica y, en particular, extiende a este cantexto el clásico «método delta» para

obtener distribuciones asintóticas de estimadores.

2.

Robustez cualitativa

Rubén Zamar menciona este concepto de manera muy esquemática, ya que

está quizá un poco apartado de su linea expositiva general. Por mi parte, sólo

quiero cornpletar y matizar con brevedad su comentario.

Como señala ^amar, en el caso de las estirnadares generados por un funcional, la continuidad de éste es la condición suficiente natural para ia robustez cuaiitativa. Esto se sitúa en la linea, comentada en el punto anterior, de traducción estadistica de propiedades analiticas del funcional. Un paso más en esta dirección puede encontrarse en Cuevas y Ramo (1993}, donde se demuestra que la continuidad

uniforme (respecto a la distancia bounded Lipschitz) es una condición suficiente

para la robustez cualitativa de ias aproximaciones bootstrap a la distribución en el

muestreo: se trata, por tanto, de una aplicación na pararnétrica del concepto. En

este mismo trabajo pueden encontrarse algunas referencias interesantes sobre

otras extensiones de la noción de robustez cualitativa. Por ejernplo, Boente et al.

(1987) estudian la robustez cualitativa en el caso de observaciones dependientes.

Respecto al significado de la robustez cualitativa, Huber (1981, p. 10) señala

que, desde un punto de vista matemático, este concepto impone un requerimiento de continuidad análogo a la noción de estabilidad en un sistema controlado par una ecuación difereneiai ordinaria. Se trata, por tanto, de una idea básica muy arraigada en diferentes contextos.

F:ST'11^1A('IOti KC)F3l1S.i_•i

^5 i

A propósito del comentario de Zamar «... esta teoría (...) no permite comparaciones dentro de la clase de estimadores que son cualitativamente robustos»,

quisiera matizar que, en cierto modo, el punto de ruptura [ver, por ejemplo, Huber (1981)] es una noción complernentaria que cumple la función de cuantificar

la robustez. EI punto de ruptura es, en términos intuitivos, !a máxima cantidad

de contaminación en la distribución subyacente que puede tolerar un estimador

de manera que todavía proporcione alguna información sobre el parámetro de

interés. Creo que este concepto no ha sido aún estudiado con la profundidad

que merece. Hay varias cuestiones, como la definición de aproximaciones

rnuestrales satisfactorias o la extensión a diferentes contextas (incluyendo la inferencia bayesiana), que son aún, básicamente, problemas abiertos.

3.

La curva de influencia

Este es, sin duda, uno de los conceptos más populares y fecundos dentro de

la teoría de la robustez. De hecho, es el eje central del libro de Hampel et al.

(1987) sobre estadística robusta. ^as observaciones que siguen pretenden simplemente completar los comentarios de Rubén Zamar sobre el tema.

Desde el punto de vista matemático, la función de influencia es para un funcional estadístico lo que el vector gradiente es para una función real de n variables. La función de influencia proporciona el término lineal de los desarrollos de

Taylor de primer orden [ver Fernholz {1983)] que permiten probar la normalidad

asintótica para los estimadores definidos como restricción de un funcional diferenciable. Coma consecuencia, la varianza asintótíca aparece en estos casos

como la media del cuadrado de la función de influencia. Este hecho puede utilizarse para estimar la varianza asintótica, supuesto que se dispone de un estimador adecuado de la curva de influencia. EI estimador más popular es la así

Ilamada curva de sensibilidad. Curiosamente, el estudio de sus propiedades

asintóticas permanece casi inédito; una referencia reciente sobre este tema es

Cuevas y Romo (1995).

Recordemos, por último, que la curva de influencia tiene una interesante relación con el método de remuestreo denominado jackknife [ver Efron (1992)]; en

particular, se puede obtener una aproximación muestral de la curva de influencia como subproducto de los cálculos necesarios para obtener la versión jackknife de un estimador.

4.

Estirnadores de mínima distancia

Los ejemplos presentados en el artículo se centran en modelos de posición/escala y regresión. En este tipo de modelos los estimadores considerados

E^^.:4^I ^1[)f:^^t^l(^.^ ^-.S(',^\ti'O1^,^

{principalrnente los de tipo M) ocupan, sin duda, un papel protaganista. Hay, sin

embargo, otras situacianes (por ejemplo, Ios modelos paramétricos de mixturas)

en que resulta útil considerar !os estimadores Ilarrtados «de mínima distancia»

que, bajo condiciones bastante amplias, son robustos. EI trabajo de Parr y

Schucany (1980) es una referer^cia clásica sobre el tema.

La forma general de estos estimadores es:

^

8„ = argmin ó (F,,, F^),

donde F^ es la distribución empírica, F^ es el modelo teórico y S es una medida

de discrepancia (no necesariamente una métrica) entre funciones de distribu-

ción

Una idea bastante natural {aunque, sorprendentemente, no estudiada hasta

ahora) es considerar una versión «suavizada» de la anterior definición en la que

FH es reemplazada par la densidad f^ (cuando esto tenga sentido} y F^ se reemplaza por un estimador no paramétrico (de tipo núcleo, por ejemplo) de fe. La

discrepancia b se cambiaría entonces por una distancia natural (por ejemplo, L^

o L2) entre densidades. En Cao et a!. (1995) se analizan algunas aspectos teóricos (consistencia, normalidad asintótica, robustez) y prác#icos (comparaciones

por simulación} de esta modalidad de estimadores de mínima distancia. Los resultados son, en general, bastante alentadores.

Comentario final: un asunto de relaciones púbiicas

Ctuisiera concluir estas líneas con una reflexión acerca de un asunto que tiene, según creo, cierta importancia práctica: la creciente disponibilidad de medios computacionales baratos y eficientes ha estimulado la aparición de una amplia demanda de análisis estadísticos por parte de un público usuario formado

mayoritariamente por no profesionales de la estadística. Este público, a su vez,

contribuye a orientar la investigación planteando sus propias demandas, na

siempre fáciles de satisfacer. Una consecuencia de este hecho es que cualquier

teoría estadística que no consiga, en alguna medida razonable, comunicarse

can los usuarios y«vender su producto» está condenada a mantenerse en el

g^hetta de las revistas especializadas y, quizá, a desaparecer. No creo que ésta

sea exactamente la situación de la estadística robusta, pero sí considero que

los expertvs en este tema han tenido mucho más éxito en la elaboración de una

teoría sólida y elegante que en facilitar su acceso al público usuario. Por ejemplo: hay actualmente centenares de estimadores robustos exhaustivamente estudiados en diferentes contextos, pero los especialistas no parecen ponerse de

acuerdo en seleccionar un reducido número de ellos para su implementación en

!os paquetes estadísticos más usuales. Hay, asimismo, algunos conceptos

t:ti'1'Iti1A(^1Oti ROfil'^"^ A

^55

como el de punto de ruptura o el de curva de influencia que tienen una gran potencialidad desde el punto de vista aplicado: una vez más, su popularización dependería de su presencia en el software comercial. Se trata, en último términ©,

de un problema de divulgación que, por otra parte, no es exclusivo de la estadística robusta.

Estoy convencido de que un investigador de la categoría de Rubén Zamar

puede hacer aportaciones muy interesantes en este sentído.

REFERENCIAS

Qualitative robustness for stochastic processes», Ann. Statist., 15, 1293-1312.

BOENTE, G.; FRAIMAN, R., y YOHAI, V. (1987): «

CAO, R.; GUEVAS, A., y FRAIMAN, R. (1995}: <tMinimum distance density-based estimation^>, Comp. Statist. & Data Analysis (en prensa).

CuEVAs, A., y RoMO, J. (1993): «pn robustness properties of bootstrap approx'rmations» , J. Statist. P/ann. lnference, 37, 181-191.

-(1995): «On the estimation af influence curve», Canadian J. Statist. (en prensa).

EFRON, B. {1992): «Jackknife-after-bootstrap standard errors and influence functions» , J. R. Statist. Soc. B, 54, 1, 83-127.

FERNHOLZ, L. T. (1983): Von Mises Calculus for Statistical Functionals, SpringerVerlag, New York.

GILL, R. D. (1989): «Non- and semi-parametric maximum líkelihood estimators

and #he von Mises method (Part I}», Scand. J. Statist., 16, 97-128.

HAMPEL, F. R. (1971): «A general qualitative definition of robustness», Ann.

Math. Stat., 42, 1887-1996.

I-iAMPEL, F. R.; RONCHETTI, E. M.; ROUSSEEUW, P. J., y STAHEL, W. A. (^ 987):

RO-

bust Statistics. The Approach Based on /nf/uence Functions, Wiley, New

York.

HusER, P. J. (1981) : Robust Statístics, Wiley, New York.

MIsES, R. von (1947): «On the asymptotic dístributions of differentiable statistical

functions», Ann. Math. Statist., 18, 309-348.

PARR, W. C. (1985): «The bootstrap: some sample theory and connectíons with

robustness» , Stat. Prob. Letters, 3, 97-100.

PARR, W. C., y SCHUCANY, W. R. (1980): «Mínimum distance and robust estimation», J. Amer. Statist. Assoc., 75, 616-624.

^^ ^ E^

F-.^^r ,tii^r^^rrc^ ^^ r-tir^,^^^v^,r.^^

ALFCrNSO GOF^UALIZA

Universidad de Valladolid

Quisiera comenzar expresando mi reconocimiento al profesor Zamar por las

importantes aportaciones realizadas en ios últimos años al campo de la estimación robusta, de las cuales una pequeña muestra es objeto de estudio y discusión en la parte f'rnal de este artículo.

EI trabajo se estructura en tres partes. Una primera parte (secciones 1 y 2)

donde, de una manera sencilla y clara, se hace una introducción a la teoría de

la estimación robusta, presentando las diferentes teorías existentes e incidiendo, sobre todo, en el compromiso estabilidad-eficiencia que representa y en las

ideas de invariancia presentes en todo problema de estimación. Este tipo de introducciones pueden contribuir a paliar la escasez de referencias a la robustez

en los textos básicos, donde cada vez se hace más necesario introducir algunas

nociones como hace, por ejemplo, Peña (1991), con las limitaciones lógicas derivadas del tipo de lector a quien va dirigido.

La segunda parte (secciones 3 y^4) presenta, de una manera escalonada y

motivada, una serie de familias de es#imadores que están mostrando un mejor

comportamiento en el intento de extender las ideas de robustez al contexto de

regresión y estimación multivariante. Esta parte tiene, sobre todo, el mérito de

ayudar a los recién incorporados al estudio de la robustez a conducirse entre

una verdadera maraña de siglas.

En la tercera parte (sección 5} es donde realmente se discuten recientes enfoques de la teoría de la estimación robusta, como se anuncia en el aóstract.

Mis comentarios se centrarán especialmente en esa parte del artículo.

Como los artícuios invitados que publica Estadística Españo/a tienen un carácter eminentemente divulgativo y, en consecuencia, parte de sus lectores probablemente no serán grandes conocedores del desarrollo de la teoría de la estimación robusta, comenzaré haciendo un breve recordatorio de las fases por las

que ha pasado dicho desarrollo que, de alguna manera, será el hilo conductor

de mis comentarios.

EI desarrollo de la teoría de la estimación robusta está marcado, a mi juicio, por los importantes .altibajos que ha experimentado. P. H. Huber (1981)

recoge muy bien en el prólogo de su libro la desconfianza inicial por parte de

la comunidad de estadisticos teóricos hasta que Ilegó el reconocimiento {años

65-75}, gracias, sobre todo, a las aportaciones de Huber (19f4) y Hampel

F:^"I^IMA('It)N R()K('tiTA

(1968, 1971, 1974), y el posterior intento de «subirse al carro de la robustez»

de buena parte de los estadísticos. La descon#ianza inicial se debió a la escasa seriedad que, desde el punto de vista maternático, parecían ofrecer las alternativas robustas, y por ahí, precisamente, Ilegó e! reconocimiento, gracias

al esfuerzo de Huber y Hampel por dar #orma matemática a las ideas de robustez, especialmente en el contexto de localización univariante. Se habían

dado los primeros pasos, pero quedaba todo el camino por recorrer: sustituir

los abundantes resultados heurísticos por teoremas, conectar rigurosamente

las distintas teorías, extender las ideas a otros contextos (regresión, estirnación multivariante...), etc.

Lamentablemente, la subida masiva de estadísticos al «carro de la robustez»

no se tradujo, salvo excepciones, en avances significativos en Ios aspectos

mencionados, sino que, más bien al contrario, se produjo una desviacíón ^^peiigrosa» hacia el análisís de datos (las publicacianes sobre robustez desaparecen

prácticamente de Annals of Statistics} sin un avance paralelo de la vertiente estadístico-matemática de los problernas, lo que vuelve a suscitar recelos en la

comunidad de matemáticos estadísticos.

Afortunadamente, en los últimos años ha vuelto a cobrar importancia el desarrollo estadístico-matemático de la Estadística Robusta, produciéndose notables avances. Entre los más relevantes están los conseguidos en la línea de

trabajo a la que pertenece el profesor Zamar, y la sección 5 de este artículo

muestra una pequeña pincelada de sus logros. Esta línea de trabajo reabre el

problema de la medición de la robustez de estimadores a partir de la curva de

sesgo máximo y la obtención de estimadores de sesgo minimax. Estos problemas estuvieron abandonados durante veinte años, a raíz de que Huber desestimara el probfema del sesgo máximo en favor del de la varianza por considerar este último como un problema más profundo. Huber resalvió el problema

del sesgo minimax en localización univariante con una demostración ingeniosa y brilfante pero basada en argumentaciones geométricas que no permiten

una extrapolación a otros contextos. Además, coma !a solucián era siempre la

mediana (para distintos tipos de entornos y para cualquier radio), Huber consideró camo t<aburrido» el problema del sesgo máximo y se pasó a utilizar simplemente un «resurnen grosero» de fa curva de sesgo máximo como es el

punto de ruptura asintótico, que tiene su antecedente en la noción análoga introducida por Hampel (1968, 1971). Incluso se establecen versiones muestrales de dicha noción, cuyas conexíones con las nociones poblacionaies nunca

se establecen de manera rigurosa y cuya utilidad real queda bas#an#e en entredicho a raíz de algunas publicaciones como, por ejemplo, la de Hettmansperger y Sheater (1992).

^5x

E-:s r.^r^r^ i rc^.> E-.:^r^,>tic^i.,^

EI método alternativo para tratar el problema del sesgo máximo que se recoge en este artículo, tiene la doble ventaja de ser extensible a otros conceptos y

de arrojar alguna luz sobre las relaciones entre las teorías minimax e infinitesimaí, por medio de la derivada de la curva de sesgo máximo y el supremo de la

función de influencia.

Existen otros enfoques, igualmente actuales, en la teoría de la estimación robusta, y se echa de menos siquiera una referencia a los misrnos en este artículo. Me refiero especialmente al artículo de Davies (1993) en ef que se defienden

posiciones de alguna manera encontradas con la línea de trabajo minimax que

se discute en este artículo y se ofrecen vías alternativas. EI articulo de Davies

contiene, entre otras cosas, notas críticas sobre robustez y optimalidad, sobre el

uso de métricas y entornos de contaminación y sobre las distintas nociones de

punto de ruptura. Davies defiende que ia estabilidad de la inferencia no se consigue obteniendo funcionales óptimos sino construyendo funcionaies con propiedades especificadas. También defiende que los estimadores óptimos son fronteras que delimitan la posible y no son utilizables para aplicaciones a datos reales, donde la único razonable es utilizar estirnadores que sean un compromiso.

Asimismo critica ios entornos de contaminación por violar el espí ritu de la robustez y, en su lugar, aboga por el uso de métricas, lo que también serviria para reconducir a sus orígenes la noción de punto de ruptura. Davies hace propuestas

de estimadores de dispersión y de regresión en la línea de «estimadores compromiso» mencionada anteriormente.

Es de reseñar, no obstante, que las críticas a la teoría minimax no son del

todo nuevas, como puede verse, por ejemplo, en Huber (1972) o en Hampel,

Ronchetti, Rousseeuw, Stahel (1986}.

REFERENCIAS

DaviES, P. L. (1993}: «Aspects of Robust Linear Regression», Ann. Statist., 21 ,

4, 1843-1899.

HAMPE^, F. R. (1968}: Contributions to the theory of robust estimation, Ph. D.

Thesis, University of California, Berkeley.

(1971 }: «A general qualitative definition of robustness», Ann. Math. Statist.,

42, 1887-1896.

(1974): «The influence curve and its role in robust estimation», J. Am. Statist.

Assoc., 69, 383-393.

F:ST'1ti1AC'1c)N R()E3l'STA

HAMPEL, F. R.; RONCHETTI, E. M.; ROUSSEEUW, P. J., y STAHEL, W. A. (1986): RO-

bust Statistics: The approach based on inf/uence functions, Wiley, New York.

HETTMANSPERGER, T. P., y SHEATHER, S. J

. (1992): ^<A cautionary note On the

method of least median of squares» , Americ. Statist., 46, 79-83.

HUBER, P. J. (1964): «Robust estimation of a location parameters^, Ann. Math.

Statist., 35, 73-101.

-(1972}: «Robust Statistics: A review», Ann. Math. Statist., 43, 1041-1067.

-(1981): Robust Statistics, Wiley, New York.

PEÑA ,

D.(1991) : Estadística. Modelos y rnétodos, vol . I, 2. ^ ed .

JULIAN DE LA HORRA

Universidad Autónoma de Madrid

Para mí es un placer esta oportunidad que me brinda Estadística Española

de poder contribuir con algunos comentarios al trabajo del profesor Zamar

sobre Estirnación Robusta, que me ha parecido interesante por muchas conceptos.

EI trabajo del profesor Zamar se centra, particularmente, en resultados sobre

minimización del sesgo máximo. Es decir, estudia el problema que se plantea

cuando se trata de encontrar un estimador que <tminimice» el «rnáximo» sesgo

asintótico, lo cual es una aplicación del principio «minimax». Mi aportación irá

dirigida a señalar la interesante aplicación que tiene también el principio t<minimax» en robustez bayesiana. Entre los dos enfoques hay semejanzas y diferencias que se pondrán de manifiesto a continuación.

Wasserman (1989) estudió el problema que se plantea cuando se quiere encontrar una región de confianza bayesiana y se tiene cierta incertidumbre sobre

la distribución a priori; en concreto, se considera como clase de distribuciones a

príori la clase de ^-contaminación alrededor de una distribución a priori central.

Obsérvese que aquí la falta de seguridad radica en la distribución a priori (no en

el modelo de muestreo), pero se formaliza de rnanera análoga (a través de !a

clase de ^-contaminación}. Una diferencia adicional es que Wasserman no tra-

^6C }

E^S^i AU1tiT1C'A E`iF'Ati()l.A

baja con estimadores puntuales, sino con regiones de confianza; en concreto,

considera la clase de regiones de confianza que tienen un contenido de probabifidad a posteriari (calculado a partir de la distribución a priori central} fijo {digamos Y,^).

EI objetivo de Wasserman es encontrar la región de confianza (dentro de la

clase indicada} que «minimiza» la «máxima» diferencia posible de contenido de

probabilidad a pQSteriorí (cuando la a priorí recorre fa citada clase de ^-contaminación). C}bsérvese el parafelismo con buscar el estimador que «minimice» el

«máxima» sesgo asintótico.

Señalemos, para acabar, que Wasserman prueba que la región buscada es

la región de máxima verosimilitud.

Este tipo de estudios ha sido continuado en De fa Horra y Fernán+dez

(1994a}, donde se consideran otras clases de regiones de confianza. En primer

lugar, se considera el conjunto de regianes de confianza con un contenido de

probabilídad a posteriori entre dos valores fiijados, pasando después a analizar

fa clase que parece más natural: {a que incluye aquellas regiones de confianza

con un contenido de probabifidad a posteriori superior a un valor ^yo y con una

medida de Lebesgue inferior a un valor lo. Pero el objetivo es siempre el mismo:

«minimizar» la «máxima» diferencia posible de contenido de probabilidad a pvsteríori. La solución a estos problemas siempre está ligada a la nocián de región

de máxima verosimilitud.

Posteriormente, en De la Horra y Fernández (1994b) se estudian estos problemas en relacián con la existencia de parámetros perturbadores.

Espero que estos comentarios hayan servido para poner de manifiesto las

semejanzas que a veces hay entre enfoques originalmente muy diferentes.

REFERENCIAS EIV LA DISCUSION

C. (1994a): «Bayesian analysis under s✓ -contaminated priors: A trade-off between rabustness and precision», J. Statist. Plan.

DE LA HORRA, J., y FERNÁNDEZ ,

lnf., 38, 13-30.

(1994b}: «Bayesian robustness of credibfe regions in the presence of nuisance parameters» , Commun. Statist. -Theory Meth., 23, 689-699.

WASSERMAN, L. {1989) :«A robust Bayesian interpretation of likelihood regions»,

Ann. Statist., 17, 1387-1393.

EST'IMAC'It)N ROHl'S"I^A

ALFONS^ GARCIA PEREZ

Departamento de Estadística

Facultad de Ciencias. UNED

EI trabajo del profesor Zamar recoge, de forma acertada, algunas líneas de

análisis de la robustez de estimadores por punto T„ que dependen de la muestra a través de la distribución empírica F„ = 1/ n^;'` , bX; ; es decir, que pueden

ser expresados de la forma T^ = T(F„ ), con T algún funcional cuyo dominio no

sólo es el espacio de las medidas empíricas, sino que, de forrna habitual, suele

extenderse a(un subconjunto de) el espacio ^(X ) de todas las medidas de

probabilidad definidas sobre el espacio muestral X.

De las líneas de análisis tratadas, el autor centra su trabajo, fundamentalmente, en la desarrollada por él y los profesores Martin y Yohai, la cual utiliza

como medida de la robustez de un estimador, básicamente, la función de sesgo

máximo,

BT (€) = sup d [ T ((1 - €) Fe + € H ), T (FA )]

H

= sup d [ T( G), 9^

G E iF

en donde

^^(Fe)={G^G=(1 -€) F^+€H, HE ^(X)}

es un «entorno» en el modefo de contaminación.

Con dicha función de sesgo máximo, BT (€), generalización de la definida por

Huber ( 1964), es posible analizar el va/or asintótico del estimador T(F„ }, en

función de la cantidad de contaminación fijada, €, permitiendo además interesantes representaciones gráficas, como la figura 2 del autor ( donde, por cierto,

cabe mencionar que la asíntota vertical corresponde al punto de ruptura €*).

Como bien dice el autor, habitualmente, esta función puede aproximarse linealmente cerca de cero de la forma

BT(€)=y*(T)•€+o(€)^y*{T)•€

siendo

y*(T)=sup^^/F(x; T)II

X

la sensibilidad a grandes errores definida por Hampel (1974).

C^:^`f A[)ISI'tC'A f-.5F':;ti()F_:^

No obstante, el análisis de un estimador debe basarse no sólo en un estudio

de su sesgo (asintótico}, sino también de su varianza (asintótica), V( T, F^ }. Parece, por tanto, razonable d+efinir una función de varianza máxíma que fuera del

tipo

VT (^) = sup d [ V( T, G}, V( T, FQ }^

G E '^^

En esta situación, sería razonable tratar de determinar también el ó ptimo en

el sentido minimax. Pero, probablemente, io más interesante, en línea con el

trabajo del autor aqu í comentado, fuera aproximar linealmente dicha funcitín de

varianza máxima

mejor dicho, su logaritmo

por la sensibilidad al cambio-devarianza k*{ T)= k*( T, F^ ), concepto i ntroducido por Peter Rousseeuw (1981)

en su tesis doctoral y más tarde generalizado por Collins (1976, 1977} y Collins

y Portnoy ( 1981).

Si esta idea #uera viable, permitiría, posiblemente, una aproximación del tipo

VT (E} ^ V ( T, FH ) • exp {^ • k * ( T, F,^ )}

es decir, que, en analogía con la aproximación a la función de sesgo máximo,

fuera k* ( T) la pendiente de la tangente en cero, ahora de la función In VT {^),

función ésta que probablemente deberia tener una asíntota vertical en el, (Huber, 1981 }, punto de ruptura +de fa varianza (asíntótica), ^**.

En esta situación, entiendo que también sería viable una aproximación cuadrática a la función de varianza máxima, corno la que hace el profesor Zamar en

su artículo con función de sesgo máximo.

Respecto a las aproximaciones, suele tomarse como regla práctica en cuanto a la vatidez de la aproximación lineal para ia función de sesgo máximo BT (^),

valores ^<_ ^* 1 2. ^,Qué ocurre con la aproximación cuadrática? ^Qué ocurriria

con las hipotéticas aproximaciones a In VT (^)?

Todo esto en lo referente a«entornos» de contaminación, pero ^se podrian

extender algunos resultados a verdaderos entornos en la topologia débil, en la

dirección seguida por Rychlik y Zielinski o Riedel?

Otra cuestión que afecta no sólo a este artículo, sino de forma bastante generalizada a la Estadística Robusta, es la relacionada con la posibilidad de evitar resultados ( totalmente} asintóticos, los cuales, en mi opinión, no son enterarnente satisfactorios. Estos, aunque simplifican notablemente el problema, en no

pocas ocasiones equiparan comportamientos de estimadores claramente diferentes cuando se emplean tamaños muestraies pequeños.

E-:S ( I;^1.^C'IC ^N ROt3l;S I:^

^ fa.i

Como la suposición de tamaños muestrales finitos resulta en muchos casos

imposible, sugiero al autor la posibilidad de aproximar la distribución del estimador T(F„ )(al menos, cuando éste sea un M-estimador) rnediante las denominadas small-sample asymptotic techniques (Field y Hampel, 1982), las cuales, utilizando palabras del propio Huber (1981, p. 48), «... parecen dar aproximaciones fantásticamente precisas hasta tamaños muestrales muy pequeños

(n=3ó4}».

Mi último comentario es de gratitud, primero, hacia el profesor Zamar por el

esfuerzo realizado al resumir de forma precisa y amena un tema tan fundamental y de tanta actualidad en la Estadística corno es el de la robustez y, segundo,

al director de la Revista por haber conseguido la colaboración de tan distinguido

especialista.

REFERENCIAS

COLLINS, J. R. (1960): «Robust estimation fo a iocation parameter in the presence of asymmetry», Ann. Statis., 4, 68-85.

(1977): «Upper bounds on asymptotic variances of M-estirnators of location», Ann. Statis., 5, 646-657.

J. R., y PORTNOY , S. L. (1981): «Maximizing the variance of M -estimators using the generalized method of moment spaces», Ann. Statis., 9, 567-

COLLINS ,

577.

FIELD, C. A., y HAMPEL, F. R. (1982): «Smali-sample asymptotic dis#ributions of

M-estimators of location», Biametrika, 69, 29-46.

HAMPEL, F. R. (1974): «The influence curve and its role in robust estimation»,

J. Am. Statist. Assoc., 69, 383-393.

HUBER, P. J. (1964): «Robust estimation of a location parameter», Ann. Math.

Statis., 35, 73-101.

(1981) : Robust Statistics, Wiley.

RoussEEUw, P. J. (1981): «New infinitesimal rnethods in robust statistics», tesis

doctoral, Vrije Universiteit, Bruselas, Bélgica.

^f^

^-;^;"i A[^15"i^lc^r^ h^F?.^Nc ^1..^^

RICARDC^ A. MAR4NNA

Universidad Nacional de La Plata y CICPBA

E1 interesante artículo del profesor Zamar trata del modelo de posición y escaia univariados y, en general, del modelo lineal con respuesta univariada. C^uisiera hacer aquí algunas consideraciones sobre el modelo lineal multivariado

Bx; + e; ,

ti- 1, ..., n}

[1]

donde y; E RQ, los e; E RQ son vectores i.i.d. con matriz de covarianzas ^, B E

RQ x p es la matriz de parámetros desconocidos, y los x; E Rp son, o bien fijos, o

b+en aleatorios i.i.d. e independientes de los e; .

En la teoría clásica se supone que los e; son normales, con lo que el estimador de mínimas cuadrados (EMC) es el de máxima verosimilitud y resulta óptimo

no sólo asintóticamente, sino también para n finito. Bajo condiciones bastante

generales, el EMC es asintóticamente normal con matriz de covarianzas

^ ^ (x^ x}-1

^2]

donde ^ es el producto de Kronecker y X E Rn X p es la matriz de las x; .

Perv cuando las observaciones (x; , y; ) pueden tener datos atípicos, el EMC

presenta todos los inconvenientes ya conocidos para el caso univariado, con el

agravante de que el carácter multidimensional de las y; puede hacer la detección

de observaciones atípicas aún más dificil. Sería entonces deseable obtener estimaáores que tuvieran: 1} alta eficiencia para e normal; 2} punto de ruptura S* alto;

3) equivariancia para transformaciones lineales de las x; y de ias y; , y^} cálculo

numérico factible. Si se quiere estirnar eficientemente todas las combinaciones lineales de los coeficientes B, la condición 3) es necesaria para la ^}.

Como muestra Zamar en su artículo, se dispone de estimadores que cumplen las cuatro condiciones mencionadas para el caso q= 1; y, por lo tanto, sería naturaf pensar en estirnar cada fiia de B separadamente usanda un estimador robusto univariado. Pero este procedimiento no sería equivarian#e bajo

transforrnacíones de las y, por lo que no sería eficiente para combinaciones lineales arbitrarias de B. Hace falta entonces otro enfoque.

En el caso q^ = 1, si bien la situación no es sencilla, se han hecho al menos

considerables progresos y se cuenta con estimadores confiables; y se puede

encarar el problema de la optimalidad. En cambio, en el caso multivariado el terreno es prácticamente virgen. EI principal interés del caso multivariado está en

seemingly unrelas aplicaciones econométricas, en particular e1 modelo SUR

E:^"I'IMAC'1(3N R()B(_!S"T^,

3f^5

lated regressions (regresiones aparentemente no relacionadas); ver Koenker y

Portnoy (1990)

y Ecuaciones Simultáneas (Maronna y Yohai, 1995a). Si bien

estos dos modelos contienen al modelo lineal multivariado como caso particuíar,

preferimos limitarnos a éste para no complicar la exposición.

Los M estimadores para este modelo son de 1a forma

n

^U^(d;)r;i0

i^ 1

n

^u^(d;)r; r;=n^

^-,

[4]

donde r; son los residuos:

r;=r; (B)=y;--Bx;

las d; son las «distancias de Mahalanobis»

=d;(B,^)=

(B)`^-^ r; (B)

C5]

y u1, u2 son funciones decrecientes.

Los M estimadores son asintóticarnente normales, con matriz de covarianzas

de la forma (??}, pero con ^ reemplazada por una matriz S que tiene la forma de

la matriz de covarianzas de un M estimador de posición multivariada. Si bien la